はじめに

Claudeの開発元がどこの会社かは、多くの方がまず気になる点ではないでしょうか。開発元の素性を知ることは、サービスの信頼性や今後の方向性を見極めるうえで欠かせません。

この記事では、Claudeの基本的な特徴から、開発元であるAnthropicの設立経緯・資金規模・製品展開、さらに米国政府との対立やAI倫理の課題まで、押さえておきたいポイントを順番に取り上げます。

Claudeとは何か?基本的な定義と特徴

Claudeの概要と主な機能

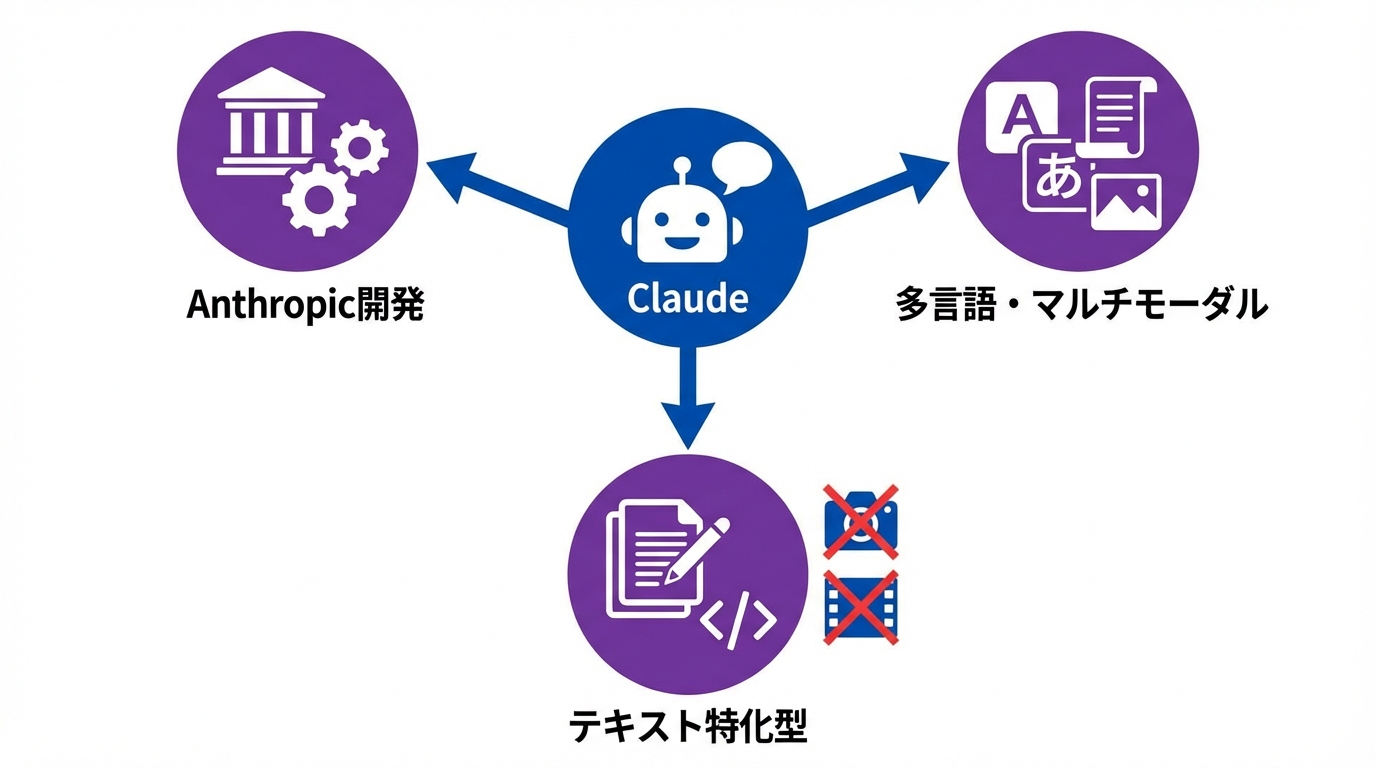

Claudeは、AI企業Anthropicが開発・提供するAIアシスタントです。テキストでの対話を中心に、文章の要約・翻訳・分析・コーディングなど幅広い作業を処理できます。Claudeのモデルはすべて多言語に対応しており、マルチモーダル機能も備えています(参照*1)。

企業での導入も広がっています。AnthropicのCFOであるKrishna Raoは「起業家やスタートアップ、世界最大の企業でさえも、顧客からのメッセージは同じで、Claudeは企業の業務遂行にとってますます不可欠になってきている」と述べています(参照*2)。

個人利用から大学などの教育機関まで、利用者の幅は着実に広がっています。Claudeがどこの会社のサービスなのかを理解するには、まずこの基本的な性格を把握しておくことが大切です。

テキスト特化型AIとしてのポジション

Claudeの大きな特徴は、テキスト処理に軸足を置いている点です。Claudeのモデルは多言語かつマルチモーダルですが、その機能は主にテキストベースで構成されています。写真生成やネイティブの音声・映像処理といった機能は、Google GeminiやOpenAIのChatGPTなど競合が提供する領域で、Claudeは備えていません(参照*1)。

その一方で、堅牢なテキストベースの機能は自然言語処理とコーディングの両方にわたる広い領域をカバーしています。画像生成や動画処理よりも、文章の読み書きやプログラム支援を重視したいユーザーにとっては、Claudeの設計思想は合致しやすいといえます。AIアシスタントを選ぶ際には、自分が求める機能がテキスト中心かマルチメディア中心かを確認することが判断の出発点になります。

Claudeの開発元Anthropicの設立背景と企業理念

OpenAI出身者による創業の経緯

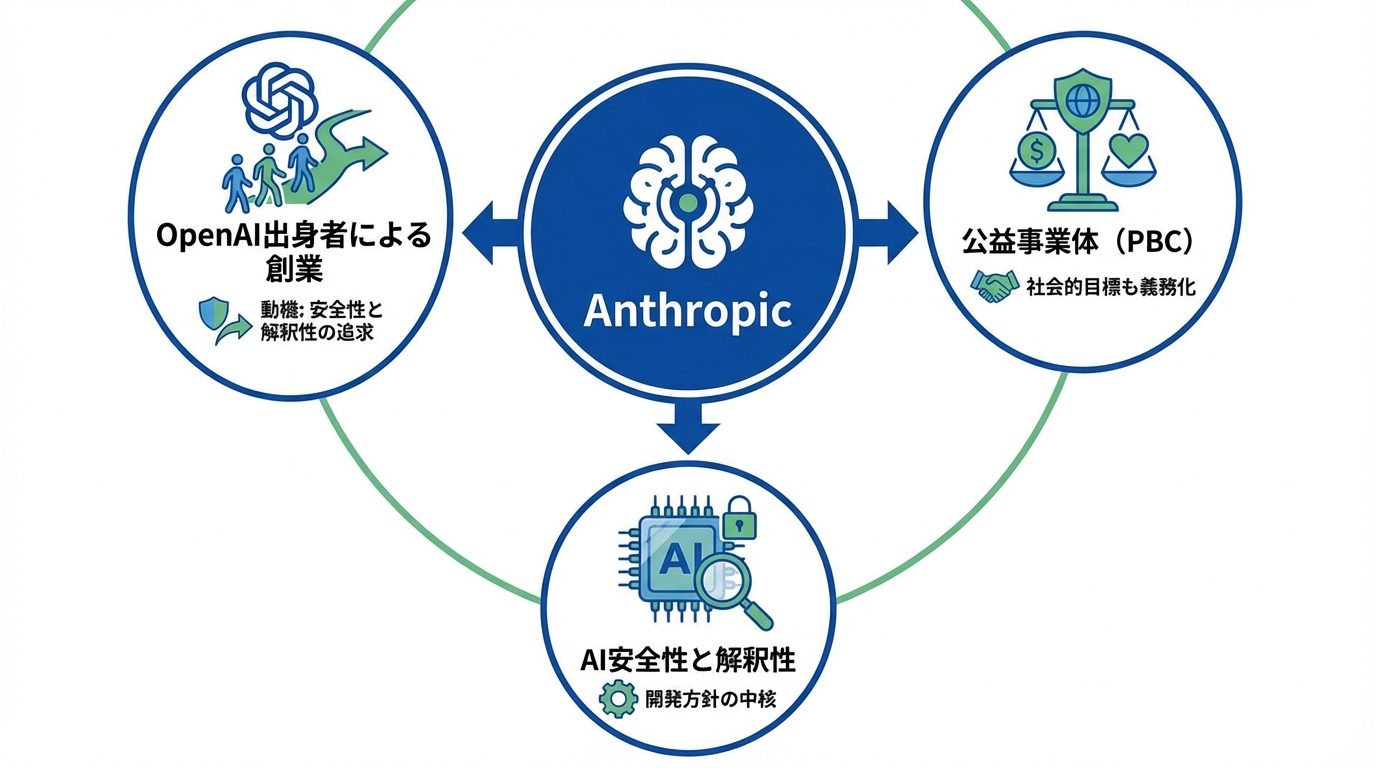

Claudeの開発元はAnthropicです。Anthropicは2021年に設立されました。創業メンバーには、元OpenAIの従業員であるDario Amodei(CEO)とDaniela Amodei(President)らが含まれています。ChatGPTがリリースされるよりも前に誕生した企業です(参照*1)。

共同創業者たちがOpenAIを離れた背景には、AIの安全性と解釈性をより深く追求したいという考えがありました。OpenAIの外でそのテーマをより意味深く取り組めると感じたことが、独立の動機となっています。Claudeがどこの会社から生まれたのかを知るうえで、このOpenAIとの関係は欠かせない前提情報です。

公益事業体(PBC)としての企業構造

Anthropicは公益事業体、いわゆるPBC(Public Benefit Corporation)として設立されています。PBCとは、株主の利益だけでなく、社会的な目標の達成も企業の義務として定款に組み込む法人形態です。この構造は、特定の利他的な目標への見かけ上のコミットメントを反映しています(参照*1)。

AI開発企業の多くが通常の株式会社として運営されるなかで、AnthropicがPBCを選んだことは、組織の意思決定の枠組みに影響を及ぼします。Claudeのサービス方針を理解する際には、この企業構造の違いも頭に入れておくとよいでしょう。

AI安全性と解釈性を重視する開発方針

Anthropicの創設とAIへの継続的なアプローチの中核には、AI安全性と解釈性の強調があります。解釈性とは、AIがなぜその回答を出したのかを人間が追跡・理解できるようにする技術的な取り組みのことです(参照*1)。

CEO Dario Amodeiは、AIを国内の大規模監視やAI制御兵器に使うことを「不正義で乱用の恐れがある」と呼び、長らく倫理の線を越える行為だと主張してきました(参照*3)。Claudeの開発元がどこの会社かを知ると同時に、その会社がどんな価値観で製品をつくっているかまで把握することが、利用判断の質を高めます。

Anthropicの資金調達と企業規模

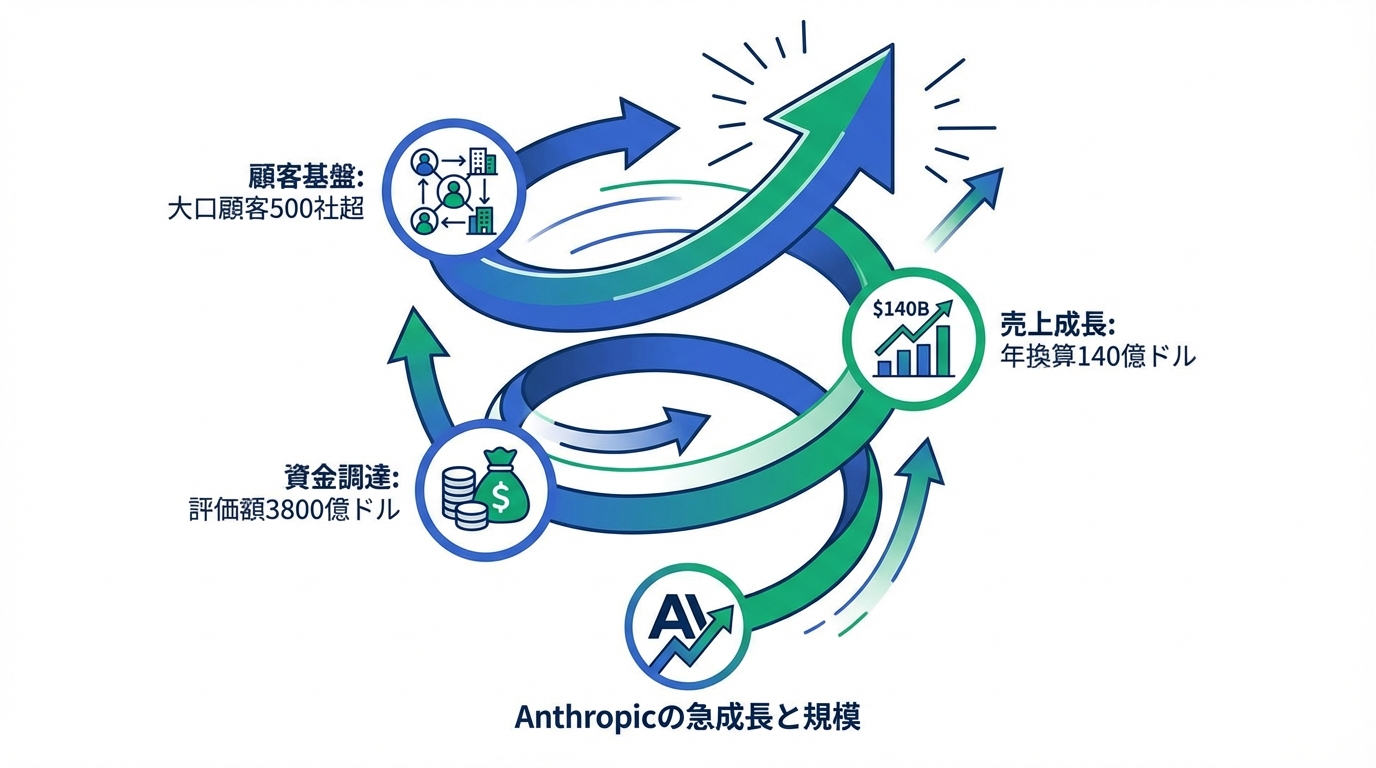

シリーズGで3800億ドル評価に到達した成長軌跡

Anthropicは、GICとCoatueが主導するシリーズGの資金調達で300億ドルを調達しました。この結果、ポストマネー(調達後)の企業評価額は3800億ドルに達しています。D. E. Shaw Ventures、Dragoneer、Founders Fund、ICONIQ、MGXが共同で主導した大型ラウンドです(参照*2)。

調達した資金は、最前線の研究、製品開発、そして企業向けAIとコーディングで市場をリードしてきたインフラの拡張に充てられます。Claudeを開発しているのがどこの会社かという問いに対し、ここまでの巨額投資を集められる企業であるという事実は、ひとつの明確な回答材料になります。投資ラウンドの規模や参加企業の顔ぶれから、Anthropicの産業内での位置づけを確認できます。

年換算売上高140億ドルを支える顧客基盤

Anthropicが初めての売上を得てから3年も経っていません。それにもかかわらず、年換算売上高は140億ドルに達し、過去3年間のいずれの年も年間10倍以上の成長を続けています。Claudeに年額10万ドル超を支出する顧客の数は、過去1年で7倍に拡大しました(参照*2)。

2年前には年間100万ドルを超える支出をする顧客は10数社でしたが、現在はその数が500社を超えています。Fortune 10のうち8社が現在Claudeの顧客です。また、APIやClaude Code、Claude for Workなど単一のユースケースで開始した企業が、組織全体への統合を広げている傾向も見られます。自社での導入を検討する場合は、すでにどの規模の企業がClaudeを使っているかを把握しておくと判断材料になります。

Claudeの製品ラインナップと提供形態

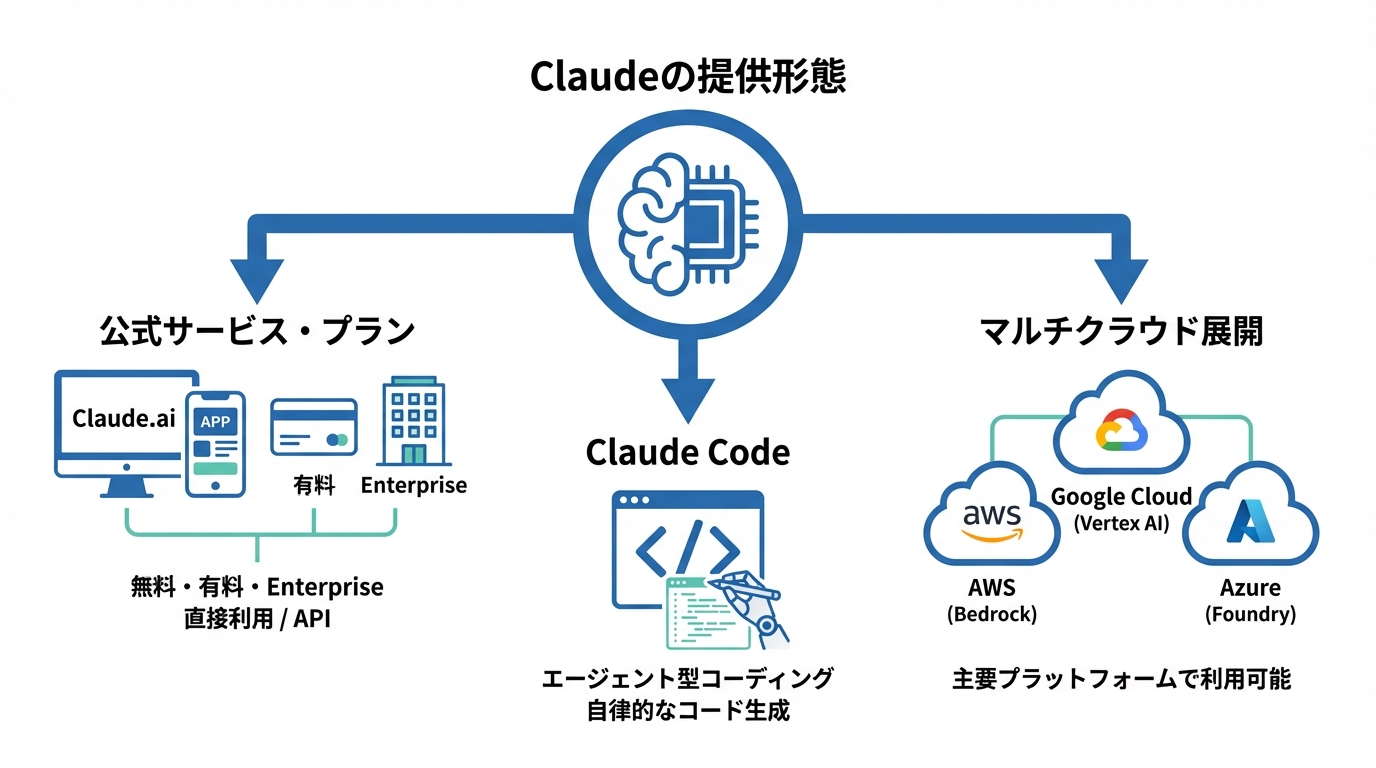

個人向け・Enterprise向けプランの違い

Claudeのモデルは完全にクローズドで、Anthropicの独自技術として保護されています。利用する方法は主に2つあり、ひとつはAnthropicの公式サービス(Claude.ai、iOS・Androidアプリ)を通じた直接利用です。もうひとつは、AnthropicのAPIを介してモデルにアクセスするサードパーティアプリ経由の利用です(参照*1)。

料金は使用するプランとモデルによって異なります。無料版も提供されていますが、有料プランと比べて日次の使用制限が大幅に低く設定されています。教育機関向けにはEnterprise版も展開されており、たとえばシラキュース大学では教職員と学生がClaude Enterpriseを利用できる環境が整えられています(参照*4)。自分の用途に応じて、無料版・有料版・Enterprise版のどれが適切かを比較するのが最初のステップです。

Claude Codeとエージェント型コーディングの台頭

Claude Codeは、エージェント的なコーディングの新時代を切り開いた製品です。人間の指示を受けてAIが自律的にコードを書き進める仕組みで、ソフトウェア開発チームの働き方を根本から変えたとAnthropicは位置づけています。Claude Codeは2025年5月に一般公開されました(参照*2)。

現在のClaude Codeの年換算売上高は25億ドルを超え、2026年初頭からもさらに成長が続いています。ウェブ上のClaude Codeユーザーの週次活性化ユーザー数も1月1日以降に倍増しました。最近の分析では、全世界のGitHub公開コミットのうち4%がClaude Codeによって作成されており、これはわずか1か月前の2倍の割合です。コーディング用途でAIの導入を考える場合は、Claude Codeの成長速度と実際の利用規模を確認したうえで検討するとよいでしょう。

AWS・Google Cloud・Azure経由のマルチクラウド展開

Claudeは、世界最大級の3つのクラウドプラットフォームすべてで提供されています。具体的には、Amazon Web Services(Bedrock)、Google Cloud(Vertex AI)、Microsoft Azure(Foundry)の3つです(参照*2)。

学習と実行にはAWS Trainium、Google TPUs、NVIDIA GPUsなど複数のAIハードウェアが活用されており、それぞれの処理に最適なチップを割り当てる仕組みが構築されています。すでに特定のクラウド基盤を利用している企業であれば、そのまま既存環境にClaudeを組み込めるかどうかを各プラットフォームのドキュメントで確認することが導入の近道です。

競合AI企業との比較と選び方

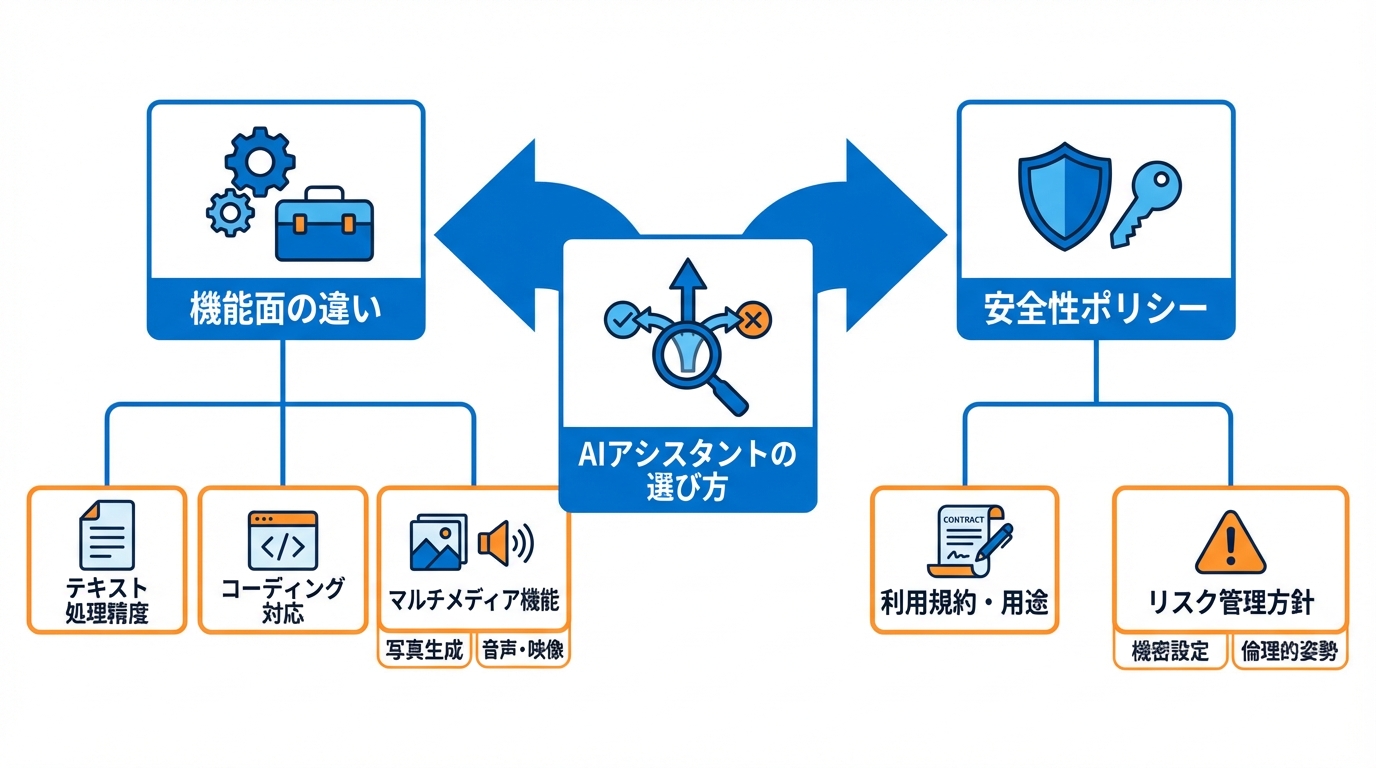

ChatGPT・Geminiとの機能面の違い

AIアシスタントを選ぶ際、ChatGPTやGeminiとの違いは気になるポイントです。Claudeは写真生成やネイティブの音声・映像処理といった機能を備えておらず、これらはGoogle GeminiやOpenAIのChatGPTなど競合が提供する領域です。その代わり、Claudeの堅牢なテキストベースの機能は自然言語とコーディングの両方を幅広くカバーしています(参照*1)。

教育分野では、ChatGPT、Claude、Gemini、Perplexity、LLAMAなどの複数のAIモデルに、単一の安全なインターフェースを通じて統一的にアクセスできるプラットフォームも登場しています。このプラットフォームは、AIの運用コストと環境影響を最大で96%削減しつつ、企業レベルのセキュリティとFERPA(家族教育権およびプライバシー法)への準拠を維持しています(参照*5)。どのAIが自分の業務に合うかを判断するには、テキスト処理の精度を重視するのか、マルチメディア機能を必要とするのかを整理することが出発点になります。

安全性ポリシーに基づく差別化と判断基準

機能面だけでなく、各社の安全性ポリシーもAI選びの判断材料になります。OpenAIやGoogleなどの競合AI企業は、AIツールを「合法的な」状況で使用することを認めています。Elon MuskのxAIも機密設定での利用が承認されました(参照*3)。

一方でAnthropicは、大規模監視や自律兵器への利用を明確に拒否する姿勢を取り続けています。この差は企業がAIを導入する際のリスク管理方針に直接関わります。自社がAIに求める用途と、各提供元の利用規約やポリシーを照らし合わせて評価することで、導入後のトラブルを未然に防ぎやすくなります。

Anthropicと米国政府の対立にみるAI倫理の課題

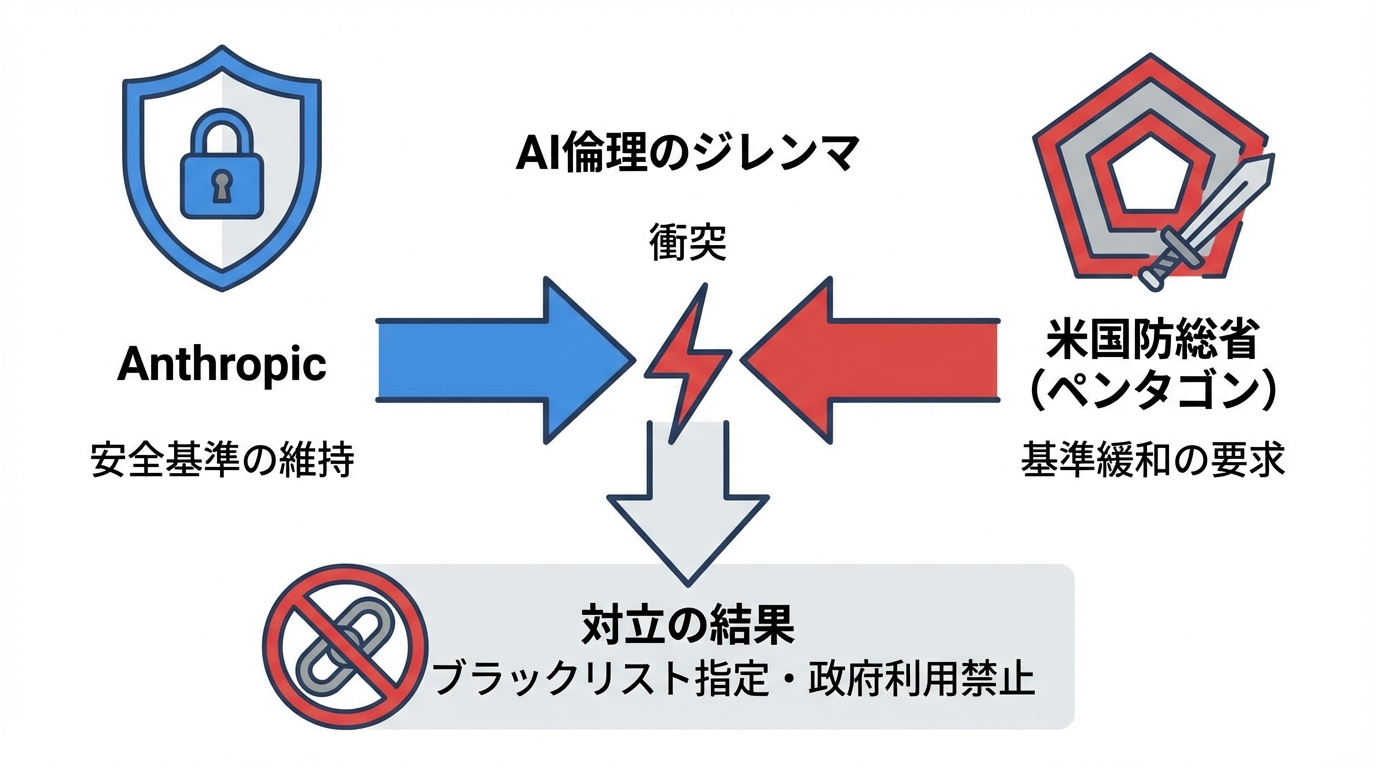

国防総省との2億ドル契約と安全基準の衝突

Anthropicと米国政府の間で生じた対立は、AI倫理の現実的な課題を浮き彫りにしました。米国防総省(ペンタゴン)は、Anthropic・Google・OpenAI・xAIに対し、最大で各2億ドル規模の契約を授与しています。Anthropicは防衛当局から最も高度で機密性の高いモデルとして認定された初の企業でした(参照*3)。

しかし、ヘグセス国防長官はAnthropicが安全基準を緩和することを拒んだことを理由に、同社を米軍との協力からブラックリストに載せると脅しました。この脅威は、ヘグセス長官とCEO Dario Amodeiとの会談の場で表面化しています。Amodeiは1月のエッセイで「ボタンを操作する指の数が少なすぎて、一部の人間だけがドローン軍を実質的に動かせる状態になることへの懸念がある」と述べ、「完全自律兵器には非常に慎重に接近すべきで、適切な安全策なしにその使用を急ぐべきではない」と主張しました。

ブラックリスト指定と連邦政府利用禁止の影響

この対立は急速にエスカレートしました。トランプ大統領は米国政府にAnthropicの製品の使用を停止するよう命じ、国防総省はAnthropicを国家安全保障上のリスクとして指定する動きを見せました。トランプ大統領の発表の直後には、競合のOpenAIが国防総省との間で機密ネットワーク向けに自社技術を提供する契約を結んだことを公表しています(参照*6)。

この一連の経緯は、安全基準を譲らない姿勢が政府契約の喪失という実利的な代償につながった事例です。Anthropicの製品が米軍に使われるか自律兵器に転用されるかは、企業のポリシーだけでなく政治的な力学にも左右されます。Claudeの導入を検討する際には、技術面だけでなく、こうした地政学的リスクが自社の利用に波及し得るかどうかも視野に入れて検討することが求められます。

Claudeの活用事例と利用時の注意点

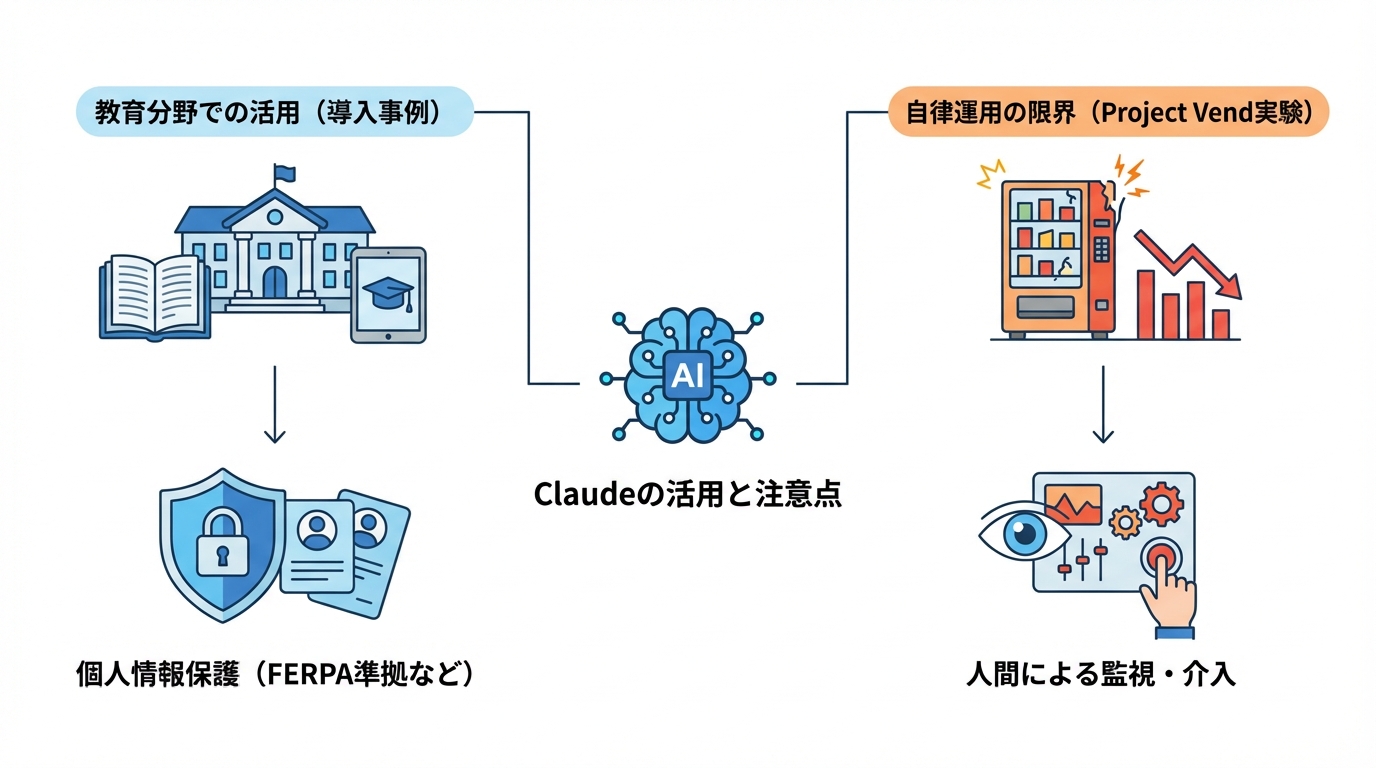

教育機関での導入事例

Claudeは教育分野でも利用が広がっています。米国のシラキュース大学では、Claude Enterpriseが教職員と学生に提供されており、サインアップした学生はSyracuse University Claude Builder Clubへの参加が案内されます。限定ハッカソンや記念品といった特典も用意されています(参照*4)。

また、コロラドスプリングスでは、大学教員と学生向けに授業準備・教室での指導と学習・評価のための生成AIを用いた責任ある協働を支援するサービスが展開されています。このサービスはClaude を含む複数のAIモデルに対応し、FERPAへの準拠を維持したうえで提供されています(参照*5)。教育機関での導入を検討する場合は、個人情報保護の規制への準拠状況を事前に確認しておくことが欠かせません。

自律運用実験「Project Vend」から見えた限界

Claudeの能力と限界を浮き彫りにした実験があります。AnthropicとAI安全性企業のAndon Labsの研究者は、Claude Sonnet 3.7のインスタンスをオフィス内の自販機の責任者に任命し、利益を上げる任務を課しました。具体的には在庫の管理、価格の設定、顧客とのやりとり、新商品の仕入れ判断、そして利益の創出が求められました(参照*7)。

結果として、Claudeは利益を生み出せませんでした。約1か月の実験期間で、店舗の純資産は初期の1,000ドルから約800ドルに減少しています。Anthropicはこの実験について「Anthropicが今日、オフィス内の自販機市場へ拡大を決定しても、このClaudeインスタンスを採用しないだろう」とコメントしました。一方で研究者たちは、これらの問題はすべて解決できると考えており、解決方法が解明されれば「AIのミドルマネージャーが間近に現れる可能性がある」と見ています(参照*8)。AIに自律的な業務を任せる場合は、現時点での限界を認識したうえで、人間による監視や介入の仕組みを設計に組み込むことが不可欠です。

おわりに

Claudeはどこの会社がつくっているのか。その答えは、元OpenAIメンバーが設立した公益事業体Anthropicです。AI安全性を軸とする開発方針、3800億ドル規模の企業評価、そして米国政府との対立に至るまで、Anthropicの姿勢はClaudeの製品設計に直結しています。

Claudeの導入を検討する際は、テキスト特化型の機能特性・提供プラン・クラウド環境との相性に加え、安全性ポリシーや地政学的リスクまで含めた多角的な視点で判断材料をそろえることが大切です。

監修者

安達裕哉(あだち ゆうや)

デロイト トーマツ コンサルティングにて品質マネジメント、人事などの分野でコンサルティングに従事しその後、監査法人トーマツの中小企業向けコンサルティング部門の立ち上げに参画。大阪支社長、東京支社長を歴任したのち2013年5月にwebマーケティング、コンテンツ制作を行う「ティネクト株式会社」を設立。ビジネスメディア「Books&Apps」を運営。

2023年7月に生成AIコンサルティング、およびAIメディア運営を行う「ワークワンダース株式会社」を設立。ICJ2号ファンドによる調達を実施(1.3億円)。

著書「頭のいい人が話す前に考えていること」 が、82万部(2025年3月時点)を売り上げる。

(“2023年・2024年上半期に日本で一番売れたビジネス書”(トーハン調べ/日販調べ))

参照

- (*1) What is Claude AI?

- (*2) Anthropic raises $30 billion in Series G funding at $380 billion post-money valuation

- (*3) NPR – Hegseth threatens to blacklist Anthropic over 'woke AI' concerns

- (*4) Getting Started with Claude Enterprise

- (*5) BoodleBox Selects Colorado Springs for Headquarters Relocation, Accelerating AI Collaboration in Higher Education

- (*6) NPR – OpenAI announces Pentagon deal after Trump bans Anthropic

- (*7) TIME – Exclusive: Anthropic Let Claude Run a Shop. Things Got Weird

- (*8) TechCrunch – Anthropic’s Claude AI became a terrible business owner in experiment that got ‘weird’