はじめに

生成AIが検索の主役になりつつある今、自社の情報がAIの回答にどう表示されるかは、売上やブランドイメージに直結する問題です。従来のSEOだけではAIが生成する回答文に自社名が登場しない、あるいは誤った情報で紹介されるといったリスクが生じます。

こうしたリスクに備える手段がLLMO対策です。コンテンツの質を高め、構造化データを整備し、AI回答を定期的に監視することで、生成AI時代でも自社の情報を正しく届けられます。本記事では、LLMO対策の定義から具体的な実践手順、効果測定の方法までを順を追って解説します。

LLMOの定義とSEOとの違い

LLMOが指す最適化の範囲

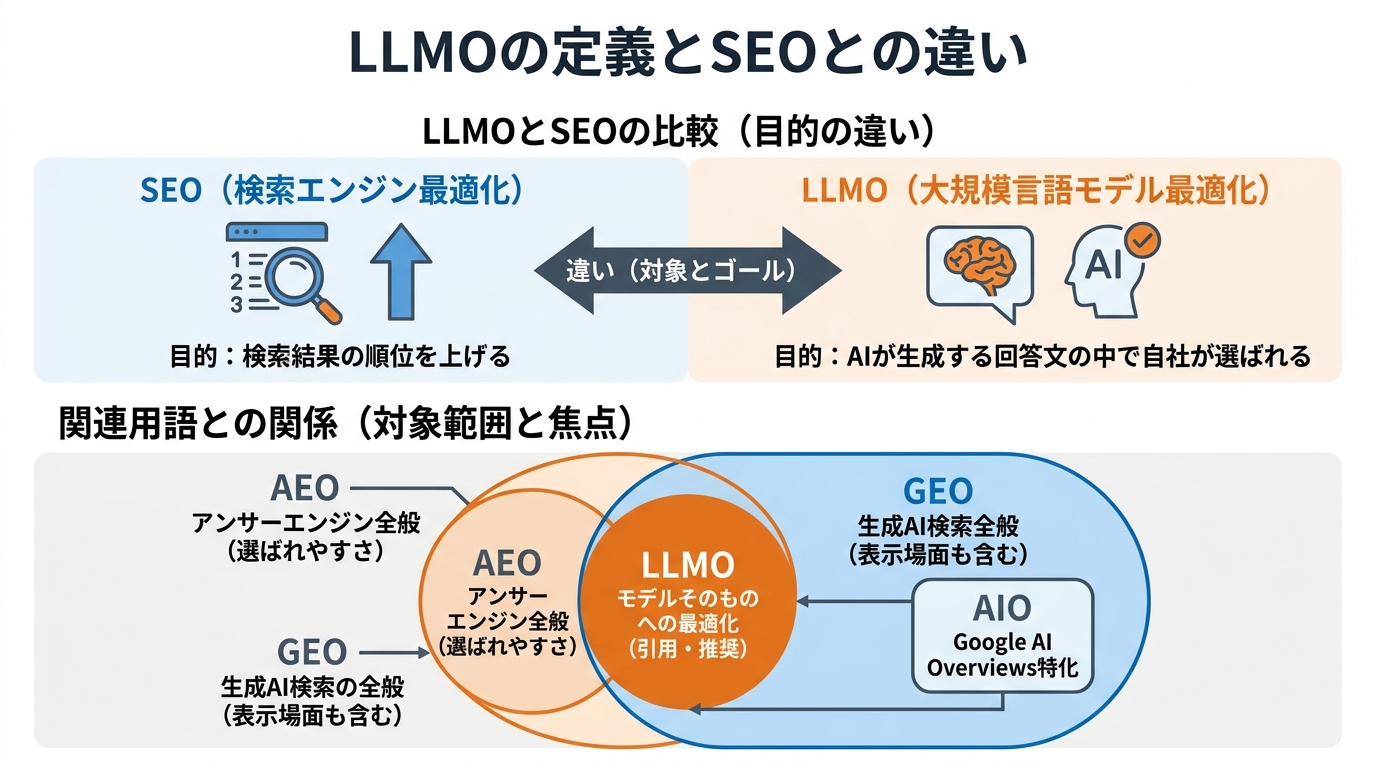

LLMOとは大規模言語モデル最適化(Large Language Model Optimization)の略で、ChatGPTやGeminiなどの大規模言語モデルに対して自社の情報が正しく引用・推奨されるよう最適化する取り組みです。従来の検索エンジン最適化が「検索結果の順位を上げる」ことを目指すのに対し、LLMOは「AIが生成する回答文の中で自社が選ばれる」ことを目標とします。

AEO(Answer Engine Optimization)はAEO(LLMO)として扱われることもあり、生成AIに自社ブランドが選ばれやすくする最適化を指します(参照*1)。つまりLLMOの対象範囲は、特定の検索エンジンの順位だけでなく、AIが回答を組み立てる過程そのものに及びます。

SEO・AEO・GEOとの関係整理

AI検索時代の最適化にはGEO・LLMO・AIO・AEOなど複数の用語がありますが、それぞれ対象範囲が異なります。GEO(Generative Engine Optimization)は生成AI検索全般の最適化、LLMOは大規模言語モデルへの最適化、AIOはGoogleのAI Overviewsに特化した最適化、AEOはアンサーエンジン全般の最適化を指します(参照*2)。

LLMOがモデルそのものへの働きかけであるのに対し、GEOやAIOは表示される場面に焦点を当てた概念です。LLMO対策を早期に実践した企業は、AIプラットフォームが収益化を始めた段階でも優位を確保できるとの見方もあります(参照*3)。自社が注力すべき対象がどの範囲なのかを明確にしたうえで、施策の優先順位を決めることがポイントです。

LLMO対策が急務となる背景

生成AI検索の普及とゼロクリック化

2024年以降、Googleの検索結果にはAI Overviewsが表示されるようになり、ユーザーは検索結果ページ上で直接「回答」を得られるようになりました。ChatGPTなどの生成AIツールの利用者数は2024年から2025年にかけて倍増し、2026年までに従来型の検索エンジン利用は25%減少すると予測されています(参照*1)。

Google AI Overviews、ChatGPT、Perplexity、Geminiなど複数のAI検索が普及したことで、ユーザーの行動は「検索結果の一覧を見る」から「AIに直接たずねる」へ変わりつつあります。その結果、検索結果で1位を獲得してもリンクがクリックされないケースが増え、この現象は「ゼロクリック検索」と呼ばれています(参照*2)。従来のSEOだけに依存している状態では、流入そのものが失われるリスクが高まっています。

誤情報・競合推奨によるブランド毀損

ゼロクリック化の問題に加え、AIが誤った情報を回答に含めるリスクも無視できません。商品名や価格、差別化ポイントが間違ったまま表示されれば、ブランドの信頼が損なわれます。AIの回答に自社が登場しないだけでなく、競合他社が推奨される形で紹介される可能性もあります。

AIプラットフォームの収益化が進むと、料金を支払う参加者が優先される急激な変更が起こりうるとの見通しも示されています。たとえば、OpenAIはChatGPTの運用だけで1日あたり推定70万ドルのコストを負担しているとされ、他の提供企業も同様の課題を抱えるとされています(参照*3)。収益化が進めば、LLMO対策を行っていない企業はAI上での存在感を一気に失うおそれがあります。

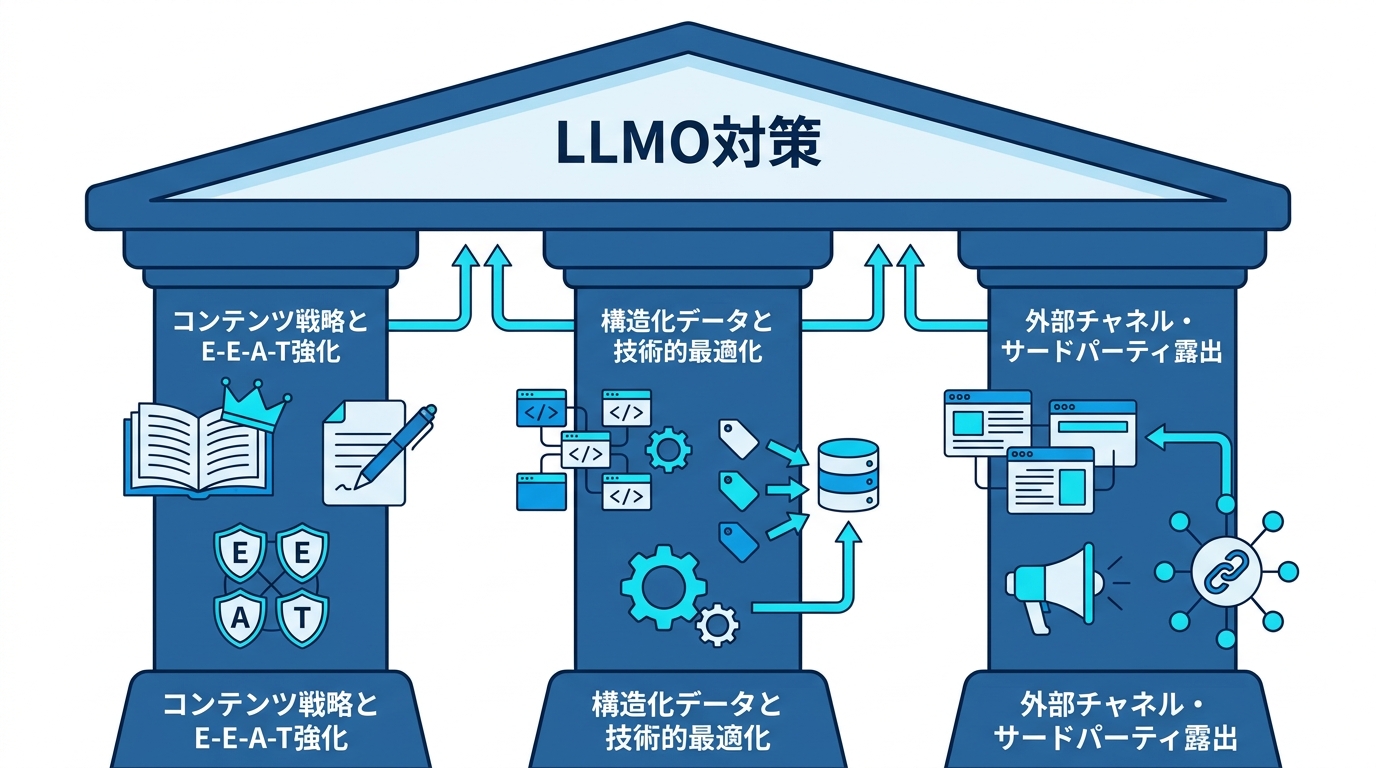

LLMO対策の全体像と三本柱

コンテンツ戦略とE-E-A-T強化

LLMO対策の第一の柱は、コンテンツの質を高めることです。具体的には、不足している情報や過剰な情報を見直し、ウェブサイトのコンテンツ構成・信頼性・技術面を最適化する取り組みが含まれます(参照*1)。

AIが信頼できる情報源として認識するには、E-E-A-T(経験・専門性・権威性・信頼性)の強化が欠かせません。他のサイトにはない独自のデータや事例を提供することで、AIにとっての引用価値を高められます(参照*2)。自社だけが持つ知見や独自の視点、逆説的な主張を記録し、引用に値するコンテンツとして蓄積していくことがLLMO対策の土台になります(参照*3)。

構造化データと技術的最適化

第二の柱は、構造化データ(スキーママークアップ)を用いた技術的な最適化です。構造化データを実装することで、AIがサイトの情報を正しく理解し、適切な文脈で引用できるようになります。特にFAQスキーマ、HowToスキーマ、Organizationスキーマが効果的です(参照*2)。

逆に、構造化データを実装していないサイトは、AIに誤って認識され、本来の文脈とは異なる形で引用されるリスクがあります。LLMO対策においては、コンテンツの中身だけでなく、AIが情報を読み取るための「形式」を整えることも不可欠です。

外部チャネル・サードパーティ露出

第三の柱は、自社サイト以外の場所での露出を強化することです。AIは回答を生成する際に、複数の情報源を参照します。そのため、サードパーティサイトでの自社情報の掲載状況を高めることが、AIの回答に採用される確率を上げる手段になります(参照*1)。

自然検索やウェブサイト評価だけでなく、リード獲得施策、競合の動向、外部メディアでの自社情報のカバー範囲まで含めた広い視野が求められます。自社サイトの改善だけで完結するSEOとは異なり、LLMO対策では「外からどう見えているか」にまで施策を広げる必要があります。

AI回答の監視と検知の進め方

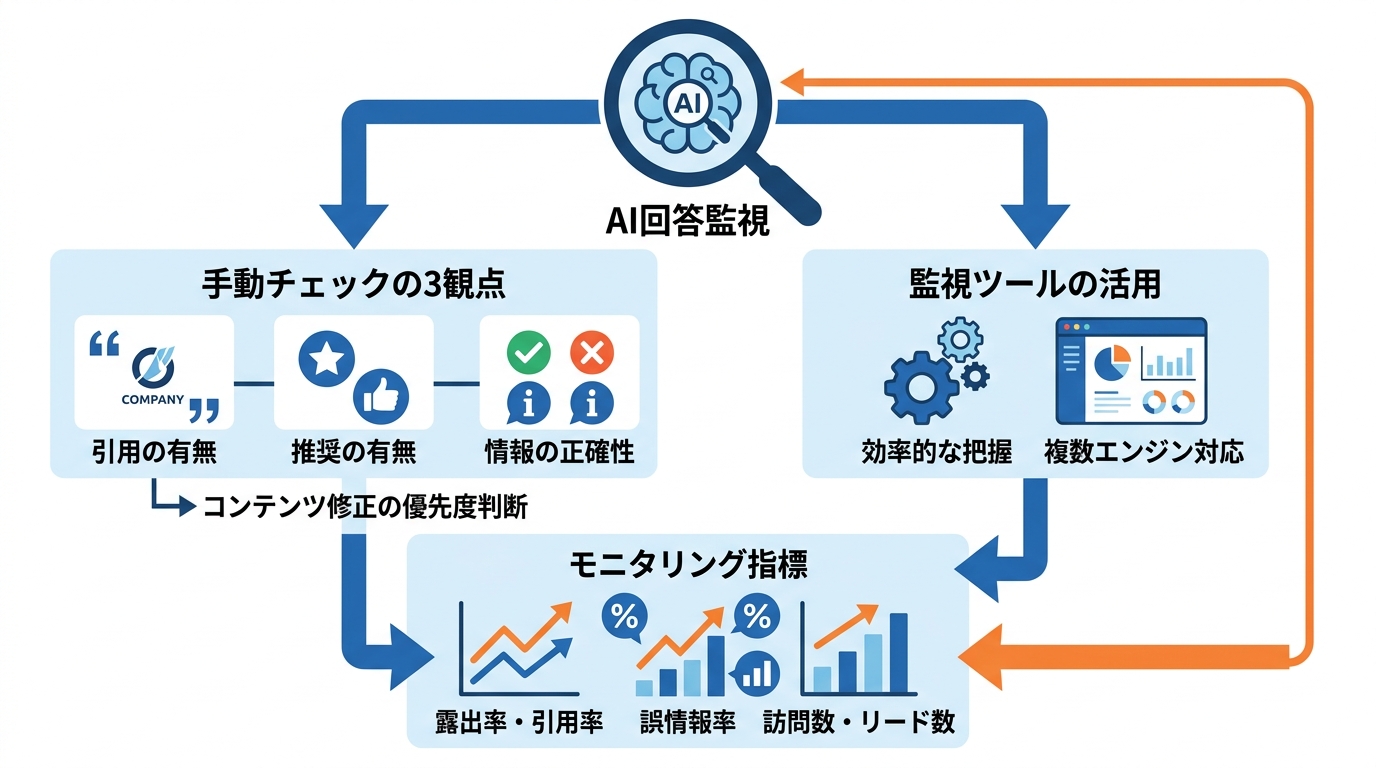

手動チェックの三つの観点

LLMO対策を実施した後は、AIの回答に自社がどのように表示されているかを確認する工程が必要です。手動チェックでは三つの観点を用います。まず「引用の有無」として、AIの回答文に自社名が含まれているかどうか。次に「推奨の有無」として、「おすすめ」などの形で具体的に推奨されているかどうか。最後に「情報の正確性」として、誤った情報で紹介されていないかどうかを確認します(参照*2)。

この三つを定期的に確認することで、コンテンツ修正の優先度を判断できます。たとえば引用はされているが情報が誤っている場合は、構造化データやコンテンツの記述を修正する施策が先決になります。

監視ツールと定期モニタリング体制

手動チェックは有効ですが、継続的な監視には作業負荷がかかります。AI検索の可視化ツールを活用すれば、複数のAI検索エンジンにおける引用状況を効率的に把握できます(参照*2)。

モニタリングで測定する指標は多岐にわたります。AIの回答における自社ブランドの露出率や引用率、商品名・価格・差別化ポイントの誤情報率、AI経由および検索経由のウェブサイト訪問数、リード獲得件数などが代表的な項目です(参照*1)。これらの指標を定期的に追うことで、LLMO対策の効果を数値で判断し、次の改善につなげられます。

内製と外注の比較・判断基準

コスト・専門性・成果期間の比較

LLMO対策を社内で行う場合と外注する場合では、費用構造や成果が出るまでの期間が大きく異なります。内製の場合、初期コストは低いものの専門知識を社内で蓄積する必要があり、成果が出るまでの期間も見通しにくいのが実情です。一方、外注では初期費用が10万〜50万円、月額費用が3万〜50万円の幅で発生しますが、専門性をすぐに活用でき、成果が出るまでの期間は平均2〜6か月程度とされています(参照*2)。

内製では対応範囲が限定的になりやすいのに対し、外注では包括的な施策をカバーできる点も違いの一つです。自社のリソースと目標とする成果期間を照らし合わせて判断する必要があります。

外注前に整理すべき五つの項目

外注を検討する場合、事前に社内で整理しておくべき項目が五つあります。

- 目的の明確化:認知拡大、リード獲得、誤情報の修正など、何を達成したいかを定める

- KPIの仮設定:AI引用数、推奨率、AI経由のコンバージョン数などを暫定的に決める

- 予算の確認:初期費用と月額費用の上限を把握する

- 対象AIの特定:ChatGPT、Gemini、Perplexity、Google AI Overviewsなど、どのAIを対象とするかを決める

- 現状の把握:現時点でAIに引用されているかどうかを確認する

これら五つの項目が整理されていれば、外注先との打ち合わせがスムーズになり、施策の方向性にズレが生じにくくなります(参照*2)。

失敗例と注意点

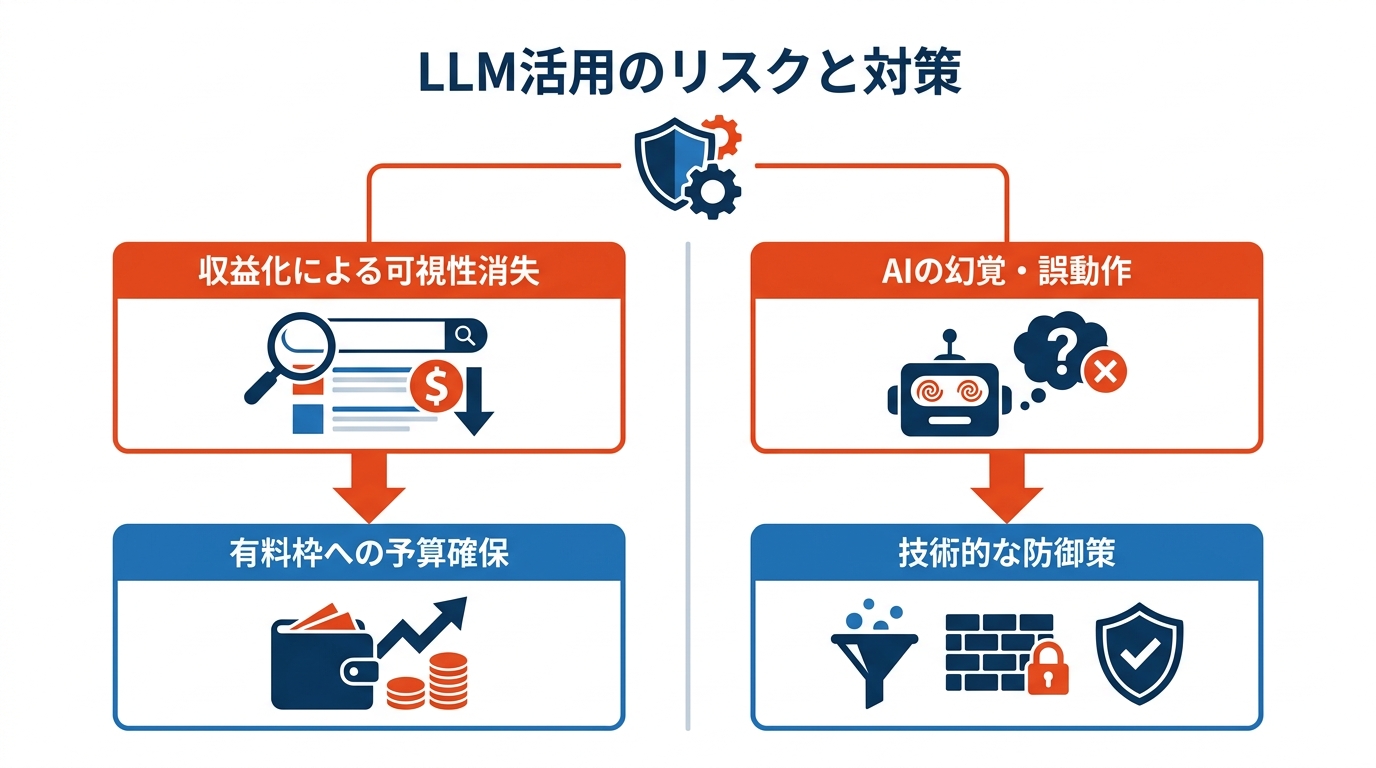

LLM収益化による可視性消失リスク

LLMO対策を講じても、AIプラットフォームの収益化によって前提が崩れるリスクがあります。収益化の初期段階では、オーガニック(自然表示)の可視性が縮小し、有料の可視性が優先される二層構造が生まれると予測されています。事前にAnswer Rank(AIの回答における順位)の最適化を行った企業はある程度のオーガニック表示を維持できますが、未対策の企業はデジタル上で埋没する可能性があります(参照*3)。

特に商用クエリ、つまり見込み顧客がソリューションを調べるときに使う検索語は、収益化の最初のターゲットになりうると指摘されています。自社の主力キーワードが商用クエリに該当する場合は、有料枠への予算確保も視野に入れた対策の設計が求められます。

LLMの幻覚・パターン過認識への備え

AIモデル特有のリスクとして、「幻覚」(事実に基づかない回答を生成する現象)と「パターン過認識」があります。与えられた情報と整合しないパターンを見いだしてしまう傾向が確認されており、AIモデルにおけるIdola Tribus(族のイドラ)に相当すると解釈できると指摘されています(参照*4)。

こうしたAIの特性に対して、技術的な防御策も提案されています。不審な入力を除去するコンテンツ浄化、メタ指示や過度な繰り返しを検出するプロンプトフィルタリング、繰り返しコンテンツの重みを下げるコンテキストウィンドウのバランス調整、コンテンツの出所を示すユーザー警告などが挙げられています(参照*5)。LLMO対策は攻めの施策だけでなく、AIの誤動作から自社を守る防御的な視点も欠かせません。

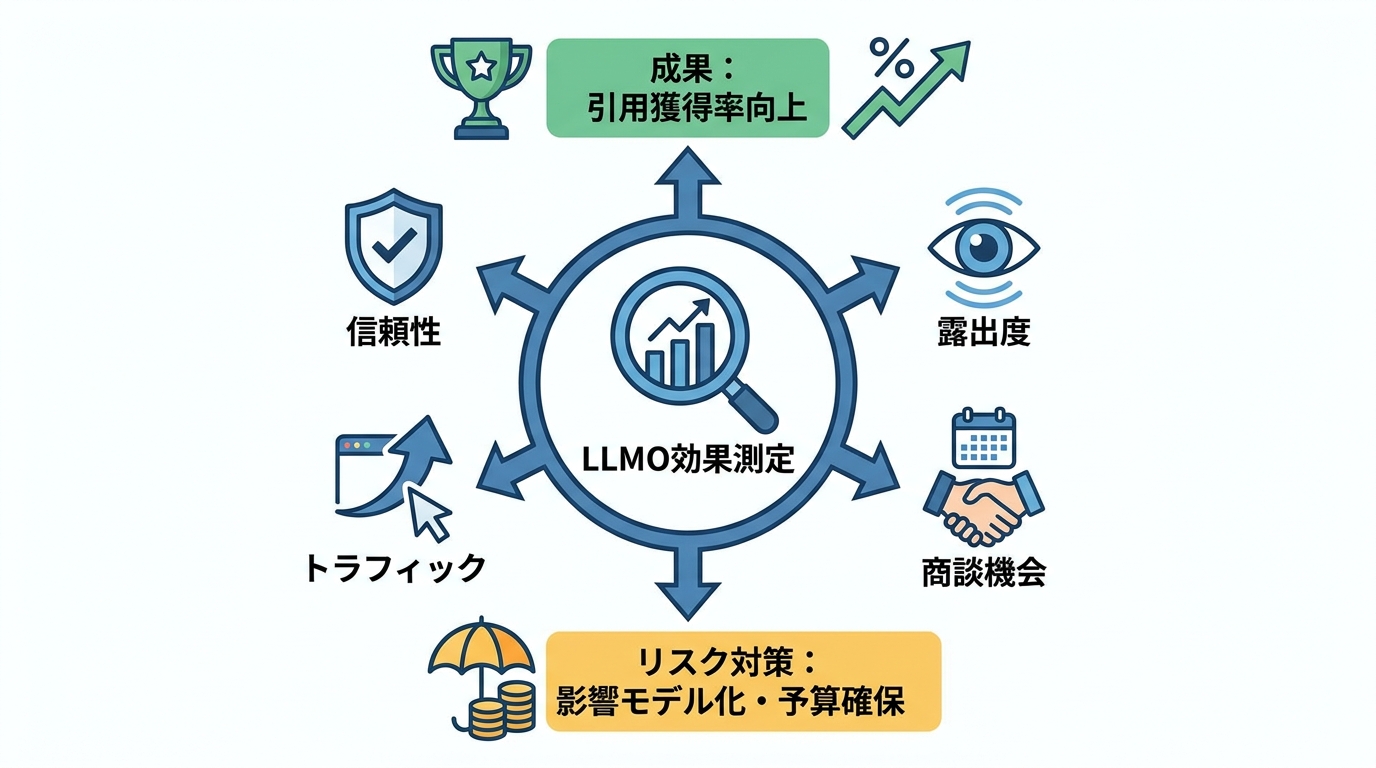

KPI設計と効果測定の実践

LLMO対策の効果を継続的に高めるには、定量的な測定と改善の繰り返しが欠かせません。測定の観点は主に四つあります。AIが自社を「信頼できる情報源」として認識しているか、AIの回答におけるブランドと商品の露出度はどの程度か、AI経由で新たなトラフィックが生まれているか、そしてそれが新規の商談機会の創出に貢献しているかです(参照*1)。

実際の成果として、検索拡張生成(Retrieval-Augmented Generation:RAG)の分析と構造化データに基づく実証的なアプローチにより、主要な6つのAI検索領域でトップ引用を獲得し、引用獲得率を最大460%向上させた事例も報告されています(参照*2)。

KPIの設計段階では、AIの可視性を失った場合の売上への影響をモデル化し、緊急時の予算をあらかじめ確保しておくことも有効です。現在の有料集客費用の15〜20%を出発点とするのが妥当な水準との見解が示されています(参照*3)。効果測定の仕組みを早い段階で整えておくことが、変化への対応力を左右します。

おわりに

生成AIが情報の入り口となる時代では、LLMO対策は「やるかやらないか」ではなく「いつ始めるか」の問題です。コンテンツの質、構造化データ、外部露出という三本柱を軸に、AIの回答を定期的に監視し、効果を数値で測定するサイクルを回すことが求められます。

AIプラットフォームの収益化やモデルの特性変化といった外部環境も常に動いています。本記事で取り上げた対策の手順やKPI設計を参考に、自社に合ったLLMO対策の第一歩を踏み出してみてください。

監修者

安達裕哉(あだち ゆうや)

デロイト トーマツ コンサルティングにて品質マネジメント、人事などの分野でコンサルティングに従事しその後、監査法人トーマツの中小企業向けコンサルティング部門の立ち上げに参画。大阪支社長、東京支社長を歴任したのち2013年5月にwebマーケティング、コンテンツ制作を行う「ティネクト株式会社」を設立。ビジネスメディア「Books&Apps」を運営。

2023年7月に生成AIコンサルティング、およびAIメディア運営を行う「ワークワンダース株式会社」を設立。ICJ2号ファンドによる調達を実施(1.3億円)。

著書「頭のいい人が話す前に考えていること」 が、82万部(2025年3月時点)を売り上げる。

(“2023年・2024年上半期に日本で一番売れたビジネス書”(トーハン調べ/日販調べ))

参照

- (*1) CustomerOne – Spot Diagnostic Service for Answer Engine Optimization (AEO, LLMO)

- (*2) 14 Recommended GEO Optimization Companies

- (*3) The Sovereign CMO – LLM Toll Booths: Preparing for AI's Monetization Era

- (*4) The Idola Tribus of AI: Large Language Models tend to perceive order where none exists

- (*5) CSO Online – Manipulating the meeting notetaker: The rise of AI summarization optimization