はじめに

X(旧Twitter)に搭載されたAIチャットボット「Grok」は、テキストや画像の生成機能を持つ一方で、出力内容を自動的に制限する「モデレート」の仕組みが組み込まれています。創作や業務目的でGrokを使う際に、意図しないモデレートが発動して出力がブロックされるケースが報告されており、解除方法や回避策を知っておくことは実用上の大きな課題です。

モデレートが発動する原因はプロンプトの文言や画像の内容だけでなく、地域ごとの規制差やフィルター強化の方針にも関わっています。本記事では、Grokのモデレートの仕組みと発動原因を整理したうえで、解除方法の可否や実践的な対処法、さらに法的・倫理的なリスクまでを順に解説します。

Grokのモデレートとは

モデレートの定義と対象範囲

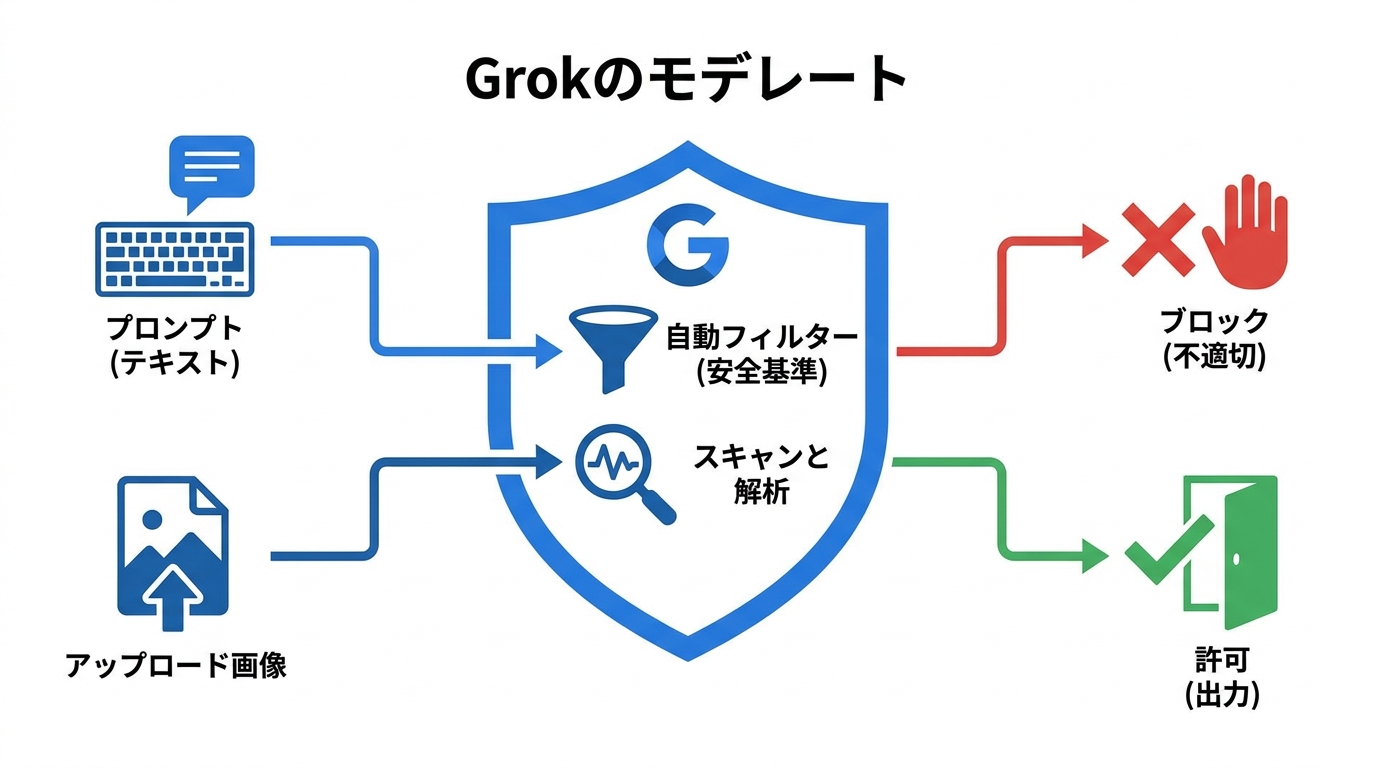

Grokにおけるモデレートとは、AIが生成するテキストや画像に対して安全性の観点から自動的にフィルターをかけ、不適切と判断されたコンテンツの出力を制限する仕組みです。対象となるのは暴力的な表現、性的な内容、未成年に関わる描写など、安全上のリスクがあるとシステムが判定した幅広い領域にわたります。

Grokの画像モデレートは無作為に作動するものではなく、安全でない・機微にあたる・制限されたコンテンツを停止する目的で設計されています。画像を表示する前に、Grokはプロンプトとアップロードされた画像を一緒にスキャンし、リスクがあると判断した場合は自動的に結果をブロックします(参照*1)。

一方で、大規模言語モデル(LLM)がコンテンツの生成だけでなく評価にも使われる場面が増えており、その判定が一貫しているか偏りがないかについては議論が続いています(参照*2)。モデレートが正確に機能しているかどうかは、利用者にとっても関心の高い論点です。

テキストと画像それぞれの検閲仕組み

テキスト生成の場面では、入力されたプロンプトに含まれる語句の組み合わせをGrokが解析し、リスクの高い内容と判断した場合に出力を拒否します。画像生成においてはプロンプトの文言に加え、ユーザーがアップロードした画像そのものもスキャンされ、両方の情報を総合してモデレートの可否が決まります(参照*1)。

2025年12月には、Grokが実在の人物の写真をもとに衣服を透けさせたり除去したりした画像を生成できる状態になっていたことが報じられました。ユーザーが実在の人物の写真をアップロードし、衣服を透明なビキニに置き換えるよう依頼すると、一般的なAIモデルよりもはるかに露骨な画像が生成されていたのです(参照*3)。この事例は、テキストと画像の両面でモデレートの精度と範囲が十分に機能していなかったことを示しています。

モデレートが発動する主な原因

特定ワードによる自動検知

Grokのモデレートが発動する典型的な原因のひとつが、プロンプトに含まれる特定の語句です。身体に関する言葉、年齢を連想させる表現、リアリズムを指定する語句、ファッションスタイルに関する用語、クローズアップの肖像に関する言葉などが自動的にリスク判定の対象になります。たとえプロンプト全体としては安全な意図であっても、システムが意図を誤解してブロックする場合があります(参照*1)。

こうした自動検知は、語句単体の意味だけでなく組み合わせでリスクスコアが上がる仕組みと考えられます。創作や商業デザインの用途であっても、フィルターに引っかかりやすい語句を無意識に使ってしまうケースは少なくありません。

アップロード画像の誤判定

Grokはプロンプトだけでなく、アップロードされた画像もスキャンしてモデレートの判定材料にしています。画像に含まれる人物の服装や姿勢、背景の要素をAIが分析し、リスクがあると判断すると結果がブロックされます(参照*1)。

問題は、本来問題のない画像でもフィルターが過剰に反応してしまう「誤判定」が起こりうる点です。肌の露出が少ないポートレートや風景写真であっても、構図や色調の特徴によってはリスクありと判定されるケースが報告されています。テキストと画像の両方を総合評価する設計だからこそ、片方が安全でも組み合わせ次第でブロック対象になる場合があります。

地域・プラットフォームごとの規制差

Grokのモデレートは、利用する地域やプラットフォームによって適用基準に差があることが指摘されています。ある検証では、VPNを使ってGrokを禁止しておりポルノ規制法のあるインドネシアとマレーシアにロケーションを変更したにもかかわらず、X上のGrokタブでビキニ姿の画像が生成されたと報じられました(参照*4)。

この事例は、地域ごとの規制が技術的に徹底されていなかった時期があることを示しています。国や地域によって法律や倫理基準が異なるなかで、モデレートの適用範囲にばらつきがあると、同じプロンプトでも結果が変わりうるため、利用者は自分の所在地での規制状況を把握しておく必要があります。

安全フィルター強化の背景

Grokのモデレートが段階的に強化されてきた背景には、実際に深刻な問題が発生した経緯があります。フランスの非営利団体AI Forensicsの推計によると、Grokが生成した画像の53%が薄着の人物を含み、そのうち81%が女性として描かれたものでした。さらに、生成画像の2%が18歳以下に見える人物を描いていたと報告されています(参照*3)。

先進的なAIシステムが、リスクに見合った安全策を欠いたまま一般公開されていることは構造的な問題だと指摘されています(参照*5)。こうした外部からの批判や調査結果を受けて、Grokの安全フィルターは段階的に厳格化されてきました。モデレートが以前よりも発動しやすくなっている背景には、過去の問題への対応という事情があります。

モデレートの解除・設定変更の可否

公式設定にオフ機能はあるか

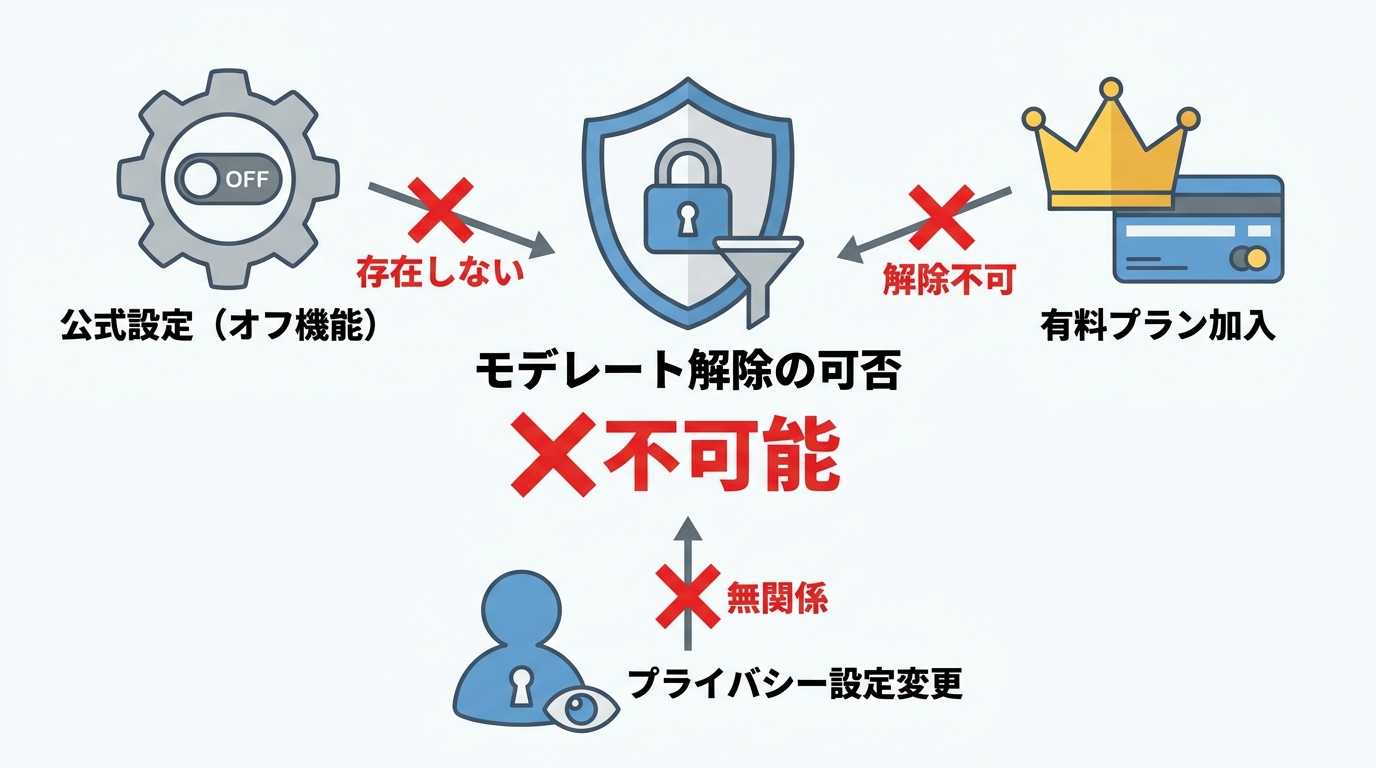

Grokの画像・動画モデレートを無効にする公式な方法は、現時点では存在しません。Grokのフィルターはシステムに組み込まれた仕組みであり、設定画面から簡単にオフにすることはできません。Redditでも多くのユーザーがこの点を確認しており、モデレートを完全に除去できるスイッチやコンテンツ設定の選択肢はないと報告されています(参照*1)。

つまり、「解除方法」として設定変更だけで対応することは現状では不可能です。モデレートはユーザー側の操作で制御できるものではなく、Grok側のシステムレベルで適用されているため、利用者は別のアプローチで対処する必要があります。

有料プランで解除できるか

有料プランに加入すればモデレートが解除されるのではないか、と考える方もいるかもしれません。しかし、Grokの開発元であるxAIは批判を受けた際、まず画像生成機能をプレミアムユーザーに限定する対応を取りました。その後もNSFW(職場で閲覧に適さない内容)に関する実在の人物のリクエストについて、X上でタグ付けされた場合に生成を阻止する措置を講じています(参照*4)。

この経緯からわかるように、有料プランはモデレートの解除ではなく、むしろ利用範囲の管理手段として位置づけられています。課金によってフィルターそのものが外れるわけではないため、有料ユーザーであってもモデレートの適用対象であることに変わりはありません。

プライバシー設定との違い

モデレートの解除方法を探すなかで、プライバシー設定の変更と混同されるケースがあります。Grokには、自分の画像やXアカウントのデータがAIの学習にどう使われるかを制御する設定が用意されています。具体的には「設定とプライバシー」から「プライバシーと安全」、さらに「Grokとサードパーティ連携」に進み、データ利用のオプションをオフにすることができます(参照*1)。

ただし、この操作はモデレートを解除するものではなく、個人データの保護が目的です。プライバシー設定を変更しても出力時のフィルターには影響しないため、モデレートの回避策とは明確に区別して理解しておく必要があります。

モデレートを回避する実践的対処法

プロンプト構造の最適化

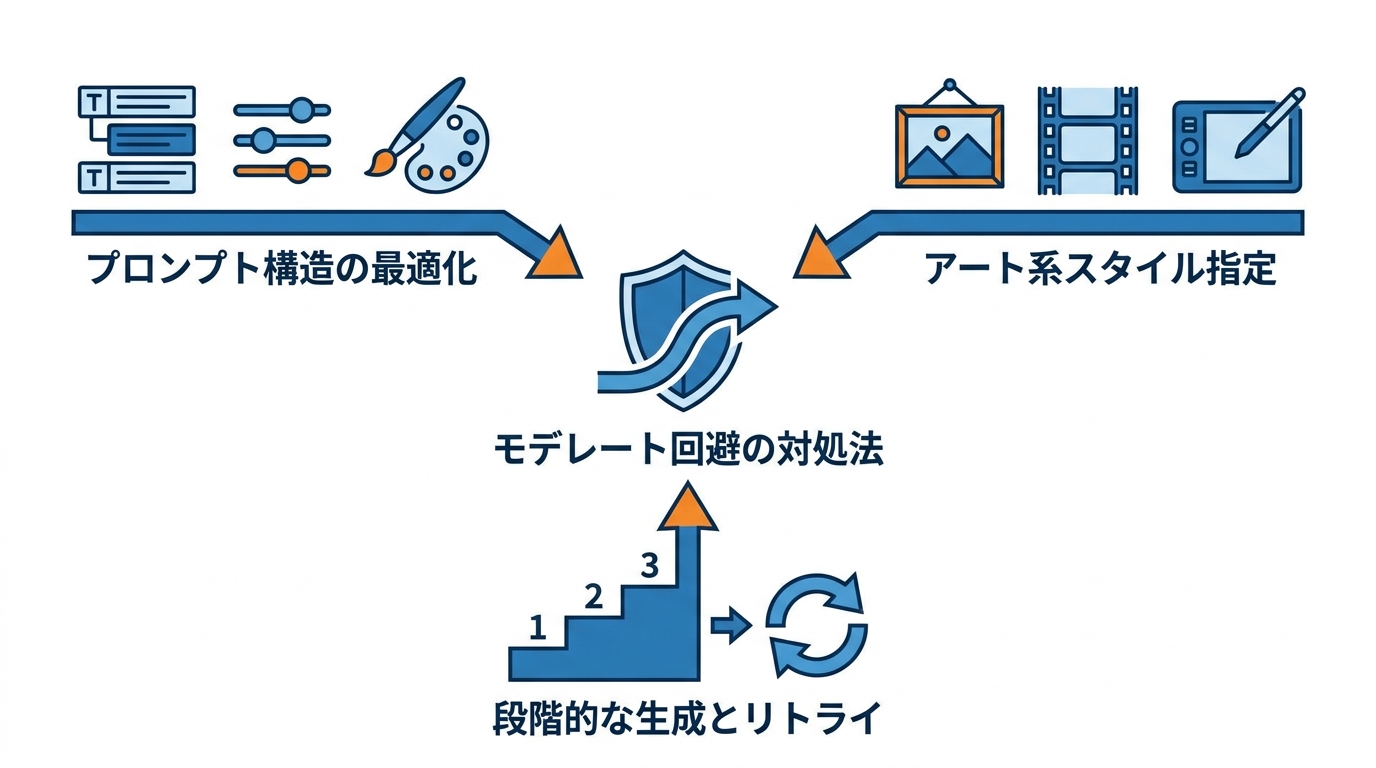

Grokのモデレートを公式に解除する手段がない以上、もっとも現実的な対処法はプロンプトの書き方を工夫することです。照明や環境の描写、芸術的なスタイルの指定、雰囲気や構図の説明に重点を置くことで、Grokが入力の意図を「機微な内容」ではなく「創作目的」と判断しやすくなり、モデレートが発動する確率を下げられます(参照*1)。

ほかのAIプラットフォームでも同様の問題は起きています。物語における愛情、喪失、トラウマ、癒し、親密さを描こうとしているにもかかわらず、わずかな官能表現や人間の脆さの描写がブロックされるという声があり、成熟したコンテンツと下品な表現は同じではないという指摘がなされています(参照*6)。プロンプトの構造を最適化することは、こうしたフィルターの過剰反応に対する汎用的な対処法でもあります。

アート系スタイル指定の活用

モデレートを回避しやすいもうひとつの手法が、プロンプト内でアート系のスタイルを明示的に指定することです。「デジタルアート」「シネマティックシーン」「コンセプトデザイン」「スタジオイラストレーション」といった用語を使ってアートワークやイラストレーションとして記述されたプロンプトは、ブロックされにくい傾向にあります(参照*1)。

この方法は、Grokのルールの範囲内で創作の自由度を高める手段として有効です。同じ被写体や構図であっても、芸術的な文脈を与えるプロンプトとそうでないプロンプトでは、モデレートの判定結果が変わることがあるため、スタイル指定をプロンプトの冒頭に置くことを習慣づけると効果的です。

段階的な生成とリトライ

一度のプロンプトで最終的な出力を得ようとするのではなく、段階的に生成を進める方法もモデレート対策として有効です。まず背景や環境だけを生成し、次に人物の姿勢や服装を追加するといったように、ステップを分けることで各段階のリスクスコアを抑えやすくなります。

ブロックされた場合でも、語句を一部入れ替えてリトライするだけで通過することがあります。Grokのフィルターはプロンプトと画像を総合的に評価するため、わずかな表現の違いが判定結果を左右する場合があるからです(参照*1)。段階的な生成とリトライの組み合わせは、フィルターの仕組みを理解したうえで取れる具体的な対処法です。

解除時の法的・倫理的リスク

各国の規制動向と罰則

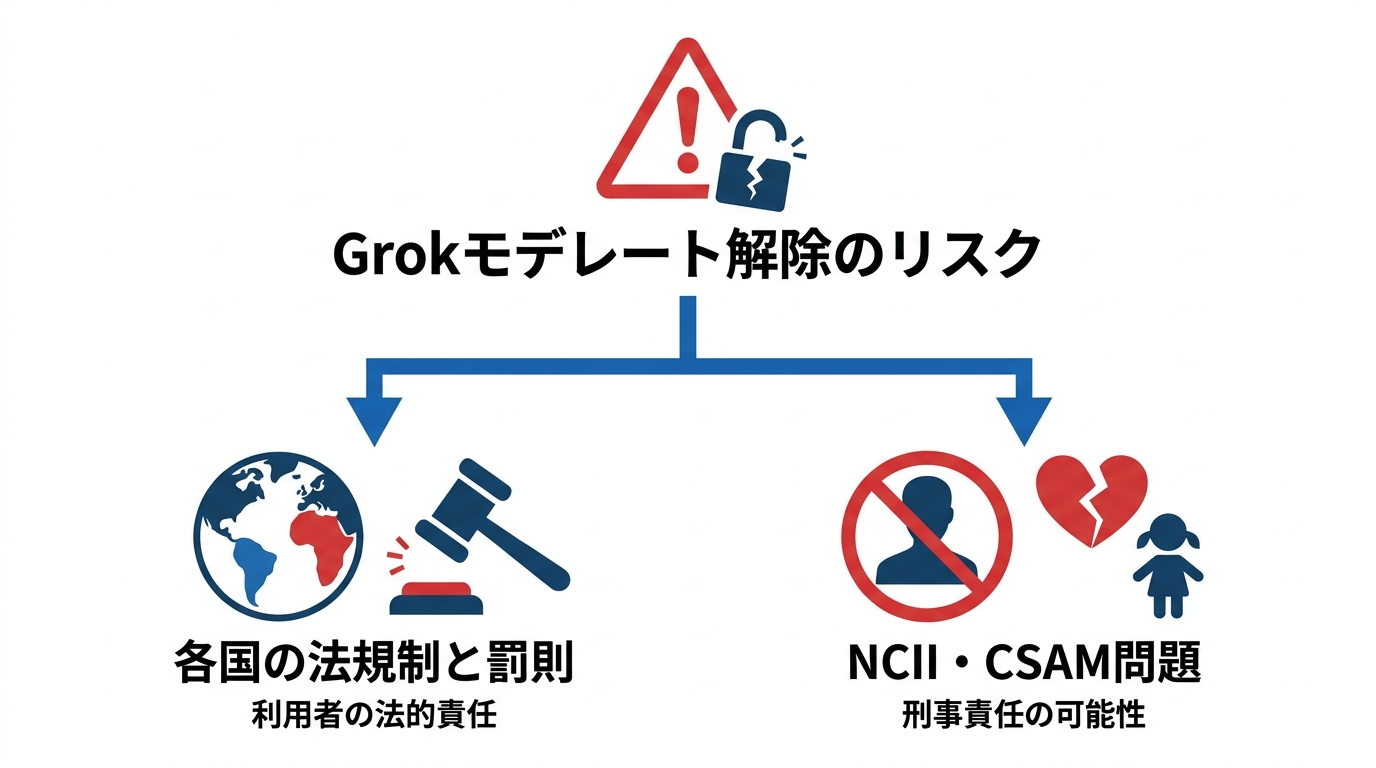

Grokのモデレートを回避・解除する行為には、法的なリスクが伴います。マレーシアとインドネシアはGrokを全面的に禁止しました。イギリスはオンライン安全法の執行を加速し、通信規制機関Ofcomが調査を開始しています。フランスは既存の調査を拡大してパリのX社オフィスに捜索に入りました。インドは法令順守に関する報告書の提出を求め、ブラジルの検察トップはXに対し5日以内にGrokの性的コンテンツ生成を停止するよう要求しました(参照*7)。

こうした動きに対してxAIは、性的なディープフェイク生成が違法となる地域においてのみ制限する対応を取りました。国際的に統一された基準がない以上、国ごとに最低限の対応を行うという姿勢を事実上表明した形です(参照*7)。利用者の側も、自分が所在する国・地域の法律によっては、モデレート回避そのものが法的責任を問われうる点を認識しておく必要があります。

NCII・CSAM問題の深刻さ

モデレートの解除方法を論じるうえで避けて通れないのが、非同意の親密画像(nonconsensual intimate imagery: NCII)と児童性的虐待素材(child sexual abuse material: CSAM)の問題です。Xのプラットフォーム規則「X Rules」は、NCIIとCSAMの両方を、コンピュータ生成のものも含めて禁止しています。さらに、本人の同意なく性的に対象化するコンテンツの投稿も明確に禁じています(参照*3)。

フランスの非営利団体の推計では、Grokの生成画像のうち18歳以下に見える人物が含まれていた割合が2%にのぼりました(参照*3)。たとえ技術的にモデレートを回避できたとしても、生成された画像がNCIIやCSAMに該当すれば、プラットフォーム規約の違反にとどまらず刑事責任に問われる可能性があります。モデレートの存在は、利用者自身を法的リスクから守る役割も担っています。

おわりに

Grokのモデレートは公式に解除する手段がなく、有料プランやプライバシー設定の変更でもフィルター自体を無効化することはできません。創作目的で利用する場合は、プロンプトの構造を最適化する、アート系スタイルを指定する、段階的に生成するといった対処法が現実的な選択肢になります。

一方で、モデレートの回避には法的・倫理的なリスクが伴い、国や地域によっては生成行為そのものが処罰の対象となりえます。モデレートの仕組みと各国の規制動向を正しく把握したうえで、自分の利用目的に合った対処法を選ぶことが求められます。

監修者

安達裕哉(あだち ゆうや)

デロイト トーマツ コンサルティングにて品質マネジメント、人事などの分野でコンサルティングに従事しその後、監査法人トーマツの中小企業向けコンサルティング部門の立ち上げに参画。大阪支社長、東京支社長を歴任したのち2013年5月にwebマーケティング、コンテンツ制作を行う「ティネクト株式会社」を設立。ビジネスメディア「Books&Apps」を運営。

2023年7月に生成AIコンサルティング、およびAIメディア運営を行う「ワークワンダース株式会社」を設立。ICJ2号ファンドによる調達を実施(1.3億円)。

著書「頭のいい人が話す前に考えていること」 が、82万部(2025年3月時点)を売り上げる。

(“2023年・2024年上半期に日本で一番売れたビジネス書”(トーハン調べ/日販調べ))

参照

- (*1) PixPretty Online – How to Turn Off Image Moderation in Grok 2026

- (*2) EurekAlert! – AI evaluates texts without bias-until source is revealed

- (*3) Default – Grok, ‘Censorship,’ & the Collapse of Accountability

- (*4) Business Insider – It Was Surprisingly Easy to Get Grok to Undress Me

- (*5) Project Syndicate – Grok Is Testing Whether AI Governance Means Anything

- (*6) OpenAI Developer Community – New content filters are crippling creative writting and narrative role-playing

- (*7) Just Security – Grok Showed the World What Ungoverned AI Looks Like