はじめに

AIモデルの大規模化と産業応用の広がりにともない、限られた計算資源や時間の中でいかに高い成果を引き出すかが課題になっています。AIによる最適化を正しく理解しないまま導入を進めると、コストの膨張や期待した精度が得られないといった問題に直面しかねません。

こうした課題を避けるには、最適化の仕組みと適用領域を把握し、費用対効果や導入時の注意点まで見通すことが欠かせません。本記事では、AIにおける最適化の定義から主要技術、業界別の活用事例、そして失敗を防ぐための判断基準までを順を追って解説します。

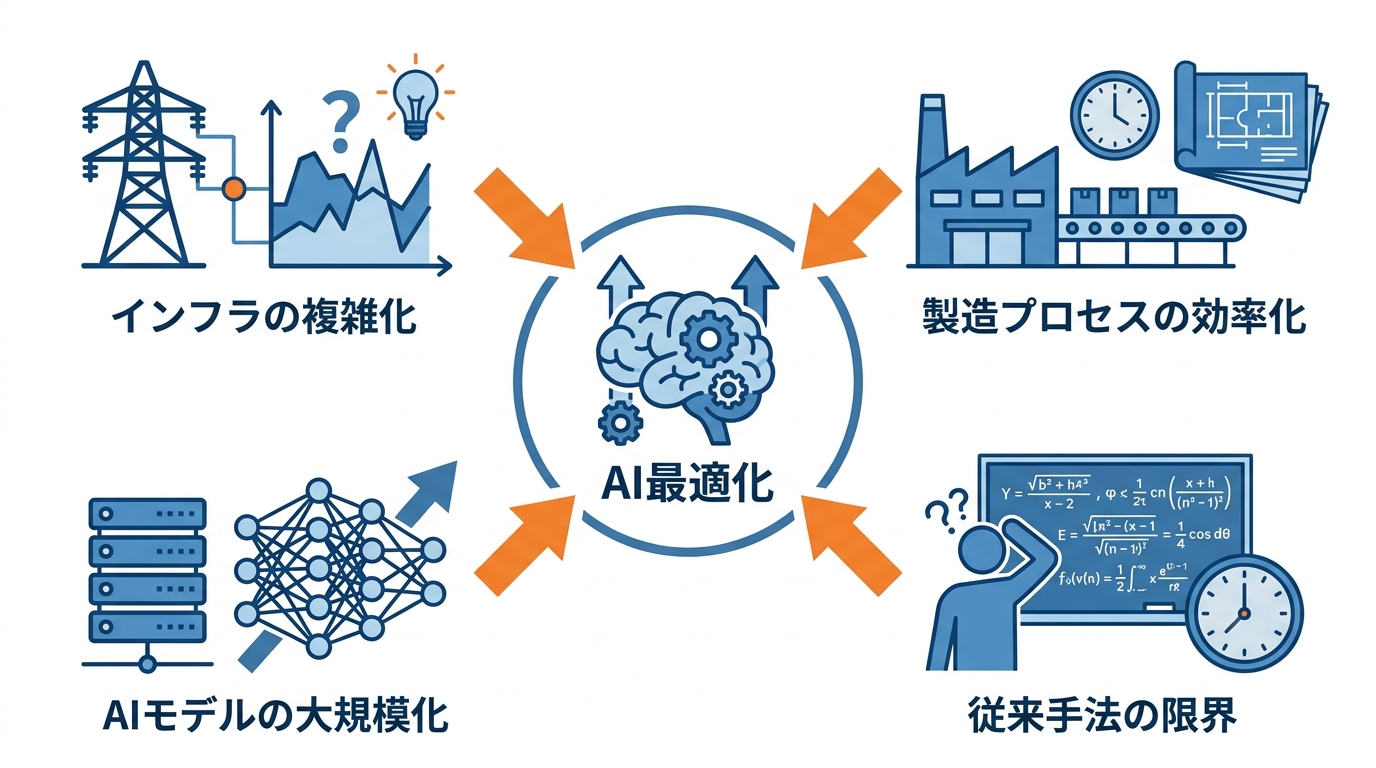

AI最適化の定義と背景

AI最適化が求められる社会的背景

AI最適化とは、AIを使って特定の目標に対する最良の解を効率よく導き出す取り組みを指します。その必要性が高まっている背景の一つが、電力をはじめとするインフラの複雑化です。電力網では、投入される電力量と消費される電力量を常に正確に一致させなければなりません。しかし需要側には不確実性があり、利用者が事前に使用量を登録するわけではないため、推定や予測が不可欠です(参照*1)。

同様の構造は製造分野にも見られます。設計工程では、仮想的な解析とその評価を繰り返す必要があり、計算に長い時間がかかることがパイプライン全体のボトルネックになります。とくに初期段階では、高精度なシミュレーションが貴重な時間と資源を浪費する場合があります(参照*2)。こうした現場の課題が、AIによる最適化への需要を押し上げています。

さらに、AIモデル自体の大規模化と構造の複雑化も見逃せません。モデルが巨大になるほど、本番環境への展開にかかる性能面やコスト面の負担が増すため、研究者やエンジニアは新たな最適化手法を絶えず開発しています(参照*3)。

従来手法との違い

従来の最適化手法では、人が問題の構造を分析し、数理的なルールや近似式を設計して解を求めるのが一般的でした。電力網の運用はその典型で、供給と需要を最適にバランスさせる問題は計算コストが非常に高いため、運用者は近似を用いて現実的な時間内に解を得ています。しかしこの近似はしばしば誤りを含み、再生可能エネルギーの導入が進むとずれがさらに大きくなります(参照*1)。

AIによる最適化は、大量のデータからパターンを学習することで、より正確な近似をより速く提供できる点が従来手法と異なります。製造設計の領域でも、シミュレーションに数時間から数日かかる処理を、データ駆動型のモデルがほぼ瞬時に推定値を返すことで置き換えられる可能性が示されています(参照*2)。人手による試行錯誤の回数を減らし、反復にかかる時間そのものを短縮できる点が、AI最適化の大きな強みといえます。

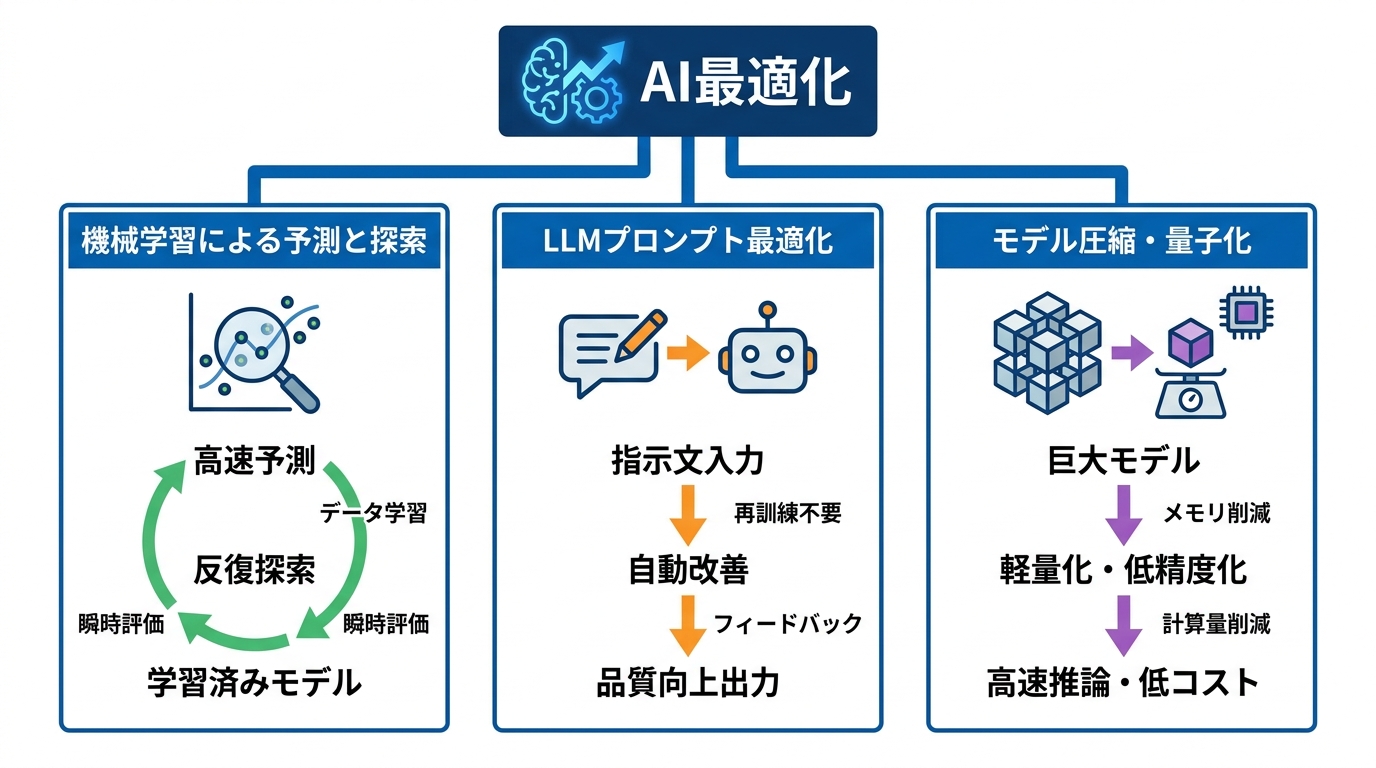

AI最適化の仕組みと主要技術

機械学習による予測と探索

AI最適化を支える基本的な仕組みの一つが、機械学習を使った予測と探索です。大量のデータから入力と出力の関係を学習し、未知の条件に対しても結果を高速に予測できるモデルを構築します。TAG U-NETと呼ばれるモデルは、数千種類の形状が温度や圧力といったストレスにどう反応するかをシミュレーションし、その結果を学習データとして訓練されました(参照*2)。

このように学習済みモデルを用いれば、従来は長時間のシミュレーションが必要だった評価を瞬時に行えます。設計者は短い時間で多くの候補を探索でき、反復の回数を大幅に増やすことが可能になります。予測の精度とスピードを両立させることが、機械学習を使った最適化の核心です。

LLMを活用したプロンプト最適化

大規模言語モデル(LLM)の性能を引き出すうえで、プロンプトの最適化が有力な手段になっています。プロンプトとは、LLMに与える指示文のことです。プロンプト最適化を使った自己改善は、最先端の強化学習によるファインチューニングを上回る成果を示す研究がある一方、多くの用途では候補を生成することよりも信頼できるフィードバックを得ることのほうがコストが高いという課題も指摘されています(参照*4)。

こうした課題に対し、ダッシュボード上のチャット画面でプロンプトを入力すると、現在のベストプラクティスに沿って自動で書き換えて返す仕組みも提供されています。データセットと組み合わせることで、プロンプトの自動改善をさらに強力に進められます(参照*5)。プロンプトの質を体系的に高めることで、モデル自体を再訓練しなくても出力の精度を向上させられる点が、この手法の利点です。

モデル圧縮・量子化による推論最適化

AIモデルの推論を高速かつ低コストにするために、モデル圧縮と量子化の技術が広く用いられています。量子化とは、モデル内部の数値をより少ないビット数で表現することで、計算量とメモリ使用量を削減する手法です。訓練後量子化(PTQ)は、既存のモデルをFP16やBF16といった形式からFP8やINT4などの低精度形式に変換する方法で、元の訓練ループに手を加えずに遅延の短縮と処理量の向上を即座に得られます(参照*3)。

さらに、ベクトル量子化におけるメモリ負荷の課題に対応する圧縮手法も開発されています。TurboQuantと呼ばれるこの手法は、QJLおよびPolarQuantという技術を組み合わせて構成され、AIモデルの性能を損なわずにキーバリューのボトルネックを削減できることが検証で確認されています(参照*6)。推論段階でのリソース消費を抑えることは、大規模モデルを実用化するうえで避けて通れない課題であり、量子化と圧縮はその中核的な解決策です。

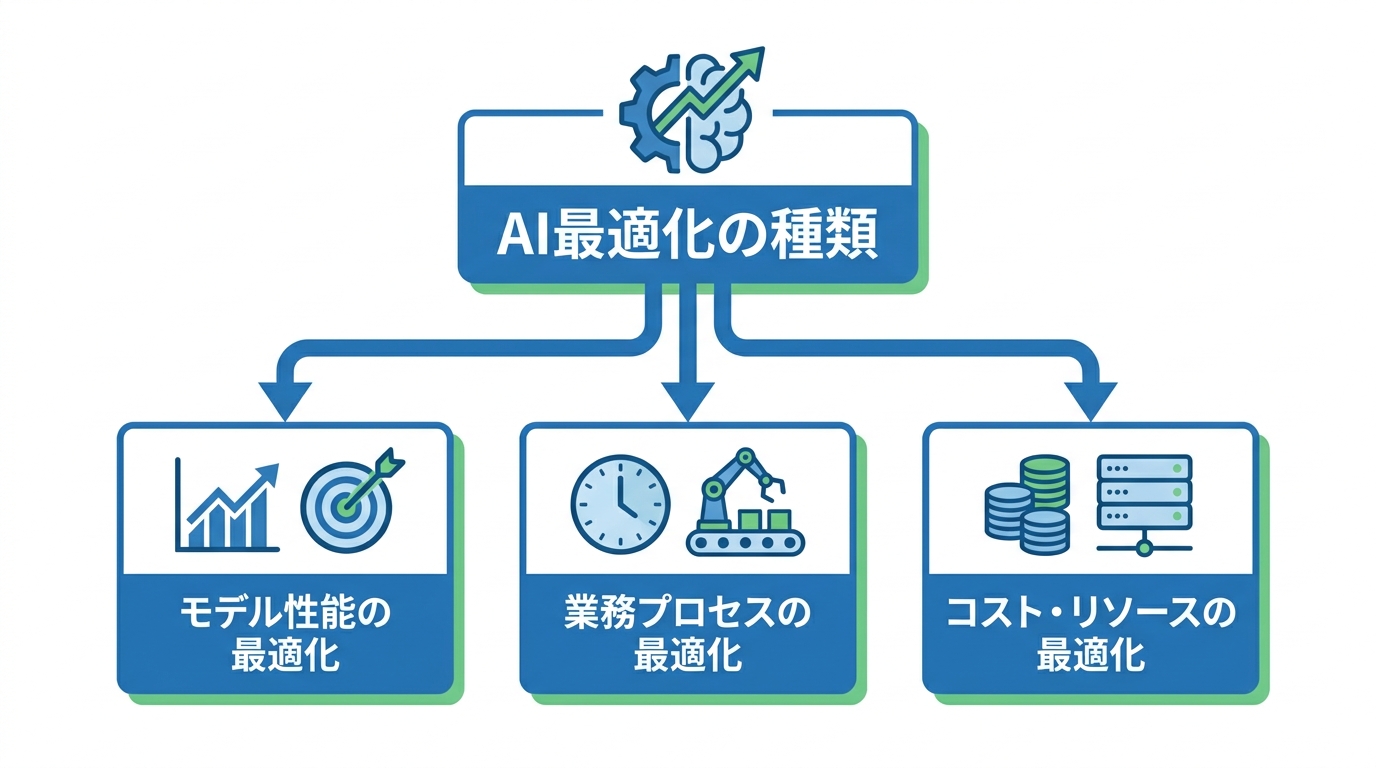

AI最適化の種類と分類

モデル性能の最適化

AI最適化の第一の分類は、モデルそのものの性能を高めることです。精度の改善にはフィードバックの体系的な組み込みが有効であり、金融サービスの分類タスクにおいて、体系的なフィードバックの取り込みを繰り返すことで初期の正答率60%から最終的に100%に到達した事例があります。各反復で前回の弱点を特定し、構造化された批評を通じてモデルを継続的に改善する手法です(参照*7)。

このように、単に大量のデータで訓練するだけでなく、出力の弱点を分析して段階的に修正していくプロセスが、モデル性能の最適化では欠かせません。精度の数値目標を設定し、反復ごとに改善幅を確認することで、最適化の進み具合を定量的に把握できます。

業務プロセスの最適化

第二の分類は、AIを業務プロセスに組み込み、手作業や待ち時間を減らすことです。大規模なインフラを運用する現場では、容量効率化プログラムにAIを導入し、手動の調査で約10時間かかっていた診断を約30分に短縮した実績があります。さらにAIエージェントが効率化の機会を検出してからレビュー可能なコード変更を準備するまでの作業を完全に自動化し、数百メガワット規模の電力を回収しています(参照*8)。

業務プロセスの最適化では、人間が担っていた判断と実行の一部をAIに移管することで、処理速度と再現性の両方を向上させられます。どの工程にAIを適用するかを見極めることが、効果を最大化する鍵になります。

コスト・リソースの最適化

第三の分類は、計算資源やインフラコストの最適化です。推論性能の向上について、Blackwellプラットフォームはラック規模のシステムで推論のAI工場生産性を50倍に高め、収益可能性を40倍、処理量を30倍、エネルギー効率を25倍、水効率を300倍に改善するとしています(参照*9)。ハードウェアの選定だけでも、コストとリソースの消費量は大きく変わります。

一方、コスト最適化されたワークロードは必ずしも低コストのワークロードではなく、大きなトレードオフが存在します。短期的な戦術的アプローチは反応的でしかなく、長期的な財務責任を果たすには、優先順位づけ・継続的な監視・繰り返し可能なプロセスを備えた戦略が必要です(参照*10)。コスト削減だけを目的にするのではなく、性能とのバランスを長期的に管理する視点が求められます。

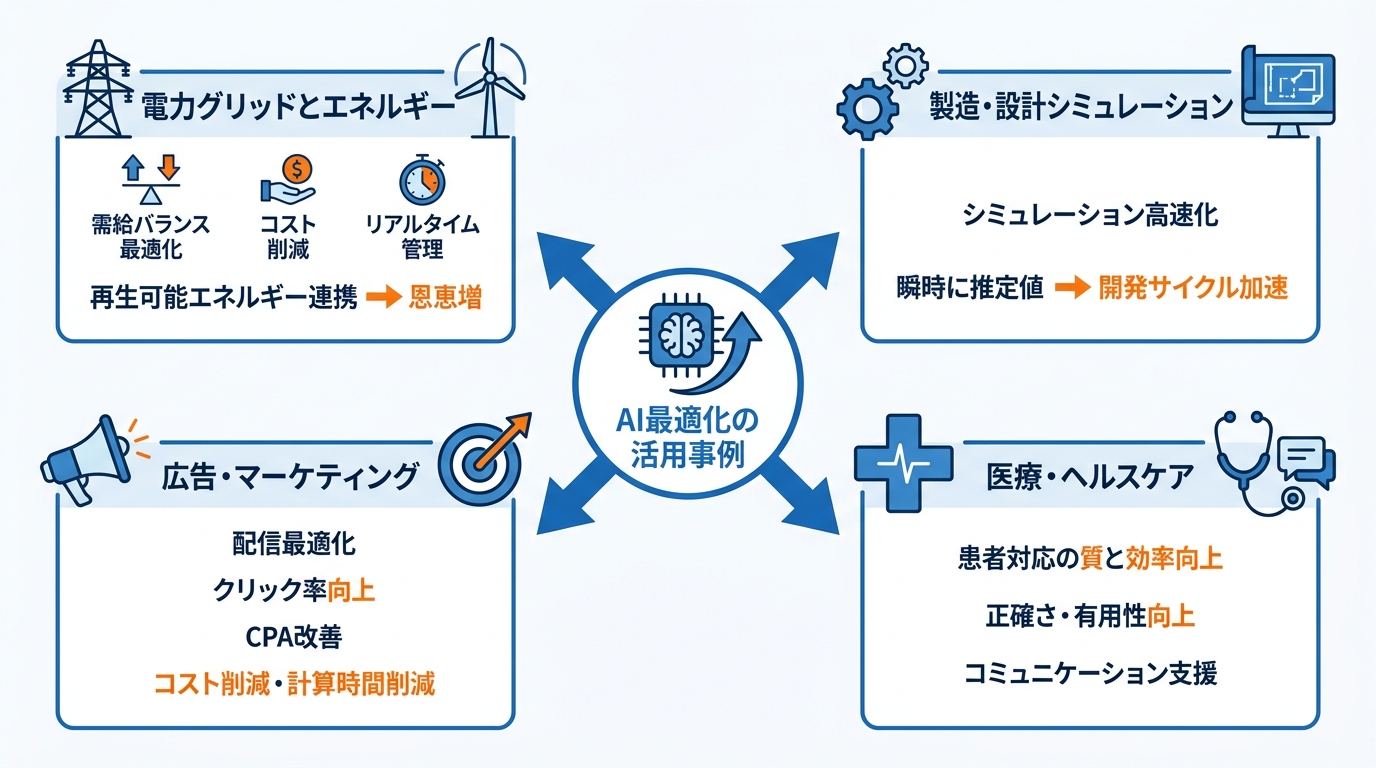

業界別の活用事例

電力グリッドとエネルギー分野

電力網の運用では、供給と需要のバランスを最適に保ちつつコストを削減する最適化問題が日常的に生じています。この問題は計算コストが極めて高く、運用者は現実的な時間で解くために近似を使わざるを得ません。しかし近似には誤差が伴い、再生可能エネルギーを多く組み込むほどそのずれは拡大します(参照*1)。

AIは、より正確な近似をより高速に提供し、リアルタイムで運用に組み込むことでこの問題に対処します。運用者が事後的に対応するだけでなく、先を見越して電力網を管理できるようになる点が大きな変化です。再生可能エネルギーの比率が高まるほど、AIによる最適化の恩恵が増す構図といえます。

製造・設計シミュレーション

製造・設計分野では、シミュレーションの高速化がAI最適化の代表的な活用先です。従来のシミュレーションは完了までに数時間から数日かかることがありましたが、TAG U-NETのようなデータ駆動型モデルを使えば、ほぼ瞬時に推定値を得られます。このモデルは数千種類の形状に対する温度や圧力への反応をシミュレーションし、その結果で機械学習モデルを訓練して構築されました(参照*2)。

設計の初期段階で繰り返し行われる評価作業が高速化されれば、エンジニアはより多くの設計案を短期間で検討できます。計算時間がボトルネックだった工程にAIを挿入することで、開発全体のサイクルを加速できる構造です。

広告・マーケティング領域

広告・マーケティングの分野では、AIによる配信最適化が具体的な成果を生んでいます。地域向けSNSプラットフォームが導入したクリック最適化では、CPM入札と比較してクリック率が平均134%向上しました。同じく、コンバージョン最適化を利用した広告主はCPAの中央値で35%の改善を達成しています。いずれも2024年から2025年にかけて11か月間のテストで確認された数値です(参照*11)。

また、広告配信の裏側でもAI最適化は効果を発揮しています。広告技術基盤において最初に最適化された20件のSparkジョブで約100万ドルのコスト削減が実現され、2025年に計算時間の10%削減を見込んでいます。これらは予測値ではなく実測に基づく節約であり、最適化を拡張するほど効果が積み上がる構造です(参照*12)。

医療・ヘルスケア領域

医療・ヘルスケア分野でも、AIによる最適化が患者対応の質と効率を高めています。整形外科領域のチャットボットに対する人間の評価では、正確さが5段階中平均4.55、有用性が4.61という高い評価を得ました。使いやすさは4.90、回答の明瞭さは4.77と、利用体験の面でも良好な結果が出ています。2025年6月時点で、このチャットボットは累計9,514件のやり取りを処理しました(参照*13)。

医療分野でのAI最適化は、診断の補助から患者とのコミュニケーション支援まで幅広い可能性を持ちます。ただし複数のAIを組み合わせる場合には、個々の性能だけでなくシステム全体としての情報の流れにも配慮が必要になります。

導入の判断基準と注意点

費用対効果の見極め方

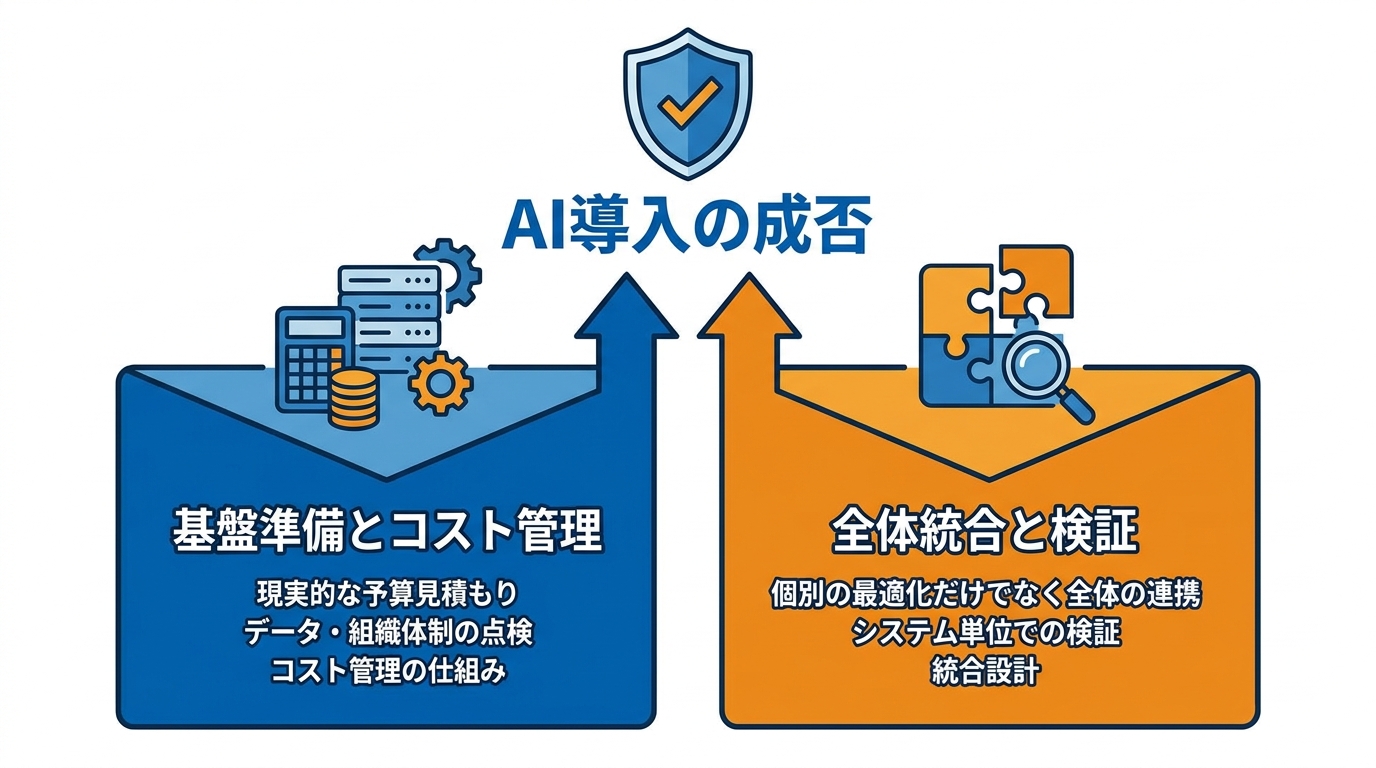

AI最適化の導入にあたっては、現実的な予算の見積もりが出発点になります。機能要件・非機能要件・人員・プロセスを含む交渉の余地がないコストをすべてカバーし、将来の成長分も織り込んだ予算を設定することが求められます。財務上の上限を定めたうえで、支出を配分済み予算と照合する仕組みを作り、特定のしきい値を超えた際に通知を受けることで過剰支出を防げます(参照*10)。

一方で、AIツールに対する投資対効果の測定と帰属は依然として難しい課題です。データの入手性と品質が主要な障壁として残っており、検証や品質保証のプロセスはまだ成熟途上にあります。さらに、既存の設計ワークフローへの統合には大がかりな変革管理が必要です(参照*14)。導入前に、データ基盤の整備状況と組織の受け入れ体制の両面を点検しておくことが費用対効果を見極める第一歩です。

失敗パターンと回避策

AI最適化の導入で見落とされがちなのが、個々の構成要素の性能が高くてもシステム全体では期待どおりに機能しないという問題です。医療分野の複数エージェントシステムに関する研究では、構成要素を個別に最適化したシステムが情報の正確さで85.5%というプロセス指標を記録したにもかかわらず、診断精度では67.7%にとどまりました。これに対し、上位の複数エージェントシステムは診断精度77.4%を達成しています(参照*15)。

この結果は、部品レベルの最適化だけでなく、エージェント間の情報の流れと互換性に配慮する必要があることを示しています。構成要素の性能指標が優れていても、全体の統合設計を怠れば、かえって精度が下がるという逆説が起こりえます。AI最適化を導入する際には、個々のモジュールの性能だけでなく、それらがどのように連携するかをシステム単位で検証する工程を設けることが、失敗を避けるうえで有効です。

おわりに

AIによる最適化は、電力網の運用から製造設計、広告配信、医療まで幅広い領域で具体的な成果を生み出しています。その効果を引き出すには、モデル性能・業務プロセス・コストという3つの最適化の視点をバランスよく押さえることが欠かせません。

同時に、構成要素ごとの性能が高くても全体設計が伴わなければ成果につながらないという教訓や、データ品質や変革管理の課題も見えてきました。導入を検討する際は、まず自社の業務課題とデータ基盤を照らし合わせ、どの種類の最適化が最も効果を発揮するかを見定めるところから着手してみてください。

監修者

安達裕哉(あだち ゆうや)

デロイト トーマツ コンサルティングにて品質マネジメント、人事などの分野でコンサルティングに従事しその後、監査法人トーマツの中小企業向けコンサルティング部門の立ち上げに参画。大阪支社長、東京支社長を歴任したのち2013年5月にwebマーケティング、コンテンツ制作を行う「ティネクト株式会社」を設立。ビジネスメディア「Books&Apps」を運営。

2023年7月に生成AIコンサルティング、およびAIメディア運営を行う「ワークワンダース株式会社」を設立。ICJ2号ファンドによる調達を実施(1.3億円)。

著書「頭のいい人が話す前に考えていること」 が、82万部(2025年3月時点)を売り上げる。

(“2023年・2024年上半期に日本で一番売れたビジネス書”(トーハン調べ/日販調べ))

参照

- (*1) MIT News | Massachusetts Institute of Technology – 3 Questions: How AI could optimize the power grid

- (*2) AI model accelerates design process

- (*3) NVIDIA Technical Blog – Top 5 AI Model Optimization Techniques for Faster, Smarter Inference

- (*4) arXiv.org – Bayesian Optimization in Language Space for Eval-Efficient Self-Improving AI

- (*5) Prompt optimizer

- (*6) TurboQuant: Redefining AI efficiency with extreme compression

- (*7) Amazon Web Services – Optimizing enterprise AI assistants: How Crypto.com uses LLM reasoning and feedback for enhanced efficiency

- (*8) Engineering at Meta – Capacity Efficiency at Meta: How Unified AI Agents Optimize Performance at Hyperscale

- (*9) NVIDIA Blog – How to Optimize AI Factory Inference Performance

- (*10) Docs – Cost Optimization design principles

- (*11) Nextdoor Introduces AI-Driven Ad Performance Optimization and New Video Ad Formats

- (*12) PubMatic – Scaling AI-powered Spark Job Optimization with Sparkle AI Agent

- (*13) JMIR AI – Development and Evaluation of a Retrieval-Augmented Generation Chatbot for Orthopedic and Trauma Surgery Patient Education: Mixed-Methods Study

- (*14) Using Generative AI to Design Low-Carbon Products and Services

- (*15) arXiv.org – [2506.06574] The Optimization Paradox in Clinical AI Multi-Agent Systems