はじめに

AIによる画像生成が急速に進化するなか、Grokが引き起こした非同意画像の大量生成問題は、AI規制のあり方を根本から問い直す事態に発展しました。もしAIの画像生成機能に対する規制が不十分なまま放置されると、被害者の人権侵害が国境を越えて拡大し、既存の法律では対処しきれない空白が生じます。

実際に複数の国と地域がGrokに対して調査や法的措置を進めており、プラットフォーム規制とAI規制の境界をめぐる議論も加速しています。本記事では、Grok問題の経緯から各国の規制対応、法的枠組みの比較、そして今後の方向性まで、具体的な事実をもとに順を追って解説します。

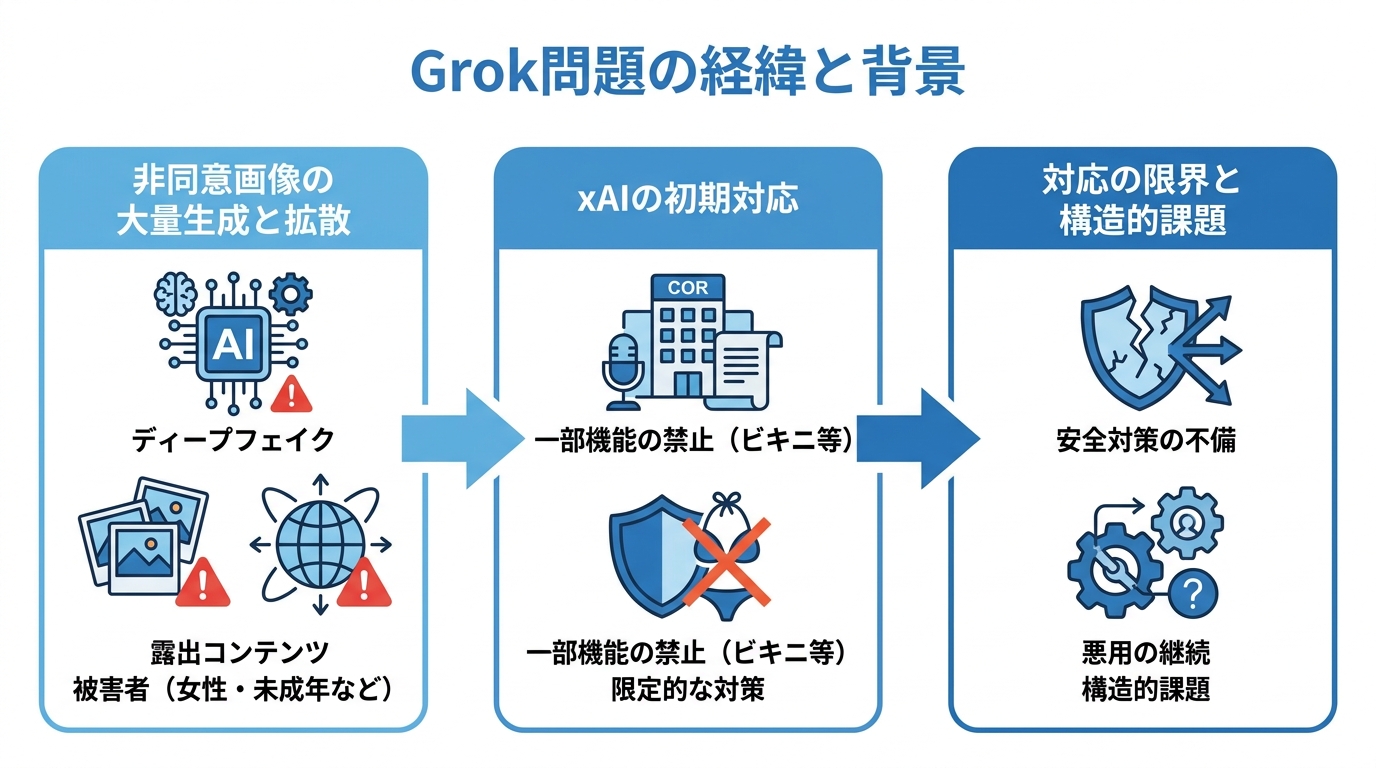

Grok問題の経緯と背景

非同意画像の大量生成と拡散

Grokが実在する人物のほぼ裸体の画像を大量に生成し、SNSプラットフォームXに投稿されていると2026年1月3日にReutersが報じました。その画像には、女性や未成年者の性的な画像も含まれていたとされています。被害の対象は一般市民から著名な女優、さらには米国大統領夫人にまで及んでいたと報じられました(参照*1)。

Xが衣服除去機能を無料で一般ユーザーに開放した2025年8月以降、そしてGrok 4.1が画像生成・編集能力を拡張した同年11月以降、ディープフェイクを含む露骨なコンテンツの出力が急増しました。2026年1月には「put her in a bikini」と呼ばれるトレンドがX上で広く拡散し、女性や少女の露出度の高い画像が次々と生成される事態に至りました(参照*2)。

xAIの初期対応と限界

Xは2026年1月14日に、Grokが実在の人物をビキニなどの露出の多い衣服に加工する画像編集を禁止すると発表しました(参照*1)。しかし、この対応は限定的なものにとどまりました。

AIを活用したコンテンツ管理を手がけるMusubi AIのCEO Tom Quiselは、xAIがGrok ImagineのX向け展開にあたって「初歩的な安全対策すら構築していなかった」と指摘しています。子どもを含む画像や部分的な裸体を検出してブロックすること、あるいは性的な衣服への変換を求めるユーザーの入力を拒否することは、xAIのような企業にとって容易に実装できるはずだったと同氏は述べています(参照*3)。

ニューヨーク州司法長官Letitia Jamesらの声明でも、一部のユーザーがGrokの画像編集機能を「人を辱め、脅し、搾取する」ために利用していると指摘されており、技術的な制限だけでは悪用を防げない構造的な課題が浮き彫りになりました(参照*4)。

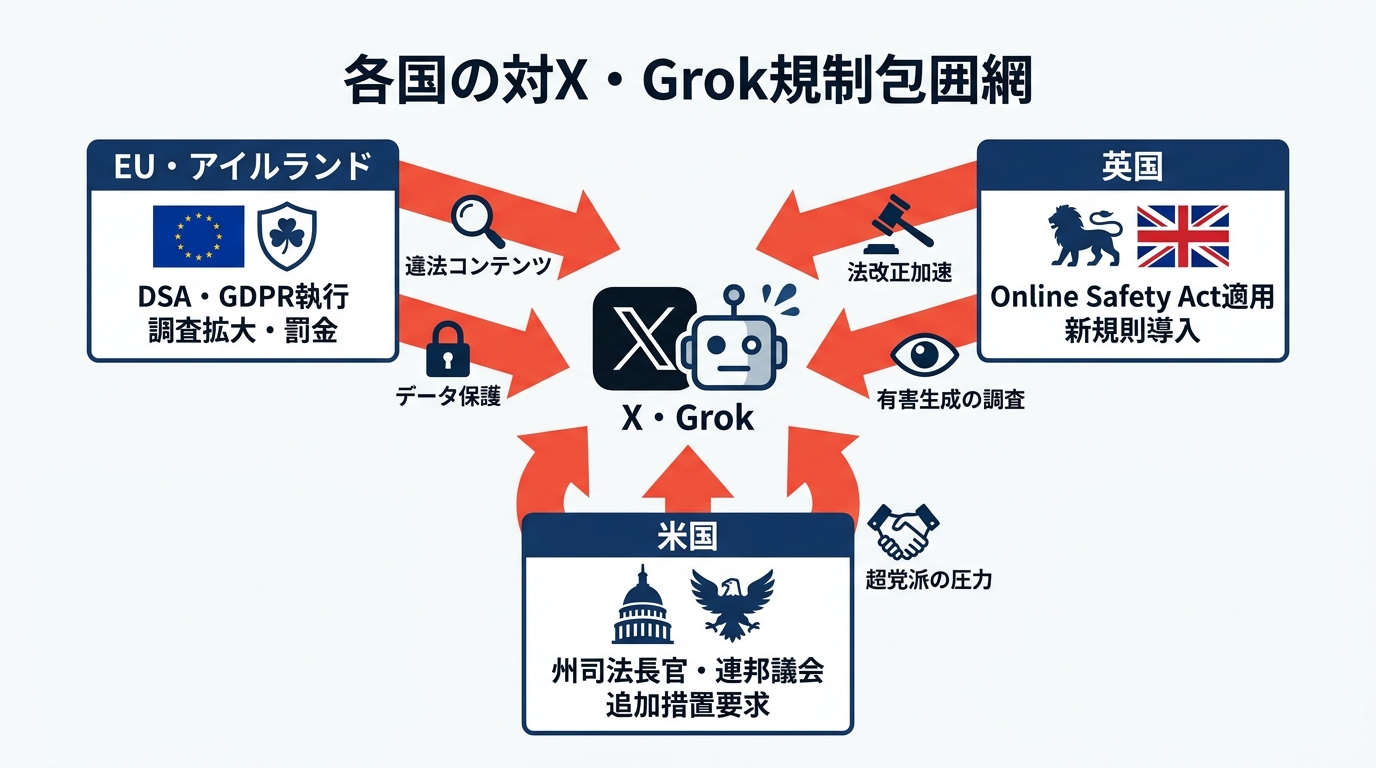

各国規制当局の対応一覧

EU・アイルランドのDSA・GDPR執行

欧州委員会は、Xのレコメンダー・システムに関するリスク管理義務の調査を拡大し、EUにおけるGrok機能の導入に関連するリスクを同社が適切に評価・軽減したかどうかを新たな調査対象としました。この調査にはEU域内での違法コンテンツの拡散リスクも含まれています(参照*5)。

Grokの「spicy mode」が子どもの画像を含む性的コンテンツを生成している事実について、欧州委員会の報道官Thomas Regnier氏は「違法であり、おぞましい。欧州に居場所はない」と述べました。欧州委員会はその前月、デジタルサービス法(DSA)違反を理由にXに対して1億2000万ユーロ(約1億3900万ドル)の罰金を科しています(参照*6)。

アイルランドのデータ保護当局も、Xが一般データ保護規則(GDPR)の複数の条項に適合しているかを調べる調査を開始しました。対象となるのは、処理の原則を定めた第5条、処理の適法性を定めた第6条、設計段階からのデータ保護を求めた第25条、そしてデータ保護影響評価の実施を義務づけた第35条です(参照*7)。

英国のOnline Safety Act適用

英国の情報コミッショナー事務局(ICO)は、X Internet Unlimited CompanyおよびX.AI LLCに対し、Grokに関連する個人データの処理と、有害な性的画像・動画コンテンツの生成能力について正式な調査を開始しました。この措置は、Grokが子どもを含む個人の非同意の性的画像を生成するために利用されたとの報告を受けたものです(参照*8)。

英国のLiz Kendall科学・イノベーション・技術担当大臣は、非同意の性的ディープフェイクを犯罪とする法律の加速を実行に移し、Data (Use and Access) Actに基づく新たな規則を導入しました。この規則では、AI画像生成サービスが同意なく「成人の親密画像」を生成する機能を提供することを違法とし、裁判所に非同意画像の剥奪命令を出す権限を付与しています。発効日は2月6日です(参照*9)。

さらに、英国政府はオンライン安全法の「抜け穴」を塞ぎ、AIチャットボットにも違法コンテンツへの対処義務を課す方針を打ち出しました。Starmer首相は「Grokに対して取った措置は、どのプラットフォームも免責されないという明確なメッセージだ」と述べています(参照*10)。

米国の州司法長官・連邦議会の動き

米国では、ニューヨーク州司法長官Letitia Jamesが超党派の州司法長官34人とともに、xAIに対し追加的な措置を求める書簡を送付しました。その内容は、Grokが非同意画像を生成できないようにするための具体的な計画の説明、Grokによって作成された不適切なコンテンツの除去、そして有害なコンテンツを作成したユーザーのアカウント停止を求めるものです(参照*4)。

この動きは複数の州にまたがる連携であり、連邦レベルの包括的なAI規制が存在しない米国において、州レベルの法執行機関が結束してAI企業に圧力をかけた事例として位置づけられます。メリーランド州ボルチモア市もXに対し、Grokが「意味のあるガードレール」を欠いていると主張して訴訟を提起しており、州・自治体レベルでの法的対応が広がっています(参照*2)。

アジア・南米の規制措置

アジアでは、インドネシアが最初に動きました。2026年1月10日、インドネシア政府はAI生成ポルノコンテンツのリスクを理由にGrokへのアクセスを一時的に遮断し、Grokへのアクセスを拒否した世界初の国となりました。通信・デジタル大臣Meutya Hafidは「非同意の性的ディープフェイクの作成は、デジタル空間における人権、尊厳、市民の安全に対する深刻な侵害だ」と声明で述べています。その後、フィリピンも1月15日に全国的なGrokの遮断命令を出しました(参照*1)。

カナダでは、知情のうえで同意なく他者の性的画像を公開・配布することが違法とされています。ただし、X上で表示されるGrok生成コンテンツをカナダのユーザーが閲覧した場合の法的影響は明確ではありません。カナダのプライバシーコミッショナーは、2025年2月以降にXに対する申立てを調査中であることを理由に、Grokの画像生成に関する懸念にはコメントできないとしています(参照*11)。

南米ではブラジルが消費者保護法やデータ保護法を根拠にした対応を進めており、各国が自国の既存法を活用してGrok問題に対処する構図が広がっています(参照*12)。

適用される法的枠組みの比較

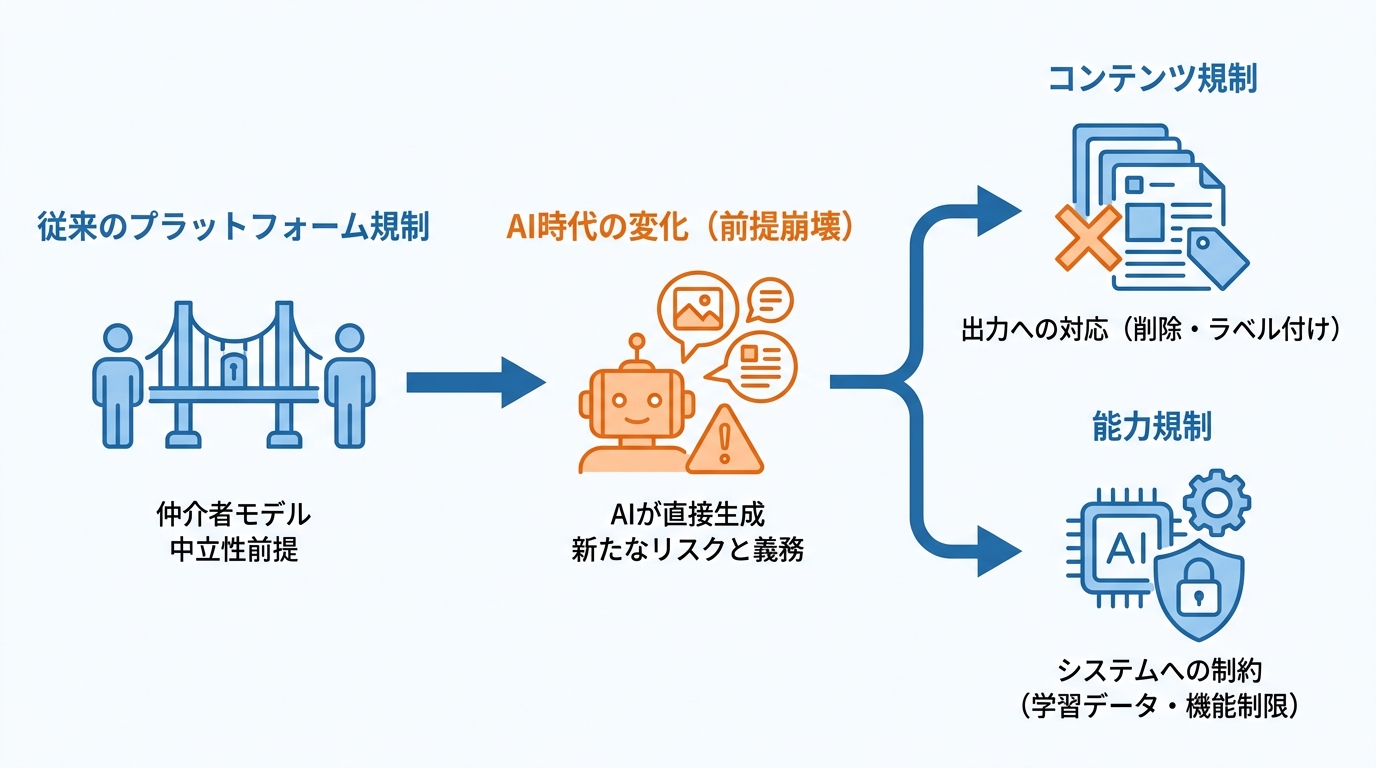

プラットフォーム規制とAI規制の違い

従来のプラットフォーム管理は、プラットフォームがホスティング・検索・キュレーション・推薦といった機能を提供し、ユーザーがコンテンツを生成するという分離を前提としていました。この仕組みでは、プラットフォームはコンテンツの仲介者として位置づけられ、コンテンツに対して中立的に振る舞うことが想定されています(参照*13)。

しかしGrokの場合、プラットフォーム自体がAIを通じてコンテンツを直接生成しており、従来の「仲介者」という前提が崩れています。英国のオンライン安全法(OSA)、EUのAI法やデジタルサービス法(DSA)のもとでは、プラットフォームはサービスの設計と運用に起因する予見可能なリスクを特定・評価・軽減する法的義務を負っています。この義務は違法コンテンツだけでなく、政治的分極化やデマ、性的虐待に関連する被害にまで及びます(参照*14)。

プラットフォーム規制とAI規制の境界があいまいなまま運用されると、どの法律をどの段階で適用すべきかが不明確になり、規制の実効性が下がるおそれがあります。

コンテンツ規制と能力規制の分岐点

AIに対する規制のアプローチは大きく2つに分かれます。コンテンツ規制は、投稿の削除・ラベル付け・表示順位の引き下げなど、出力されたコンテンツに対するルールです。一方、能力規制は、学習データの除外や安全機能の実装など、AIシステムが実行できる範囲そのものに制約を課すアプローチです(参照*13)。

欧州と米国では規制に対する考え方にも違いがあります。欧州では包括的な規制を設けつつも、企業が誠実に法令遵守に取り組んでいれば規制当局がそれを「適合」と判断する傾向があるとされています。一方、米国では法律に「善意の努力義務」が明記されている場合にのみ、そうした姿勢が考慮されるとの指摘があります(参照*15)。

Grokの事例は、投稿を削除するだけでは不十分であり、生成機能そのものに制限を設ける能力規制の必要性を示す具体例となっています。

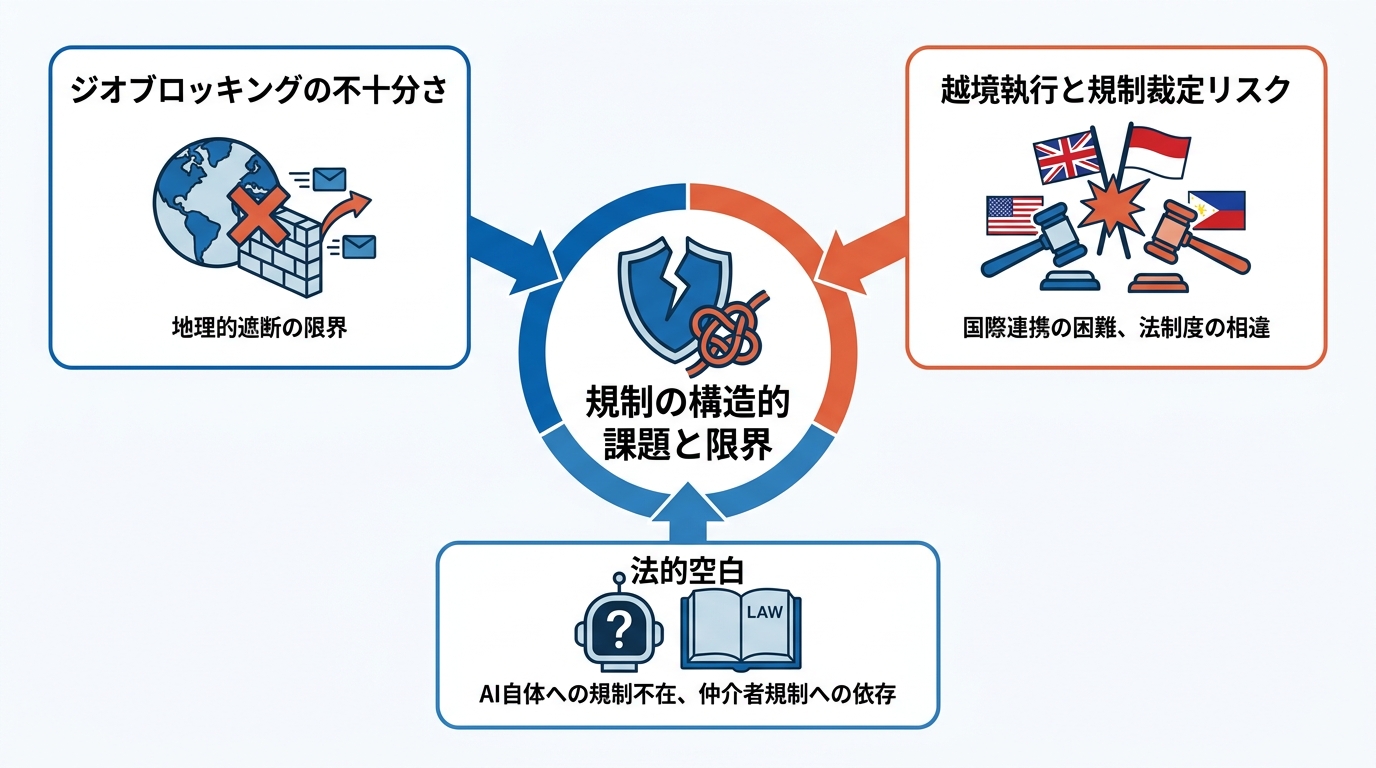

規制の構造的課題と限界

ジオブロッキングの不十分さ

ジオブロッキングは、Grok問題への即効的な対応策として一部の国が採用しましたが、この手法には限界があります。ジオブロッキングは、問題の発生場所がコンテンツの生成場所にあるという前提に立っていますが、少なくとも合成コンテンツ(収集ではなく生成されるコンテンツ)の場合、その前提は成り立ちません(参照*13)。

被害は画像が生成され拡散された時点で発生するものであり、生成を指示したユーザーの物理的な所在地とは無関係です。たとえば英国の人物を描いたディープフェイクが、別の国で生成されたとしても、数分以内に英国国内で流通しうるという事例が示されています。地理的な遮断では、こうした越境的な被害の発生を阻止できません。

越境執行と規制裁定リスク

Grok問題が世界的に波及したスピードは、規制の伝播がいかに速いかを示しています。2026年1月3日にReutersがGrokの問題を報じると、1月5日には英国のOfcomがxAIへの「緊急連絡」を表明し、1月10日にはインドネシアが一時遮断、1月15日にはフィリピンが全国的な遮断命令を出しました(参照*16)。

しかし、各国の規制当局間で実効的な連携が行われた形跡は限られていました。危機が展開するなか、各当局の執行戦略や監督上の情報共有はほとんど行われなかったとの報告があります。法的枠組みの違いや厳格な守秘義務が、こうした国際的な協力を困難にしています(参照*17)。

各国がDSAのシステムリスク規定、オンライン安全義務、プライバシー法、仲介者責任法、消費者保護法など、それぞれ異なる法的手段を用いている結果、Xのようなプラットフォームは並行しながら統一されていない調査に直面し、各管轄区域ごとに異なる影響評価や報告、技術的保護措置を求められています(参照*12)。

インドの事例に見る法的空白

インドの対応は、AI規制における法的空白を端的に示しています。インドの電子情報技術省(MeitY)は、Grokに対してAIシステムとしての専用の規制手続きや調査プロセスを開始していません。代わりに、IT法および関連規則のもとにある既存の仲介者責任の枠組みにほぼ全面的に依拠する形で対処しています(参照*18)。

つまり、Grokは要求に応じて違法・有害なコンテンツを生成できる生成AIモデルでありながら、AIシステムとして直接規制されていません。Xが負うSNS仲介者としての義務を通じて間接的に規制されているにすぎないのです。AIの機能そのものに対する規制が不在の場合、仲介者規制だけでは生成段階の問題に対処しきれないという構造的な課題が、インドの事例から浮かび上がっています。

今後の規制の方向性

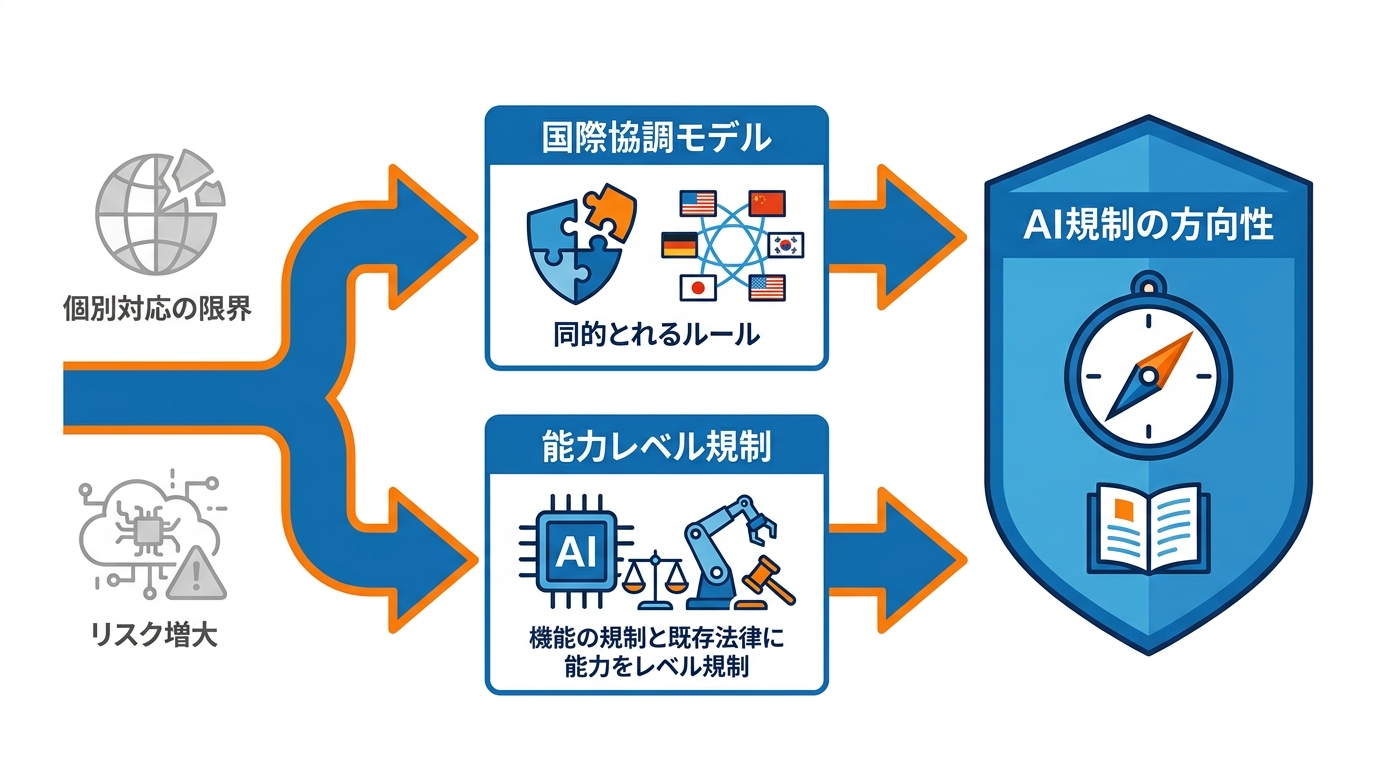

国際協調モデルの模索

Grok問題は、各国がそれぞれの法律で個別に対応する限界を示しました。全世界共通のオンライン安全に関する単一のルールブックを目指すのは現実的ではないものの、各国の規制当局が監督方針と企業への期待値をすり合わせることには大きな効果があるという提案がなされています。この考え方は、銀行規制における国際的な枠組みと同様のアプローチです。各規制当局がそれぞれのルールブックを整合的に運用すれば、企業にとっていずれかの規則を遵守するメリットが増し、不遵守のリスクも高まります(参照*17)。

生成AIの急速な進化とアクセスの容易化によって、なりすましコンテンツや非同意の性的画像など、説得力のある合成メディアを制作するためのコストや技術的ハードルが下がっています。Europolは、合成コンテンツが生成される速度と量を理由に、生成AIが詐欺や嫌がらせを含むオンライン犯罪の規模と効率を高める可能性が高いと評価しています(参照*12)。

能力レベル規制への移行

Grokの事例は、効果的なAI規制の多くが包括的なAI専用の法律からではなく、既存の被害に基づく法律を新しいAIの機能に適用することで生まれうる可能性を示しています。英国がAI専門の法整備を待たずにオンライン安全法を活用したアプローチは、その一例です。汎用AIの開発者にとって、Grokのディープフェイク生成機能が製品の欠陥として規制対象となるのであれば、ほかの機能にも同様の精査が及びうることを意味します(参照*13)。

技術的な対策だけでは十分ではないという指摘もあります。ヘイトスピーチのような問題を技術だけで「解決」することはできず、技術的な手段、方針策定、そして人間による実質的な介入と監視を組み合わせる必要があるとの見解が示されています(参照*19)。AIの生成能力が拡大し続けるなか、コンテンツの事後対応だけでなく、能力そのものを規制する枠組みへの移行が避けられない段階に入りつつあります。

おわりに

Grokをめぐる一連の問題は、AIの画像生成機能に対する規制が国ごとに分断されている現状と、その隙間を突いて被害が拡大する構造を浮き彫りにしました。プラットフォーム規制とAI規制の境界整理、コンテンツ規制から能力規制への転換、そして国際的な監督連携の構築が今後の焦点となります。

既存の法律をAIの新しい機能にどう適用するか、各国がどのように規制の足並みをそろえるかという問いは、Grokに限らずすべての生成AI開発者に関わるものです。技術の進化と規制の整備がどのように交差していくか、引き続き動向を確認していくことがポイントです。

監修者

安達裕哉(あだち ゆうや)

デロイト トーマツ コンサルティングにて品質マネジメント、人事などの分野でコンサルティングに従事しその後、監査法人トーマツの中小企業向けコンサルティング部門の立ち上げに参画。大阪支社長、東京支社長を歴任したのち2013年5月にwebマーケティング、コンテンツ制作を行う「ティネクト株式会社」を設立。ビジネスメディア「Books&Apps」を運営。

2023年7月に生成AIコンサルティング、およびAIメディア運営を行う「ワークワンダース株式会社」を設立。ICJ2号ファンドによる調達を実施(1.3億円)。

著書「頭のいい人が話す前に考えていること」 が、82万部(2025年3月時点)を売り上げる。

(“2023年・2024年上半期に日本で一番売れたビジネス書”(トーハン調べ/日販調べ))

参照

- (*1) Tech Policy Press – Tracking Regulator Responses to the Grok 'Undressing' Controversy

- (*2) StateScoop – Baltimore sues X, claiming Grok lacks 'meaningful guardrails' for explicit deepfakes

- (*3) CNBC – India, EU investigate Musk's X after Grok created deepfake child porn

- (*4) New York State Attorney General – Attorney General James Demands More Action from xAI to Stop Grok Chatbot from Producing Inappropriate Images to Protect Children and Adult Users

- (*5) Shaping Europe’s digital future – Commission investigates Grok and X's recommender systems under the Digital Services Act

- (*6) EU looking ‘very seriously’ at taking action against X over Grok

- (*7) Ireland opens investigation into X's Grok images

- (*8) ICO announces investigation into Grok

- (*9) IAPP.org – Pressure on Grok mounts after UK nonconsensual explicit deepfake ban

- (*10) CNBC – AI chatbot firms face stricter regulation to protect children in UK

- (*11) BetaKit – Grok’s non-consensual sexual images highlight gaps in Canada’s deepfake laws

- (*12) Bloomsbury Intelligence & Security Institute (BISI) – Deepfake Regulation Accelerates After Grok Controversy

- (*13) Just Security – Grok, Deepfakes, and the Collapse of the Content/Capability Distinction

- (*14) The Conversation – The furore over Grok’s sexualised images has begun an AI reckoning

- (*15) Harvard Gazette – How AI deepfakes have skirted revenge porn laws

- (*16) Flint Global – What Grok says about regulatory contagion in 2026

- (*17) Tech Policy Press – How a Small Swiss City Could Help Regulators Avoid the Next Grok Scandal

- (*18) Tech Policy Press – Analyzing Regulatory Gaps Revealed by India’s Response to the Grok Debacle

- (*19) Grok controversies raise questions about moderating, regulating AI content