はじめに

子どもや10代の若者のChatGPT利用が急速に広がる中、年齢制限のルールを正しく理解していないと、子どもが不適切なコンテンツに触れたり、個人情報を意図せず提供してしまったりするリスクがあります。私自身、生成AIコンサルティングの現場で企業や保護者から「子どもが使っているが、実際のところ何歳から使えるのか」という質問を受ける機会が増えています。

ChatGPTには「13歳未満は利用禁止」「18歳未満は保護者の同意が必要」という2段階の基本ルールが設けられており、さらに行動シグナルを使った年齢推定モデルや保護者向け管理機能が段階的に導入されています。ただし、ルールが整備されれば問題が解決するほど単純な話ではありません。本記事では、年齢制限の具体的な内容から各国の規制動向、保護者が押さえるべき注意点までを順に解説します。

ChatGPTの年齢制限の基本ルール

13歳未満は利用禁止という原則

ChatGPTの年齢制限でもっとも基本となるのは、13歳未満の利用が禁止されている点です。OpenAIの利用規約には「サービスを利用するには13歳以上、または自国で利用に同意できる最低年齢に達している必要がある」と明記されています(参照*1)。

この13歳という基準は、ChatGPTのすべての機能に適用されます。たとえば季節限定のイベント機能であっても例外はなく、同じ年齢制限のもとで提供されます。ChatGPTのアカウントを作成する時点で13歳以上であることが前提条件となるため、12歳以下の子どもが自分名義のアカウントを持つことは規約上認められていません。

ただし、こうした年齢制限は自己申告に頼る部分が大きいのが実情です。テック業界で広く使われている年齢確認や保護者同意の仕組みは、基本的に「自己申告制」であり、子どもが容易に回避できるという指摘があります(参照*2)。技術的な制限は入り口を設けるだけであり、それだけで子どもを守れると考えるのは、少し楽観的すぎます。

13〜17歳に求められる保護者同意

13歳以上であっても、18歳未満のユーザーにはもうひとつのハードルがあります。OpenAIの利用規約では「18歳未満の場合、サービスを利用するには保護者または法定後見人の許可を得なければならない」と定めています(参照*3)。

つまり、ChatGPTの年齢制限は「13歳」と「18歳」の2段階で設計されています。13歳になればアカウントの作成自体は可能になりますが、18歳になるまでは保護者の同意が求められます。この仕組みにより、10代のユーザーが完全に自己判断だけで利用することは規約上想定されていません。

しかし先述のとおり、保護者同意の確認プロセスも自己申告ベースで運用されている部分があります。子どもが保護者の許可を得たと自己申告するだけでアカウントを作れてしまう余地があるため、実効性をどう高めるかが継続的な課題となっています。ルールと実態のギャップを埋めるには、技術的な仕組みだけでなく、家庭内での対話が不可欠だと私は考えています。

国・地域による最低年齢の違い

ChatGPTの年齢制限は一律13歳と思われがちですが、利用規約には「自国で利用に同意できる最低年齢」という条件も併記されています(参照*1)。そのため、国や地域の法律によっては13歳よりも高い年齢が最低ラインとなる場合があります。

たとえばデンマークは15歳未満に対するソーシャルメディアの禁止を計画しており、ドイツやフランスはアカウント開設に必要な保護者同意の年齢を引き上げています。オランダや韓国では教室内での携帯電話の使用を制限するなど、国ごとにアプローチが異なります(参照*4)。こうした各国の規制環境がChatGPTの実質的な利用開始年齢にも影響を与えるため、自分の居住地域のルールを確認することが欠かせません。

AI年齢推定モデルの仕組みと課題

行動シグナルによる年齢推定の方法

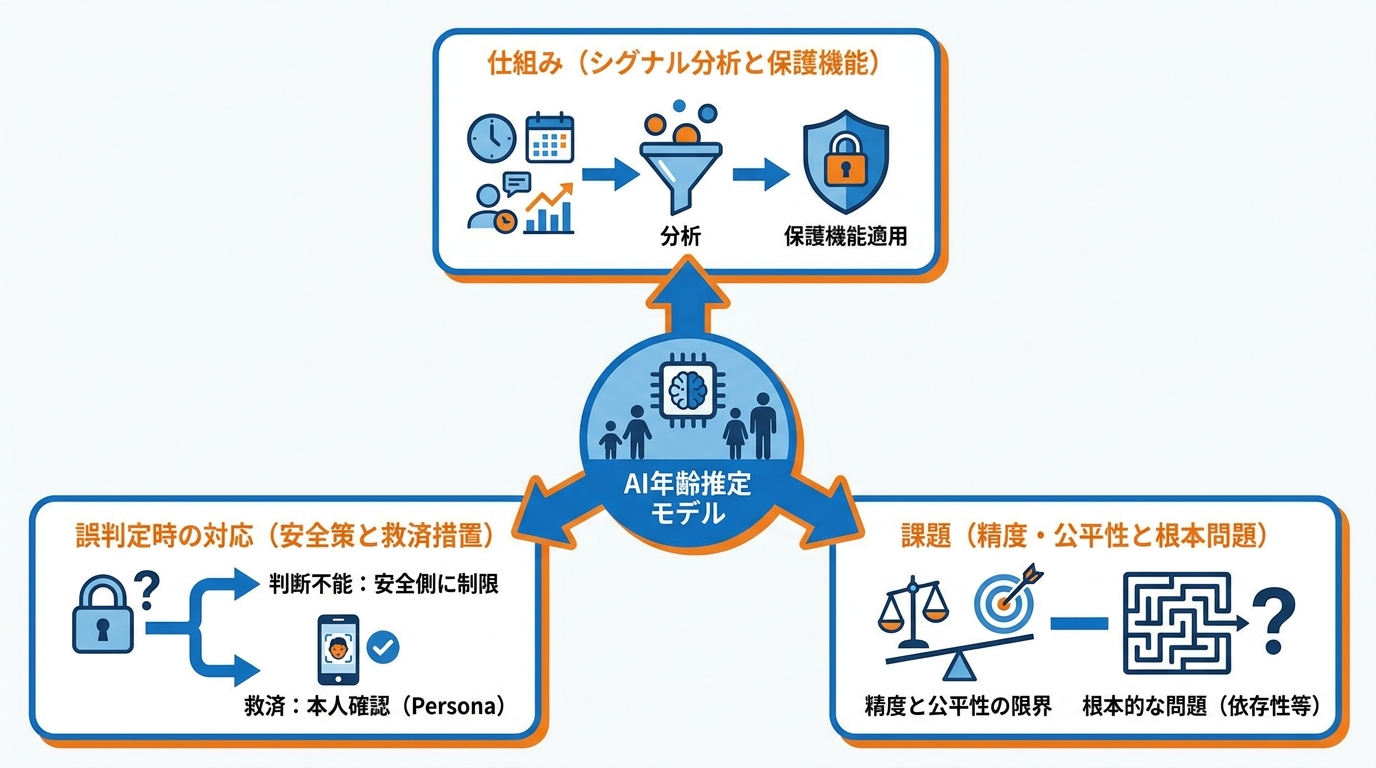

OpenAIは、登録時に入力された生年月日だけに頼らない年齢推定の仕組みをChatGPTに導入しています。この年齢推定モデルは、アカウントレベルのシグナルと行動シグナルの組み合わせで動作します。具体的には、アカウントの存在期間、ユーザーがアクティブになる時間帯、利用パターンの経時変化、そしてユーザーが申告した年齢などが分析対象となります(参照*5)。

OpenAI自身も「年齢推定を実際に運用することで、どのシグナルが精度向上に寄与するかを学習し、その知見をもとにモデルを継続的に改善する」と説明しています(参照*6)。この年齢推定モデルがユーザーを18歳未満と判定した場合、ChatGPTは自傷行為の描写などの「センシティブなコンテンツ」への接触を減らすための保護機能を自動的に適用します。アプローチ自体は合理的ですが、行動シグナルによる推定は本質的に確率論であり、精度には限界があることを前提に見ておく必要があります。

誤判定への対処と本人確認手段

行動シグナルによる年齢推定には誤判定のリスクが伴います。OpenAIはこの点について、ユーザーの年齢を判定できない場合には、より制限の厳しい設定を適用する方針をとっています(参照*6)。つまり、判断がつかないケースでは安全側に倒す設計です。

一方、成人であるにもかかわらず18歳未満と誤判定された場合の救済策も用意されています。その場合、ユーザーは外部の本人確認サービス「Persona」を通じた自撮り写真による年齢確認を行うことで、完全なアクセスを復元できます。米国の国立標準技術研究所が2024年5月に公表した報告書では、年齢推定の精度が画像の品質や人口統計的属性、法定年齢の閾値との近さによって変動すると指摘されており、技術的な限界も明らかになっています(参照*6)。

専門家が指摘する精度と公平性の問題

OpenAIの年齢推定アプローチに対しては、外部の専門家からも懸念が寄せられています。民主主義・技術センターの上級政策アナリストであるAliya Bhatia氏は、「このツールの予測精度と、避けられない誤分類にOpenAIがどう対処するのかについて、難しい問いが生じる」と述べています。同氏はさらに「こうしたシグナルからユーザーの年齢を推定するのは多くの理由から非常に難しい。たとえば10代の若者は新しい技術のアーリーアダプターであることが多く、OpenAIの消費者向けサービスのもっとも初期のアカウントには10代が偏って多く含まれている可能性がある」と指摘しています(参照*6)。

また、年齢確認の仕組み全般に対しても根本的な問題提起があります。年齢確認は「複雑な社会問題を技術で素早く解決できるという信念」であり、依存性を高めるデザインやハラスメントを助長する環境といったプラットフォーム設計の深層的な問題には手を付けていないとする見方もあります(参照*7)。最低年齢の壁を越えた若者が、同様に有害で依存性の高い空間にそのまま放り込まれるリスクは依然として残ります。生成AI導入支援の現場でも同じ構図を見ます。ルールを整備することと、実際のリスクを管理することは別の話です。

未成年向けコンテンツ制限と保護者機能

性的・自傷関連コンテンツの制限内容

ChatGPTでは、未成年ユーザーに対するコンテンツ制限が段階的に強化されています。新しいポリシーのもとでは、18歳未満のユーザーに対して恋愛的・性的なやり取りをしないようにChatGPTが訓練されています。加えて、自殺に関する会話にも追加のガードレールが設けられています(参照*8)。

とくに深刻なケースへの対応も定められています。未成年のユーザーがChatGPTを使って自殺に関するシナリオを想像した場合、サービスはその保護者への連絡を試みます。状況がとりわけ重大と判断された場合には、地元の警察に連絡することもあるとされています。こうした仕組みは、単にコンテンツを非表示にするだけでなく、実際の危機に対する介入の手段としても位置づけられています。

保護者コントロールの主な機能

OpenAIは、保護者が10代の子どものChatGPT利用を管理するための機能も導入しています。保護者は自分のアカウントと子どものアカウントを連携させることができ、これにより子どもが深刻な状態にあるとシステムが判断した場合に保護者へ通知が届く仕組みが働きます(参照*2)。

コンテンツ面の制限に加えて、利用時間の管理機能も提供されています。保護者は「利用停止時間帯」を設定でき、指定した時間帯にはChatGPTが利用できなくなります。この機能は以前には存在しなかったもので、夜間の利用を制限したい場合などに活用できます。未成年であることをシステムに確実に認識させるもっとも信頼性の高い方法は、10代のアカウントを既存の保護者アカウントに連携させることだとされています(参照*8)。

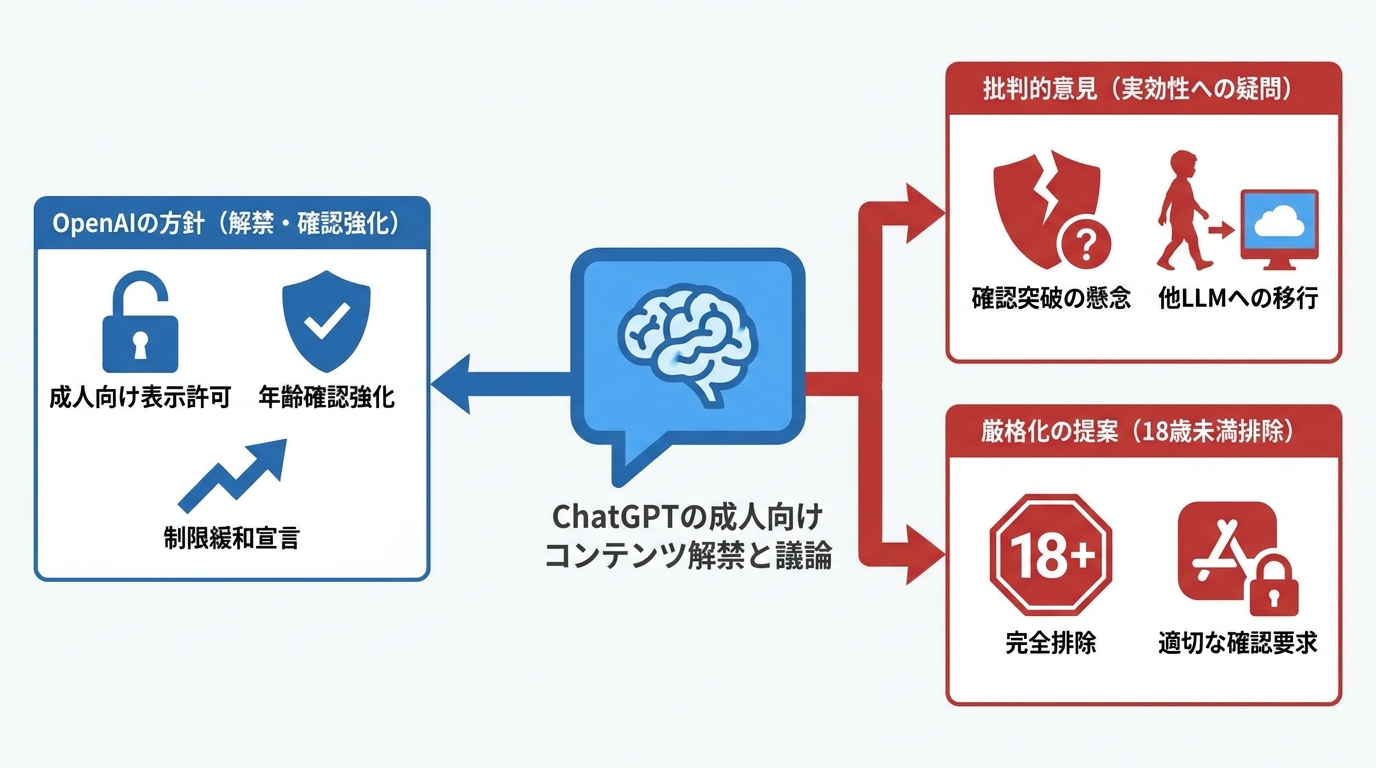

成人向けコンテンツ解禁と年齢確認強化

ChatGPTの年齢制限をめぐる議論が一段と注目を集めたのは、成人向けコンテンツの解禁が発表されたタイミングです。OpenAIのSam Altman CEOは、2025年12月からChatGPT上で認証済みの成人に対して「エロティカ」の表示を許可すると発表し、同時に年齢確認の仕組みをより本格的に展開する方針を示しました(参照*3)。同CEOは2025年10月14日に、「深刻なメンタルヘルスの問題を軽減でき、新しいツールも整った」として、多くのケースで制限を安全に緩和できるようになったと宣言しています(参照*9)。成人向け機能の解禁と未成年保護の強化を同時に進めるという方向性は理解できますが、「年齢確認の精度が上がれば問題は解決する」という前提には慎重でいるべきだと思います。

この動きには批判も寄せられています。投資家のMark Cuban氏は「これは裏目に出る。どの保護者も、自分の子どもが年齢確認を突破できないとは信じない。保護者は子どもを他のすべてのLLMに移すだけだ」と述べ、OpenAIの年齢確認では子どもを成人向けコンテンツから十分に守れないと批判しました。さらに別の立場からは、18歳未満がチャットボットにアクセスできないよう、アプリストアでの12歳以上指定にとどめるのではなく適切な年齢確認を設け、18歳未満を完全に排除すべきだという意見も出ています(参照*10)。

各国・各州の法規制と訴訟動向

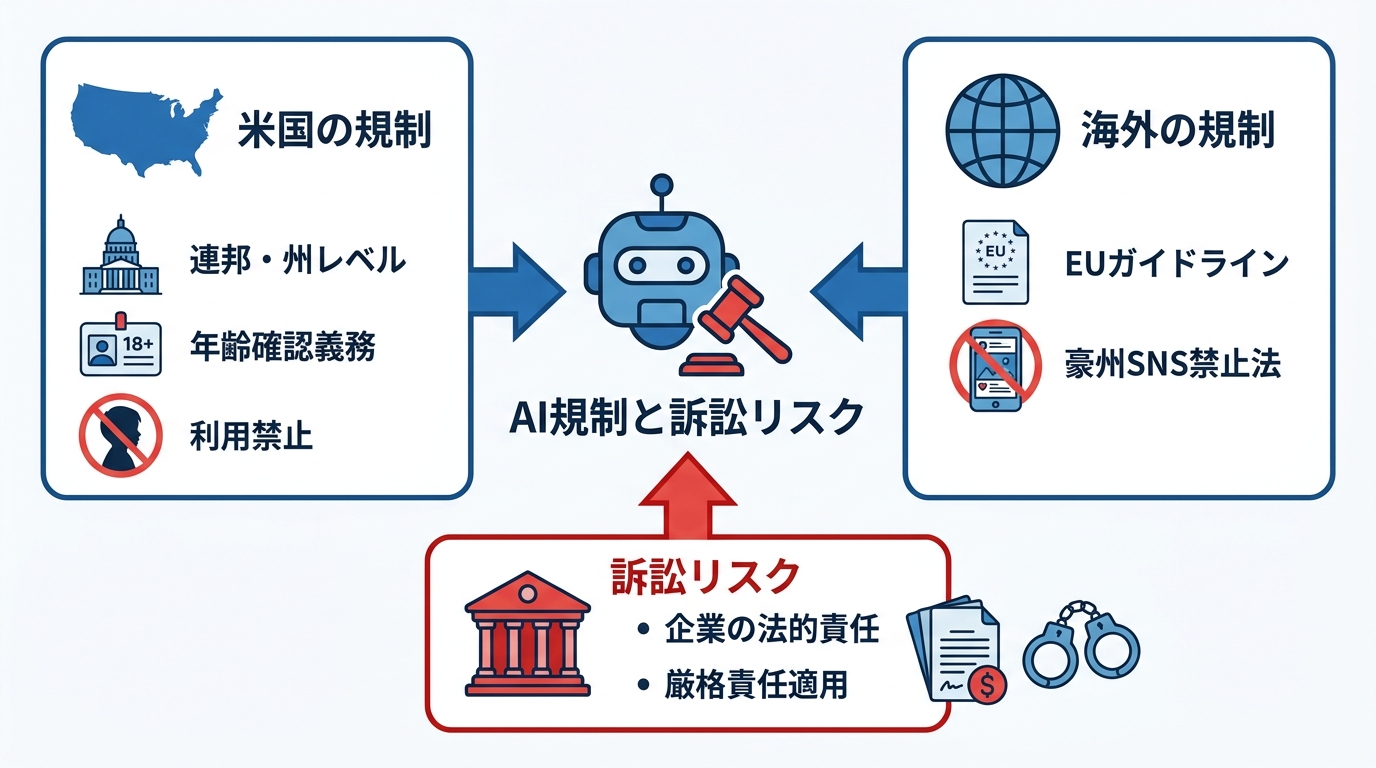

米国の連邦・州レベルの規制法案

米国では連邦・州の両レベルでAIチャットボットの年齢制限に関する法整備が進んでいます。連邦レベルでは、上院議員のJosh Hawley氏とRichard Blumenthal氏が超党派の法案を提出し、AIチャットボット提供者にユーザーの年齢確認を義務付けるとともに、未成年と判明した場合にはAIコンパニオンの利用を禁止する内容を盛り込みました。Hawley議員は「アメリカの子どもの70%以上がすでにこうしたAI製品を使っている。新たな被害を防ぐ明確なルールを制定することは、議会の道義的責任だ」と述べています(参照*11)。

州レベルでは、カリフォルニア州知事が複数の法案に署名しています。その内容は、「コンパニオンチャットボット」プラットフォームに対し、ユーザーの自殺願望や自傷行為を特定・対処するプロトコルの策定を義務付けるものです。プラットフォームはやり取りがAIによって生成されたものであることを開示しなければならず、未成年には休憩の案内表示が必要で、チャットボットが生成した性的に露骨な画像の閲覧も禁止されます。さらに、OSやアプリストアの提供者に対しても年齢確認を義務付ける規定が設けられています(参照*12)。

EU・豪州など海外の規制アプローチ

米国以外の国や地域でも、未成年のオンライン保護に向けた規制が広がっています。欧州委員会は未成年保護に関するガイドラインを公表し、年齢確認の手法について「正確で、信頼性が高く、堅牢で、プライバシーを侵害せず、差別的でない」ことを推奨しています。とくにポルノやギャンブルなどの成人向けコンテンツへのアクセス制限や、国内法で特定のオンラインサービスに最低年齢を設けている場合には年齢確認の導入を求めています(参照*13)。

オーストラリアは、16歳未満の子どもに対するソーシャルメディアの利用を禁止する法律を世界で初めて制定しました。この法律は10代のメンタルヘルスへの懸念の高まりを背景に2024年に成立し、施行が進んでいます。この動きを受けて、他の国々でも同様の法案の導入や検討が始まっています(参照*4)。こうした各国のアプローチは、ChatGPTのようなAIサービスに対する年齢制限の枠組みにも影響を及ぼしていく可能性があります。

訴訟リスクと企業の法的責任

法規制の強化に伴い、AIチャットボット提供者が直面する訴訟リスクも具体化しています。ニューヨーク州の法案S 5668は、カリフォルニア州の法律よりも広い範囲をカバーし、すべてのチャットボットに対する包括的な責任の枠組みを設けています。未成年に対しては年齢確認や保護者同意の義務を課し、安全対策が守られなかった結果として未成年が自傷行為に至った場合には厳格責任を適用する内容です(参照*9)。

フロリダ州でも同様の法制化が進んでいます。フロリダ州の法案では、コンパニオンチャットボットプラットフォームは、保護者の同意がない限り未成年がアカウント保有者としての契約を結ぶこと、および既存アカウントの維持を禁じなければなりません。同意が得られた場合は、保護者に対して未成年のアカウントに対する管理権限を付与する必要があります。この規定に故意または重過失で違反した場合、プラットフォームは未成年のアカウント保有者に対して最大1万ドルの損害賠償責任を負うほか、裁判費用と弁護士費用も負担します(参照*14)。

保護者・教育者が押さえるべき注意点

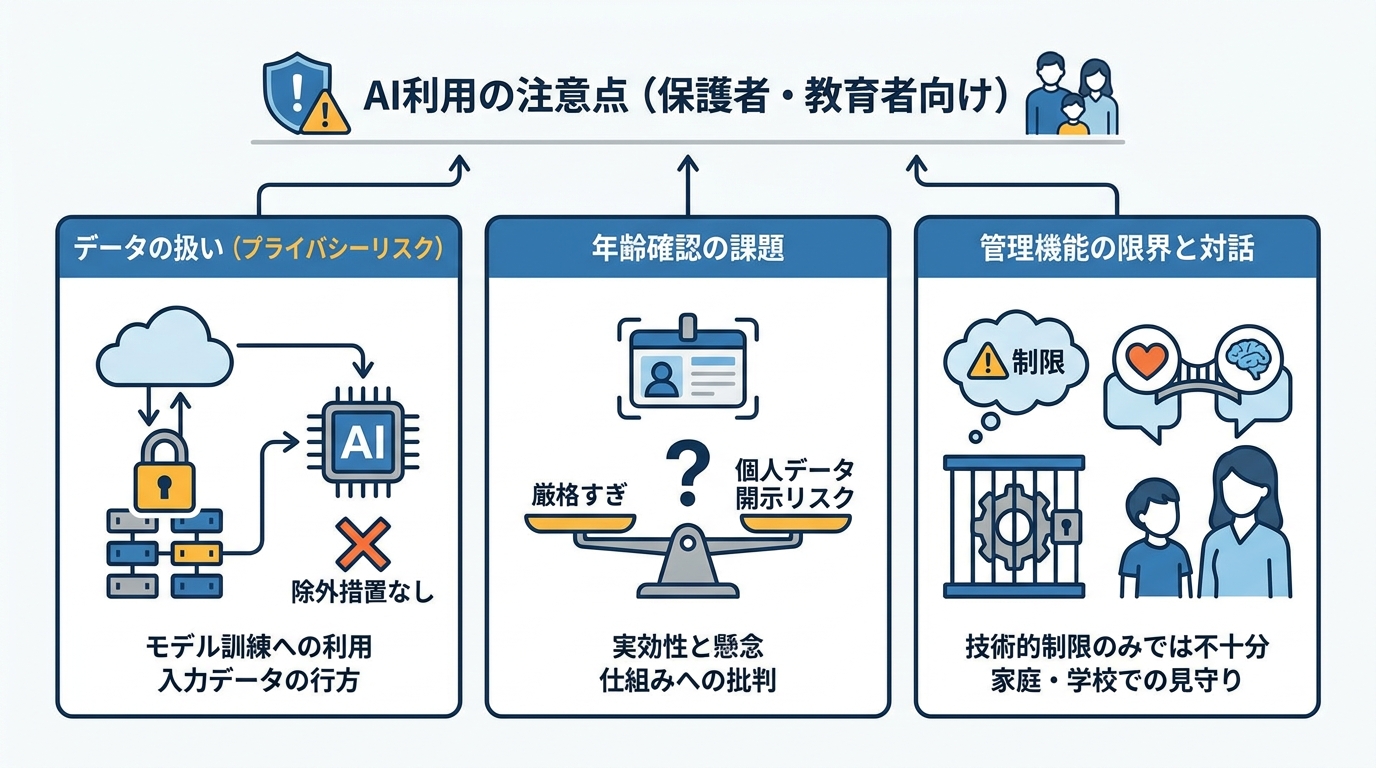

年齢制限や保護者向け管理機能が整備されつつあるとはいえ、保護者と教育者が把握しておくべき注意点はいくつかあります。まずデータの扱いについて、開発者ごとにプライバシー慣行は異なりますが、多くの事業者は子どもの入力データをデータ収集やモデル訓練の対象から除外する措置をとっていないとの調査結果があります(参照*15)。ある企業は10代のユーザーがオプトインすればそのデータでモデルを訓練すると発表しており、別の企業は18歳未満のアカウント作成を認めないとしつつも年齢確認を義務付けていません。子どもがチャットボットに入力した情報がどう使われるかを、保護者自身が利用規約で確認しておくことが大切です。これは面倒に感じるかもしれませんが、生成AIを業務利用する企業が利用規約を読まずにデータを入力するリスクと、本質的に同じ問題です。

年齢確認の仕組みそのものにも懸念があります。要件が厳しすぎると一部の企業がサービス提供を中止する恐れがあることに加え、若者がより多くの個人データを開示するリスクにつながるとの批判も出ています(参照*16)。また、保護者向け管理機能はあくまで「最低限の対策」にすぎないという指摘は正しいと思います。技術的な制限は入り口を設けるものであって、子どもがAIとどう向き合うかを決めるものではありません。家庭や学校での対話を通じて、何のためにAIを使うのか、どんな情報を入力してはいけないのか、AIの回答をどう受け取るべきかを伝えることが、結局のところもっとも実効性のある対策です。

おわりに

ChatGPTの年齢制限は「13歳未満の利用禁止」と「18歳未満への保護者同意」を基本とし、AI年齢推定モデルや保護者向け管理機能、そして成人向けコンテンツに対する年齢確認強化が段階的に加わる構造になっています。米国や欧州、オーストラリアなど各国の法規制もAIチャットボットに対する年齢制限の要件を厳格化する方向で動いており、今後さらに変化が加わることは確実です。

ただし、繰り返しになりますが、ルールや技術的な仕組みだけで子どもを守れるわけではありません。自己申告ベースの年齢確認には限界があり、年齢推定モデルにも誤判定が生じます。保護者や教育者はルールの更新を定期的に確認しながら、技術的な制限と家庭内での対話の両方を組み合わせて子どものAI利用を支えていく姿勢が求められます。AIは便利なツールである一方、使い方を誰かが教えなければ、子どもは自分で判断するしかなくなります。その責任は、プラットフォームだけでなく、保護者と社会が引き受けるべきものです。

監修者

安達裕哉(あだち ゆうや)

デロイト トーマツ コンサルティングにて品質マネジメント、人事などの分野でコンサルティングに従事しその後、監査法人トーマツの中小企業向けコンサルティング部門の立ち上げに参画。大阪支社長、東京支社長を歴任したのち2013年5月にwebマーケティング、コンテンツ制作を行う「ティネクト株式会社」を設立。ビジネスメディア「Books&Apps」を運営。

2023年7月に生成AIコンサルティング、およびAIメディア運営を行う「ワークワンダース株式会社」を設立。ICJ2号ファンドによる調達を実施(1.3億円)。

著書「頭のいい人が話す前に考えていること」 が、82万部(2025年3月時点)を売り上げる。

(“2023年・2024年上半期に日本で一番売れたビジネス書”(トーハン調べ/日販調べ))

参照

- (*1) Mashable – Why is ChatGPT's Santa Mode only for ages 13 and up?

- (*2) Education Week – ChatGPT Will Soon Have Parental Controls. How Schools Can Help Parents Use Them

- (*3) Business Insider – Mark Cuban: ChatGPT's New Age Restrictions for Erotica Could Go Wrong

- (*4) Brookings – How will bans on social media affect children?

- (*5) CNBC – OpenAI is rolling out age prediction for ChatGPT consumer plans

- (*6) Decrypt – OpenAI Deploys Age Prediction to Restrict Teen Access on ChatGPT

- (*7) European Digital Rights (EDRi) – Age verification gains traction: the EU risks failing to address the root causes of online harm

- (*8) TechCrunch – OpenAI will apply new restrictions to ChatGPT users under 18

- (*9) Public Knowledge – Kids & Teens Safety Regulations for AI Chatbots Could Backfire

- (*10) IAPP.org – Age, content restrictions could be coming next for AI chatbots

- (*11) Marketbrief – New Regulations Proposed for AI Chatbot Providers

- (*12) Governor of California – Governor Newsom signs bills to further strengthen California’s leadership in protecting children online

- (*13) Shaping Europe’s digital future – Commission publishes guidelines on the protection of minors

- (*14) https://www.flsenate.gov/Session/Bill/2026/482/Analyses/2026s00482.cm.PDF

- (*15) Be Careful What You Tell Your AI Chatbot

- (*16) WPR – Wisconsin lawmakers explore age verification requirements on companionship chatbots