はじめに:なぜ今、ChatGPT APIなのか

近年、人工知能技術の進化により、企業や組織でチャット型AIの導入が急速に進んでいます。特にOpenAIが提供するChatGPTのAPIは、独自システムや業務アプリケーションへの組み込みに適した高い柔軟性と拡張性を持つ点が注目されています。

Web版のChatGPTは、単体で完結した便利なツールですが、APIとして組み込むことで大規模な自動化や既存業務との連携が容易になります。本記事では、ChatGPT APIの基礎知識から料金体系、実装方法、セキュリティまでを体系的に解説し、企業のDX推進や業務効率化に役立つ実践的なポイントを紹介します。

ChatGPT APIの基礎知識とWeb版ChatGPTとの違い

ChatGPT APIの概要

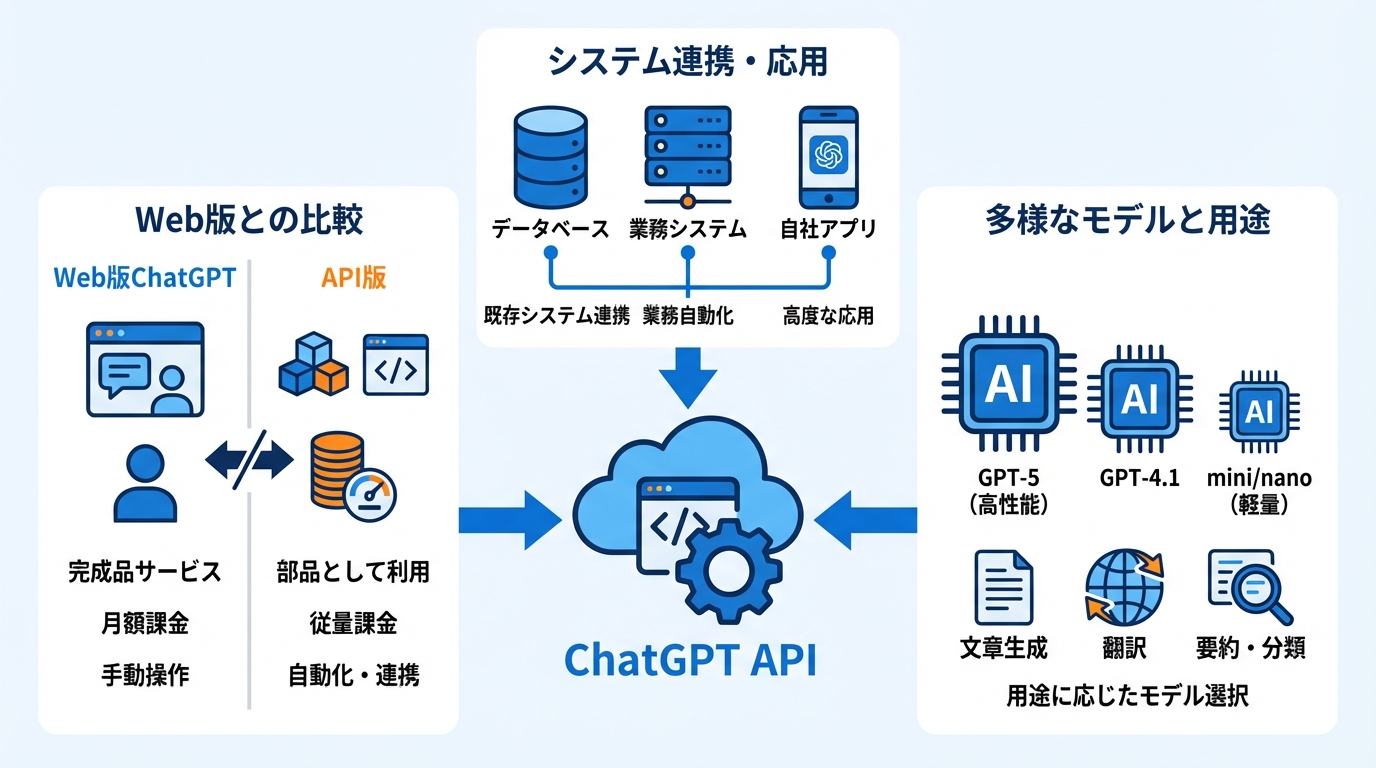

ChatGPT APIは、OpenAIが公式に提供する開発者向けインターフェースであり、Web版ChatGPTと同じAI技術をプログラムやアプリケーションから直接呼び出せる点が特徴です(参照*1)。GPT-4oやGPT-5などの大規模言語モデルを組み込み、文章生成・要約・翻訳・分類など多様なタスクを実行できます。Web版ChatGPTが「完成したサービス」であるのに対し、APIは部品としての利用が想定されており、自社のチャットボットや業務システムへの連携など高度な応用が可能です(参照*2)。

2025年現在、OpenAIの標準呼び出し方式としてResponses APIが一般的となり、テキスト・画像・音声などを統一的に扱えるメリットがあります(参照*3)。また、企業利用では送信データを学習データに再利用しない運用方針を採用しており、プライバシーやセキュリティの観点からも選択しやすいという評価があります(参照*2)。APIの形態を取ることで、必要な機能だけを抽出・活用できるため、Web版よりも応用範囲が広く、業務の省力化やサービスの付加価値向上に貢献します。

Web版ChatGPTとの機能・料金の違い

Web版ChatGPTは、ユーザーがブラウザ上で手軽にアクセスし、対話形式で文章生成を行うための使いやすいツールです。一方、API版は企業や開発者が自社プロダクトから直接AIモデルを呼び出せる仕組みで、従量課金方式が適用されます(参照*3)。Web版ChatGPTは月額サブスクリプションプランが用意されている場合もありますが、ChatGPT APIは処理したトークン数に応じて料金が発生するため、利用方法によって費用体系が大きく異なります(参照*1)。

また、Web版ChatGPTは画面上の操作が中心で、大規模な連続処理や自動化には不向きです。APIを通じて呼び出すことで、既存システムとの連携や自動化が可能となり、大量データ処理やカスタマイズされた対話フローなど、専門的な用途にも柔軟に対応できます。料金面でも、自然言語処理を頻繁に行う現場では従量制による細かなコスト管理が重要となるため、利用規模や目的に応じて最適なモデルを選択する設計がポイントです。トークン使用量の監視を徹底することで、コストを抑えつつ高度なAI機能を活用できます。

APIで利用できる主なモデルと用途

ChatGPT APIでは、GPT-5やGPT-4.1をはじめ、mini・nanoといった性能とコストのバランスが異なるバリアントが多数提供されています。用途に応じてモデルを使い分けるのが一般的で、大量のドキュメント分析には大規模モデルを、素早い応答が求められる小規模入力には軽量モデルを選択することが推奨されます(参照*4)。最適なモデルを導入することで、性能とコストのバランスを調整できます。

テキスト生成だけでなく、翻訳・要約・分類など多彩な機能に対応しているのも特長です。2025年時点ではResponses APIに統合されており、画像・音声・コード生成の呼び出しも一元的なインターフェースで利用可能です(参照*3)。データ分析や業務の合理化など、組織規模を問わず幅広い活用が期待できます。

ChatGPT APIが選ばれる主な理由

自動化・大量処理のメリット

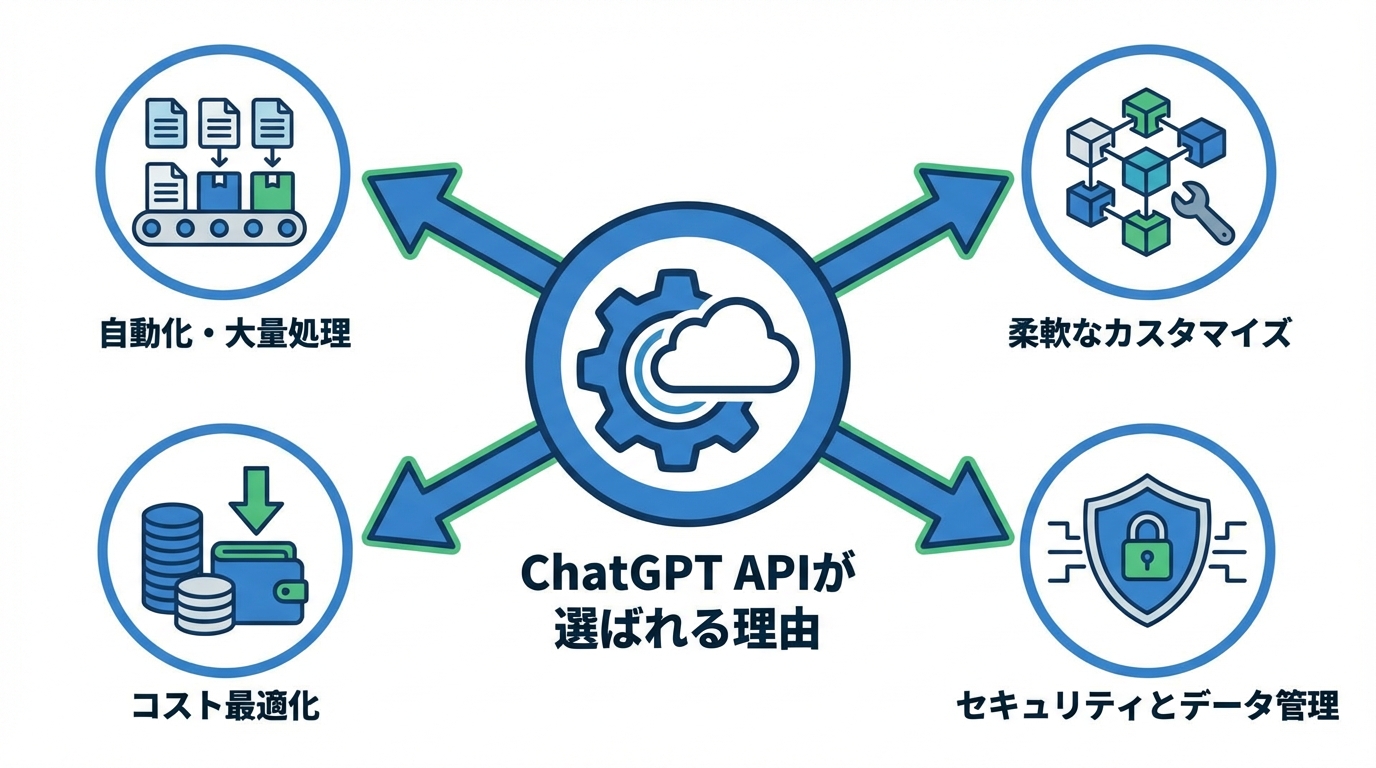

ChatGPT APIが選ばれる大きな理由の一つは、大量のタスクを自動処理できる点です(参照*5)。Web版ChatGPTは一人のユーザーがブラウザを介して対話する形式で、同時並行処理には向きません。APIを活用すれば、既存ワークフローに組み込んで定型業務やデータ分析、翻訳、多言語サポートなどを一括実行できます。たとえば、数十万件規模の問い合わせ対応でも、ChatGPT APIを活用することで要約や返信テンプレート作成の自動化が実現し、人的リソースの削減や24時間対応が可能になります。

APIによる大規模処理は従量課金制とも相性が良く、Web版のような時間や利用上限の制約がありません。必要な分だけコストが発生し、利用を停止すれば支払いも止まる仕組みです。事業規模や利用方法に応じてリソースを調整し、段階的なスケールアップ・ダウンも容易です。これらの特性が、ChatGPT APIによる大容量処理の大きなメリットです。

柔軟なカスタマイズと拡張性

Web版ChatGPTはユーザーが対話する場面には便利ですが、企業運用では自社流の機能やインターフェースに変更したいケースが多くあります。ChatGPT APIはプログラミングレベルで自由度の高いカスタマイズが可能で、独自UIや業務特化の会話フロー構築にも適しています。たとえばカスタマーサポートで特定の回答データベースと連携したり、社員用ポータルサイトに会話機能を埋め込むなど、さまざまなシナリオに対応できます(参照*6)。

多言語化も柔軟に行え、API呼び出し時に翻訳機能と組み合わせることで多様な言語に自動対応できます。大量データを扱いながら細かな会話制御ができるため、業務プロセスに合わせたフロー設計も可能です。APIは初心者には学習コストがかかりますが、最終的には企業の固有事情に合わせた統合的なアプリケーション開発を支える強力なツールとなります。

コスト最適化と料金設計

ChatGPT APIの料金はトークンベースの従量課金制で、適切に運用すればコストを抑えつつ高品質な応答が得られます(参照*1)。たとえば日本語を英語に翻訳してからAPIに入力することでトークン消費を抑えたり、短いやり取りを心がけることでコスト削減が可能です(参照*6)。数百万トークンを超える大量利用でも、モデル選択やプロンプト設計を工夫することでコストと性能のバランスを最適化できます。

利用中はコストをリアルタイムで監視し、一定金額を超えないよう設定する企業も増えています。これにより予期せぬ高額請求を防ぎ、必要な時に必要なだけモデルを呼び出す柔軟な設計が可能です。初期段階では無料クレジットを活用して試験運用し、プロンプトやモデル選択の方法を確立してから本格導入する流れが一般的です。

セキュリティとデータ取り扱い

ChatGPT APIの利用では、やり取りされるデータの安全管理が重要です。OpenAIは送信データを学習に使用しない方針を定め、データは30日間程度の一時保持後に削除される仕組みです(参照*7)。企業利用では社内システムとの連携時にアクセス権限を細かく設定し、外部からの不正アクセスを防ぐ必要があります。

APIキー漏洩や不正利用による予期せぬ課金リスクも深刻なため、サービスアカウント単位でAPIキーを分割管理したり、エフェメラルトークン(短命トークン)を活用するなど、セキュリティを高める運用が推奨されます。API運用ではユーザー側でセキュリティ設計を完結できる部分が大きいのも利点です。

ChatGPT APIの料金体系とトークン設計

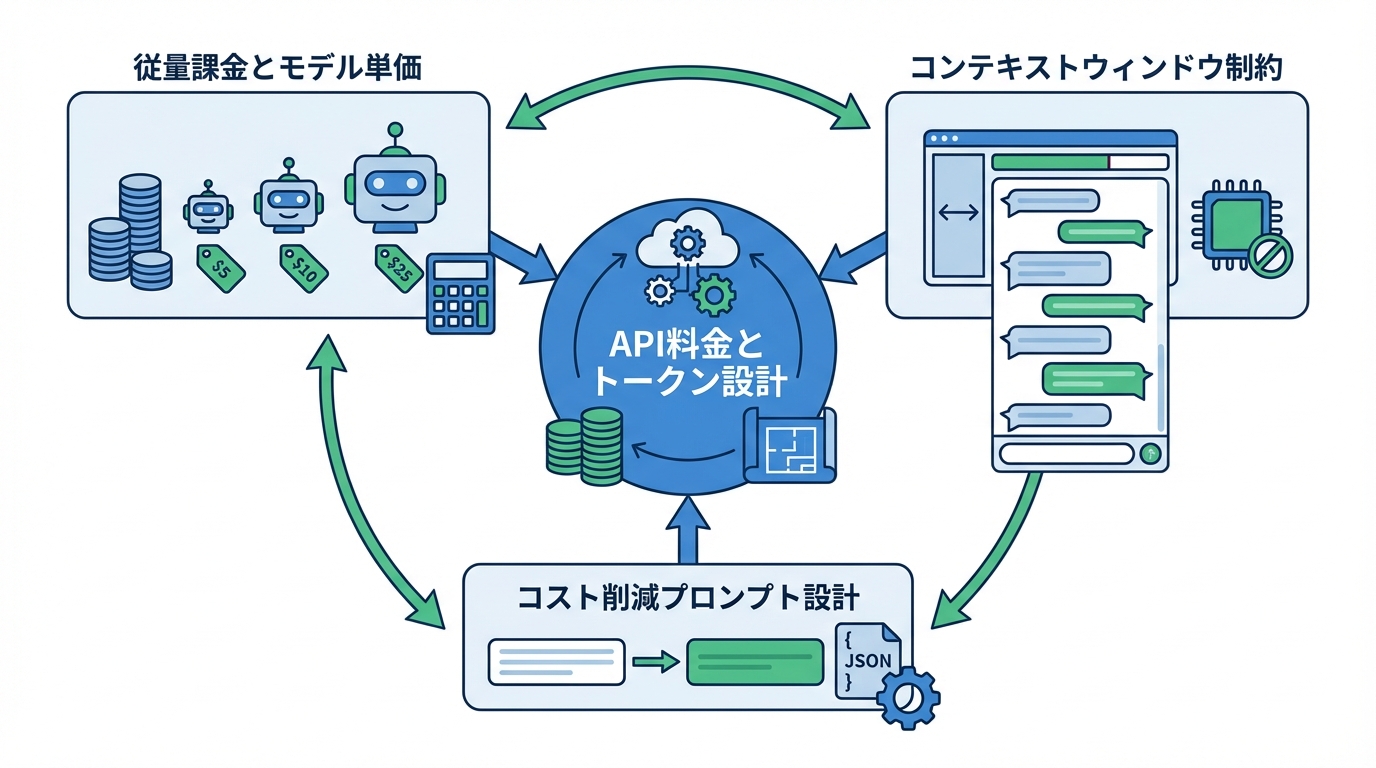

従量課金とモデル別単価

ChatGPT APIの料金は、利用したトークン数に応じて発生する従量課金制です(参照*1)。入力トークンと出力トークンの合計にモデル固有の単価が掛け合わされて費用が決まります(参照*6)。GPT-4oやGPT-5などの高性能モデルは単価が高めに設定されているため、大量リクエスト時には必要性能とのバランスを検討することが重要です。

OpenAIは時期によって無料トライアル枠やクレジット付与のキャンペーンを実施することがあり、これを活用して事前に性能やコスト感を試すことが推奨されます。モデルは日々進化しているため、柔軟な料金設計を意識しておくと長期運用で有利です。

トークンとコンテキストウィンドウの制約

ChatGPT APIは会話コンテキストを維持する仕組みを持ち、やり取りが続くほど過去の発話を含めたトークン数が増加します。モデルごとにコンテキストウィンドウの最大トークン数が異なり、GPT-5では最大40万トークン、GPT-4.1では100万トークンまで拡張可能です(参照*8)。ただし、システム側のオーバーヘッドもあるため、理論値より少ないトークン数を前提に設計することが望まれます。

コンテキストウィンドウが大きいモデルは長期的な対話履歴や大規模テキストの一括処理に向いていますが、コストも増加しがちです。長文のやり取りでは不要な履歴を省いたり、コンテキストを細分化することでコストと精度のバランスを調整できます。チャットボット運用では、回答精度とコストを意識したウィンドウサイズ設計が重要です。

コストを抑えるプロンプト設計

従量課金制では、入力・出力の長さがトークン消費を左右します。プロンプト設計を工夫することでコスト削減が可能です(参照*6)。冗長な指示を避け、出力形式を簡潔に指定することでトークン消費を抑えられます。英語を利用する場合は文字数単価が下がる傾向があり、大量データ処理時には一部の日本語を英文化したプロンプトを利用する企業もあります(参照*4)。

また、出力をJSONのような構造化形式で返すよう指示すると、応答内容が整理されて文字数増加を防げる場合もあります。出力トークンに上限を設定する方法も効果的です。API管理画面で利用上限を設定しておけば、万一プロンプト不備で高額請求が発生するリスクを抑えられます。これらの点を意識してプロンプトを設計することで、業務におけるAI活用をより低コストで実現できます。

ChatGPT API利用開始前の準備

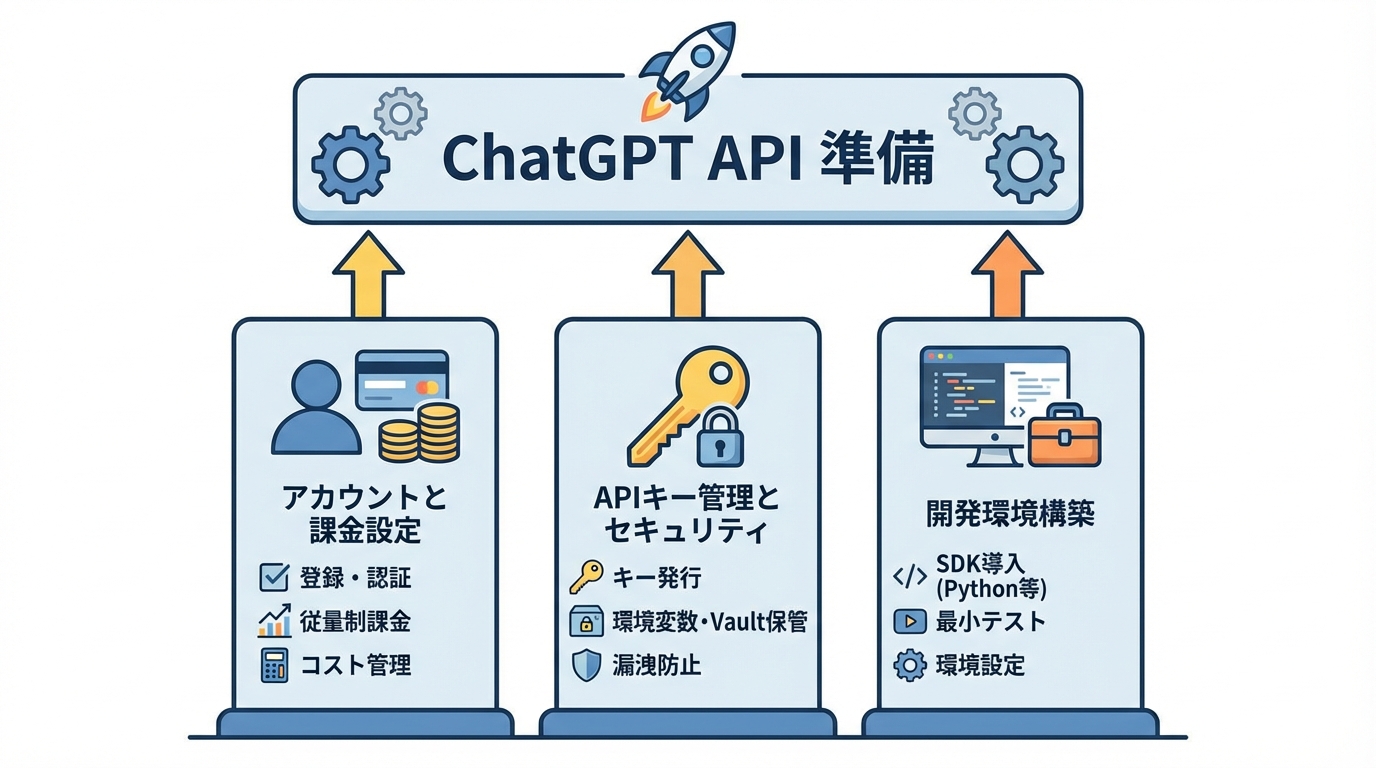

アカウント作成と課金設定

ChatGPT APIを利用するには、OpenAIのアカウント登録と課金設定が必要です。https://auth.openai.com/log-in から認証を行い、クレジットカード登録やクレジット購入を行います(参照*9)。DALL·Eなど他サービスと共通の課金枠を利用する場合もあり、一度設定すれば追加手続きなく運用できます(参照*10)。

課金モデルは従量制で、使った分だけ支払いが発生します。まずは小規模テストでコストをモニタリングし、想定利用量と料金を算出することが推奨されます。無料クレジットが付与される場合もあるため、導入初期はその範囲で試行し、運用後の見通しを立てるのが一般的です。十分な評価期間を設けることで、コスト超過リスクを回避できます。

APIキー・サービスアカウントの管理

APIキーはOpenAIの管理画面で発行し、Bearerトークンとして利用します(参照*11)。複数のサービスアカウントを使い分けることで、プロジェクトや部署単位でキーを分割管理でき、漏洩時の被害範囲を限定できます。

キーの保管場所には細心の注意が必要です。環境変数やVaultサービス(AWS Secrets Managerなど)を活用し、公開リポジトリやクライアントサイドコードでのキー露出を避ける運用が求められます。近年はプロジェクト単位キーへの移行が進み、監査やキーのローテーションも容易になっています。

開発環境構築とSDK選定

ChatGPT API活用には開発環境の整備が必要です。主要言語のSDKやライブラリを導入し、Pythonの場合はopenaiライブラリをpipでインストールして最小サンプルコードでテストできます(参照*2)。APIキーは環境変数OPENAI_API_KEYに設定し、端末やシェルの設定ファイルで管理するのが一般的です(参照*7)。

言語やフレームワークによっては公式以外のラッパーライブラリも存在します。検証や運用規模に応じて最適なSDKを選び、バージョン管理や更新時の互換性にも注意しましょう。大規模案件では一括デプロイやCI/CDツールとの統合も含めた環境構築が必要です。

ChatGPT APIの実装方法(Python編)

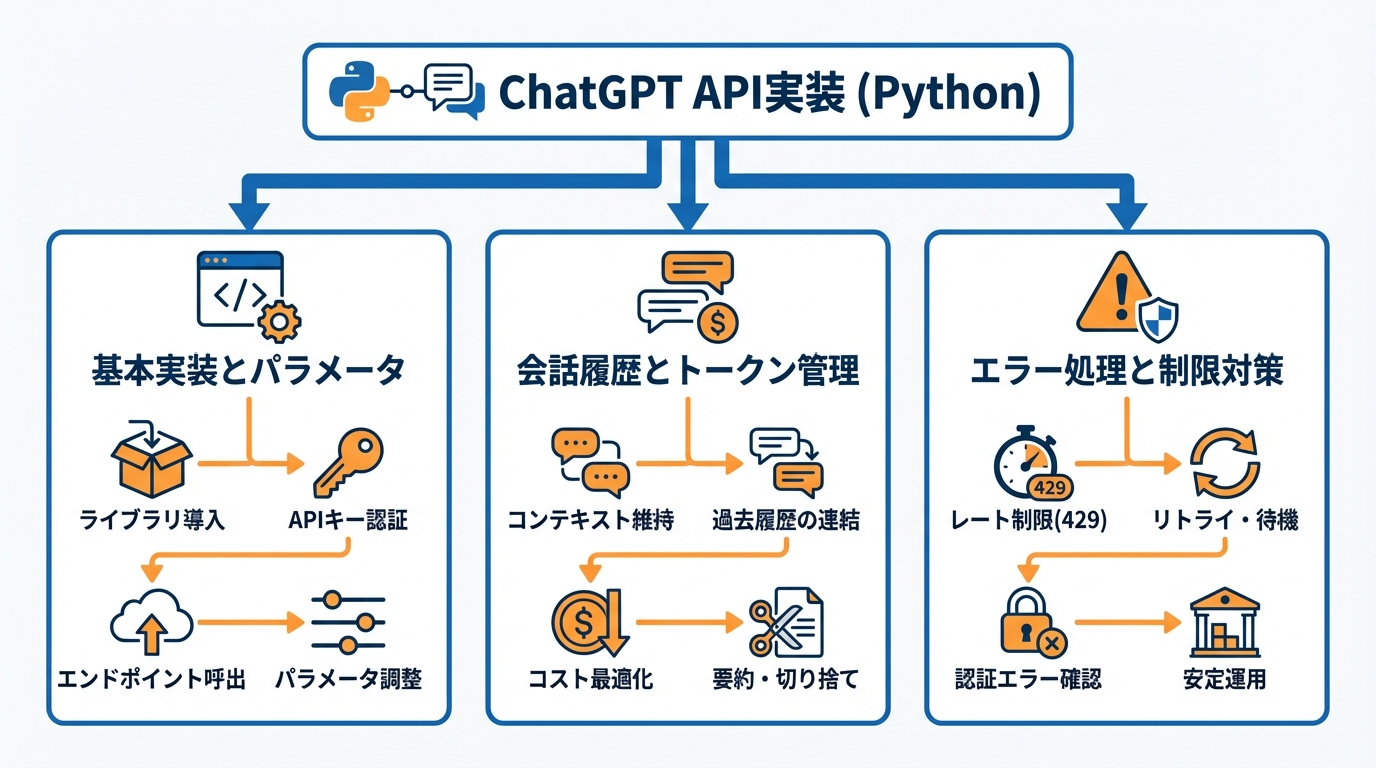

最小サンプルコードと基本パラメータ

PythonでChatGPT APIを呼び出す場合、まずpip install openaiでライブラリを導入します。import openaiでライブラリを読み込み、openai.api_keyに環境変数や設定ファイルから取得したAPIキーを指定します(参照*2)。呼び出しにはCompletion APIやChat Completions APIのエンドポイントを利用し、modelパラメータでGPT-4o-miniやgpt-4oなどを選択してテキスト生成を行います(参照*7)。

メッセージ内容にはsystemロールで全体のコンテキストや口調を設定するのが一般的です。温度パラメータやmax_tokensなどのオプションで文章のクリエイティビティや出力サイズを調整できます。初めて試す場合はサンプルコードを最小限にまとめて動作確認し、正常な応答が返ることを確かめてから追加パラメータを調整しましょう。

会話履歴管理とトークン制御

ChatGPTは会話型生成AIであり、コンテキスト維持のため過去メッセージを連結して送信します。長い会話ほどトークン消費が増え、従量課金の負担も大きくなります。トークンコスト最適化には、不要な履歴を途中で切り捨てたり、要約テキストに置き換えてコンテキストを簡略化する方法が有効です(参照*7)。

会話継続が必要なシステムでも、一定量以上の履歴が精度向上に寄与しない場合は、過去をフェードアウトさせる仕組みを実装することで、不要なコスト拡大を防ぎつつ適度な文脈を保持できます。これらの管理は主にサーバーサイドで行われ、データベースやキャッシュを活用した柔軟な履歴ストレージ設計が重要です。

エラー処理とレート制限対策

PythonからChatGPT APIを大量に呼び出すと、429エラー(レート制限エラー)が発生することがあります(参照*12)。これは短時間に大量リクエストを送信した場合や無料プランの呼び出し回数超過時に発生します。解決策としては、バックオフ実装や再試行タイミングの調整など、リクエスト制御が有効です。

ネットワークや認証トラブルで401や403エラーが返る場合もあります。その際はAPIキーの有効性や組織ID、環境変数設定やアクセス権限の確認が重要です。これらのエラーハンドリングをしっかり実装することで、安定したAPI呼び出しとコスト管理を両立できます。

ChatGPT APIの実装方法(フロントエンド・JavaScript編)

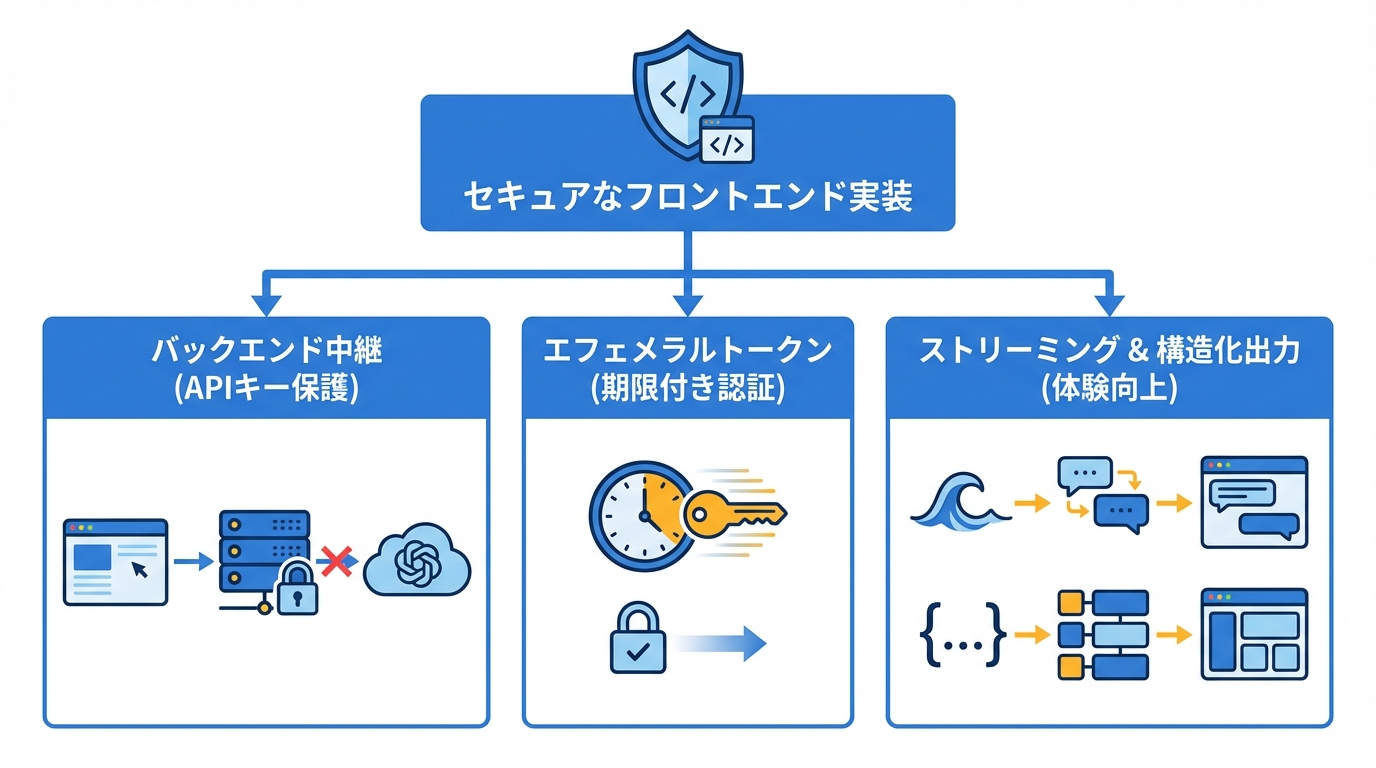

ブラウザ拡張・Webアプリからの呼び出し

ChatGPT APIはJavaScriptから直接POSTリクエストを送ることも可能ですが、APIキーをフロントエンドに埋め込むとセキュリティリスクが生じます。そのため、通常はバックエンドやプロキシサーバーを設置しAPIキーを保護します。たとえばブラウザ拡張機能では、閲覧中ページ情報をJavaScriptで整形し、要約や翻訳をChatGPTに依頼して結果をコピーする機能を実装できます(参照*13)。

Webアプリ統合時も同様に、バックエンド側でAPIキーを保持し、リクエストを中継するフローが一般的です。フロントエンドが取得するのは整形済みの結果のみとし、キー漏洩を防ぎつつ動的な文章生成や自動応答機能を利用できます。

セキュアな認証とエフェメラルトークン

長期有効なAPIキーをクライアントへ渡すと、流出時に大きな損害が発生します。OpenAIでは短期間のみ有効なエフェメラルトークンをバックエンドで発行し、クライアント側に渡す運用が推奨されています(参照*11)。このトークンは有効期限後に使えなくなり、万一盗み見られても被害を最小限に抑えられます。

Azure OpenAIなどクラウド事業者と連携する場合は、APIキーに加えID認証を組み合わせたアクセス制御も利用可能です。大規模システムでは認証や監査ログを統合し、プロジェクトごとのAPI利用状況を管理しやすくする構造がポイントです。

ストリーミングと構造化出力の活用

フロントエンドでリアルタイム応答を表示したい場合は、ストリーミングオプションの利用が有効です。ChatGPT APIではResponses APIを通じて、テキスト生成過程をリアルタイムで受け取りながら表示できます(参照*3)。これによりユーザーは途中経過を待たずに対話内容を確認でき、インタラクティブな体験を提供できます。

また、JSONモード(構造化出力)にも対応しており、応答をキーと値の形で受け取り、フロントエンドで安全かつ正確に扱うことが可能です。自動処理やUIへのデータ反映などにも役立ちます。

チャットボット・業務システムへのChatGPT API組み込み設計

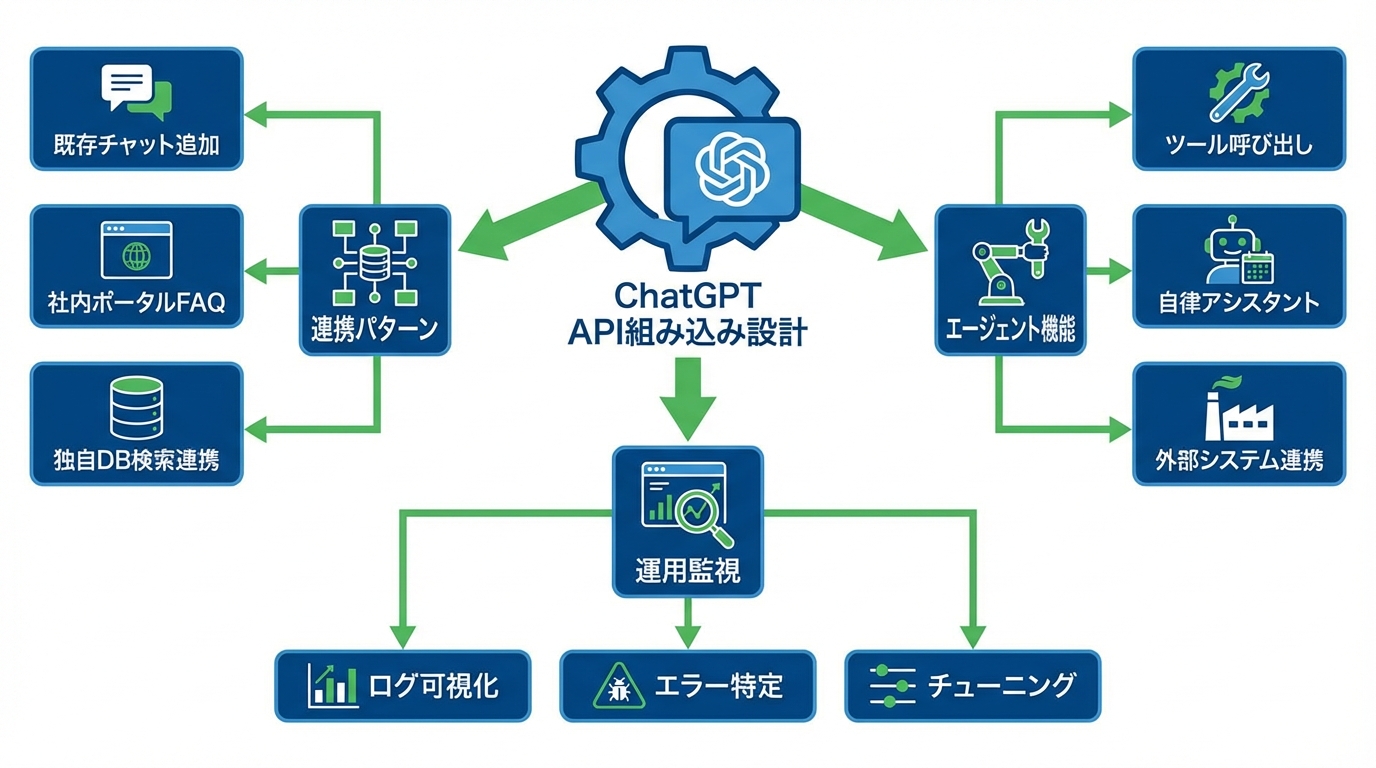

既存システムへの連携パターン

ChatGPT APIを業務システムに統合するには、さまざまな連携パターンが考えられます。たとえば既存の顧客対応チャットシステムへの追加や、社内ポータル・FAQシステムへの自然言語応答機能付与が典型です。自社データベースと独自ドキュメント検索APIを組み合わせ、検索結果をもとにChatGPTが回答を生成する高度な仕組みも構築できます(参照*6)。

顧客向けには多言語翻訳機能、社内向けにはレポート自動作成機能など、用途ごとにAPIを共有するケースもあります。利用実態に応じたレート制限やAPIキー配布設計も重要で、アクセス頻度の高いシステムには十分な割当を行い、低頻度システムは軽量モデルを使うなど、柔軟な運用で最適化が可能です。

エージェント・ツール呼び出しの設計

ChatGPT APIは会話ベースのテキスト生成に加え、エージェント構築にも利用できます。たとえば外部ツール呼び出し命令を組み込み、ユーザー依頼に応じてAPIが自動的に計算サービスやデータベースアクセスを行う仕組みも構築可能です(参照*3)。この場合、やり取りのフロー制御やバリデーション、ログ取得などの仕組みを設計することが推奨されます。

企業向けの高度な使い方では、ChatGPTが自律的なアシスタントとしてスケジュール調整やドキュメント生成、生産管理システムとの連携まで担うケースも増えています。拡張設計時はAPIのバージョンアップや新機能・仕様変更への対応体制を整えておくと安心です。

運用時の監視・ログ・チューニング

システムに組み込んだChatGPT APIが安定したパフォーマンスを維持するには、運用時の監視とログ取得が不可欠です。リクエスト数やレスポンスタイム、エラー頻度を可視化し、異常発生時に原因を特定できる仕組みを整える必要があります(参照*2)。

高負荷モデルや多数ユーザーの同時アクセス時はレート制限に抵触しやすくなるため、API呼び出し間隔やバッチ処理スケジューリングの調整、ログ分析による不要リクエスト削減など、細やかなチューニングが重要です。継続的な最適化運用で安定性と高い対話品質を両立できます。

セキュリティ・認証・トラブルシューティングの実践ポイント

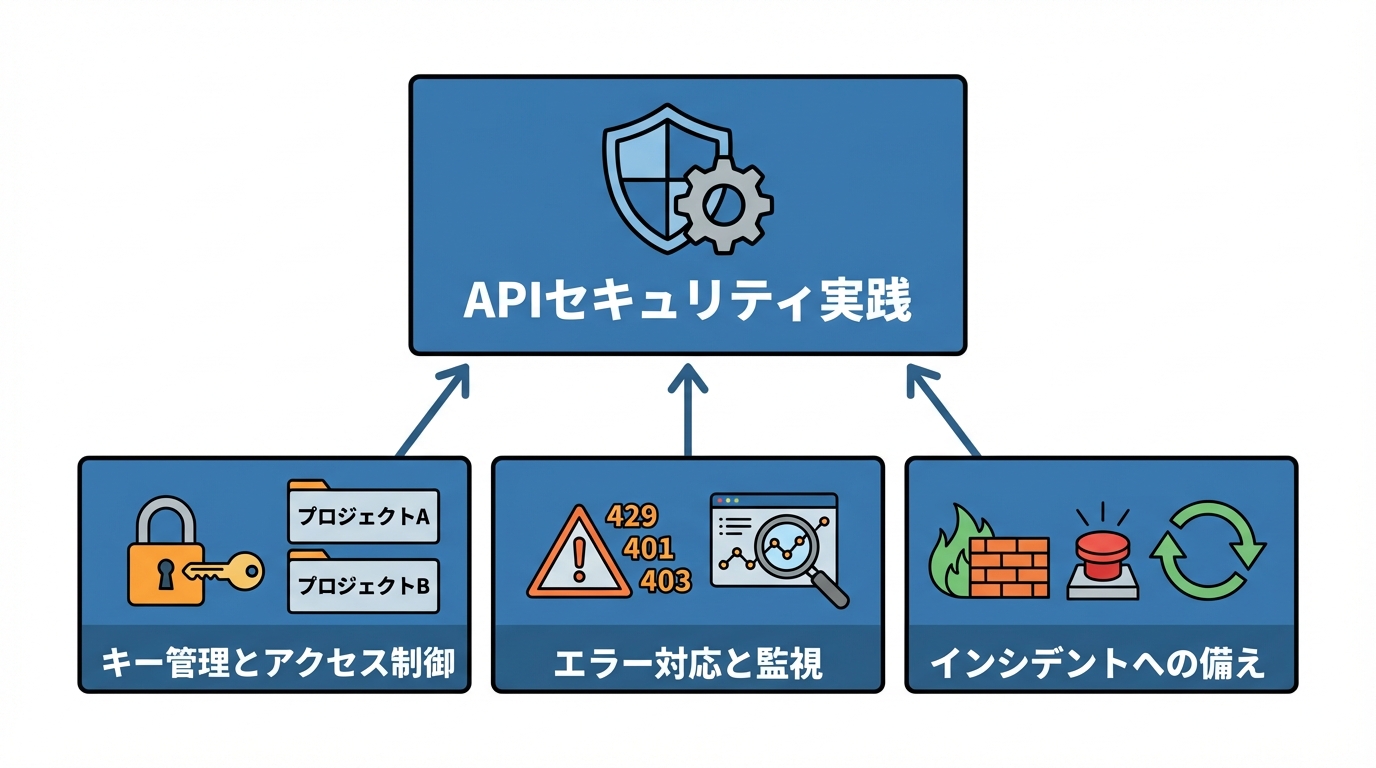

APIキー漏洩対策とプロジェクト分離

APIキーが第三者に流出すると、不正利用や高額課金のリスクがあります。キーは環境変数やAWS Secrets Manager、Azure Key Vaultなどのセキュアストレージで管理し、コードや公開リポジトリに埋め込まない運用を徹底します(参照*11)。プロジェクト単位でキーを分離し、万一一つのキーが漏洩しても他プロジェクトへの影響を最小限に抑える設計が有効です。

大規模組織では複数チームや部署が同時にAPIへアクセスするケースも多く、権限設定や監査ログ管理を徹底することでトレーサビリティと内部統制を確立できます。組織IDや請求プロジェクトIDの明確な使い分けで、トラブル発生時の原因特定も容易になります。

認証エラー・429/401/403の対処

ChatGPT API利用時には、429エラー(レート制限)、401・403エラー(認証関連)が発生することがあります(参照*12)。429はリクエスト過多時に発生し、バックオフやリトライ戦略で対応します。401は無効なAPIキーや欠落時、403は組織権限やプラン不一致時に発生するため、設定や権限の再確認が必要です(参照*14)。

エラーログの定期取得・分析により、発生タイミングや頻度を把握し、適切な対策を講じやすくなります。大規模組織では認証と課金情報の紐付けが複雑になるため、カスタムヘッダやX-Request-ID活用でリクエスト追跡性を高める工夫も有効です。

インシデント・情報流出への備え

外部サービスの不正アクセスによる情報流出リスクにも備える必要があります。2025年11月には、OpenAIがデータ分析プロバイダーMixpanelでの不正アクセスを公表し、一部APIユーザー情報が流出した可能性が指摘されました(参照*15)。チャット内容やAPIキーなど機密情報は流出しなかったとされていますが、外部ツール導入時のセキュリティリスクは常に存在します。

対策としては、キーマネジメントの一元化やキーの定期ローテーション、小規模プロジェクトへの分散管理などが挙げられます(参照*10)。インシデント発生時には迅速なAPIキー失効や連絡フローを定めておくことも重要です。リスクをゼロにすることは難しいため、事前に備えたセキュリティ運用が求められます。

おわりに:ChatGPT APIを安全かつ効率的に活用するために

本記事では、ChatGPT APIの概要や最新動向、導入準備、料金体系、実装方法、セキュリティ面の注意点まで体系的に解説しました。Web版の利便性だけでなく、APIとして統合することで業務やサービスに大きな付加価値をもたらすことができます。

安全性やコスト管理を意識したデプロイ・運用、モニタリングやエラー処理の徹底により、ChatGPT APIのポテンシャルを最大限に引き出せます。DX推進や業務自動化を目指す企業の皆さまも、本記事を参考に効率的かつ安全なAI活用を進めてみてください。

監修者

安達裕哉(あだち ゆうや)

デロイト トーマツ コンサルティングにて品質マネジメント、人事などの分野でコンサルティングに従事しその後、監査法人トーマツの中小企業向けコンサルティング部門の立ち上げに参画。大阪支社長、東京支社長を歴任したのち2013年5月にwebマーケティング、コンテンツ制作を行う「ティネクト株式会社」を設立。ビジネスメディア「Books&Apps」を運営。

2023年7月に生成AIコンサルティング、およびAIメディア運営を行う「ワークワンダース株式会社」を設立。ICJ2号ファンドによる調達を実施(1.3億円)。

著書「頭のいい人が話す前に考えていること」 が、82万部(2025年3月時点)を売り上げる。

(“2023年・2024年上半期に日本で一番売れたビジネス書”(トーハン調べ/日販調べ))

参照

- (*1) AIの基礎知識 | 人工知能・AIを活用した、様々な業務の自動化、効率化に役立つ基礎知識をご紹介します。 – ChatGPT APIの始め方とは?料金、使い方、Web版との違いまで分かりやすく解説

- (*2) AIsmiley – ChatGPT APIとは?始め方や使用時の注意点、活用事例を紹介

- (*3) WEEL – OpenAI API(ChatGPT API)」まとめ!最新モデル・料金・Responses API対応の使い方を解説

- (*4) システム開発のプロが発注成功を手助けする【発注ラウンジ】 – ChatGPTのAPI料金はどのくらい?活用方法やモデル選びでコストを抑える方法を徹底解説!

- (*5) When should you use ChatGPT and when should you use the API version?

- (*6) 【株式会社 ObotAI】 – – ChatGPT APIとは?使い方・料金・注意点・活用事例などを解説!

- (*7) OpenAIのAPIを使う

- (*8) Data Studios ‧Exafin – ChatGPT: token limits and context windows updated for all models in 2025

- (*9) Gemini API – テックメモ

- (*10) AI Direct Editor – ChatGPTのAPIキー設定方法

- (*11) Data Studios ‧Exafin – OpenAI authentication in 2025: API keys, service accounts, and secure token flows for developers and enterprises

- (*12) GeeksforGeeks – How to Fix ChatGPT API Error 429 "Too many requests"

- (*13) 無駄と文化 – ココピーからChatGPTを呼んで文章生成させる

- (*14) OpenAI Developer Community – Why doesn’t OpenAI image generation authenticate in Dify?

- (*15) Yahoo!ニュース – OpenAIのユーザー情報が流出の可能性、データ分析企業への不正アクセスで–影響範囲は?(CNET Japan)