はじめに:Dify導入成功の背景と本記事の狙い

近年、多くの企業がAIプラットフォームの導入を進め、業務効率化やコスト削減を実現しています。その中でもDifyは、生産性向上を支える低コード開発基盤として注目されています。アプリケーション開発のハードルが下がり、幅広い部署が活用できる点が大きな特徴です(参照*1)。

本記事では、Dify導入を成功させた企業の事例を中心に、機能面・組織面・インフラ面など多角的な視点から導入の背景と効果を整理します。現場レベルでの活用から大規模基盤の変革まで、実際の成功パターンを読み解き、読者が明日から使える知見を提供します。

事例から見るDify導入の全体像

Dify導入企業の共通点とスケール感

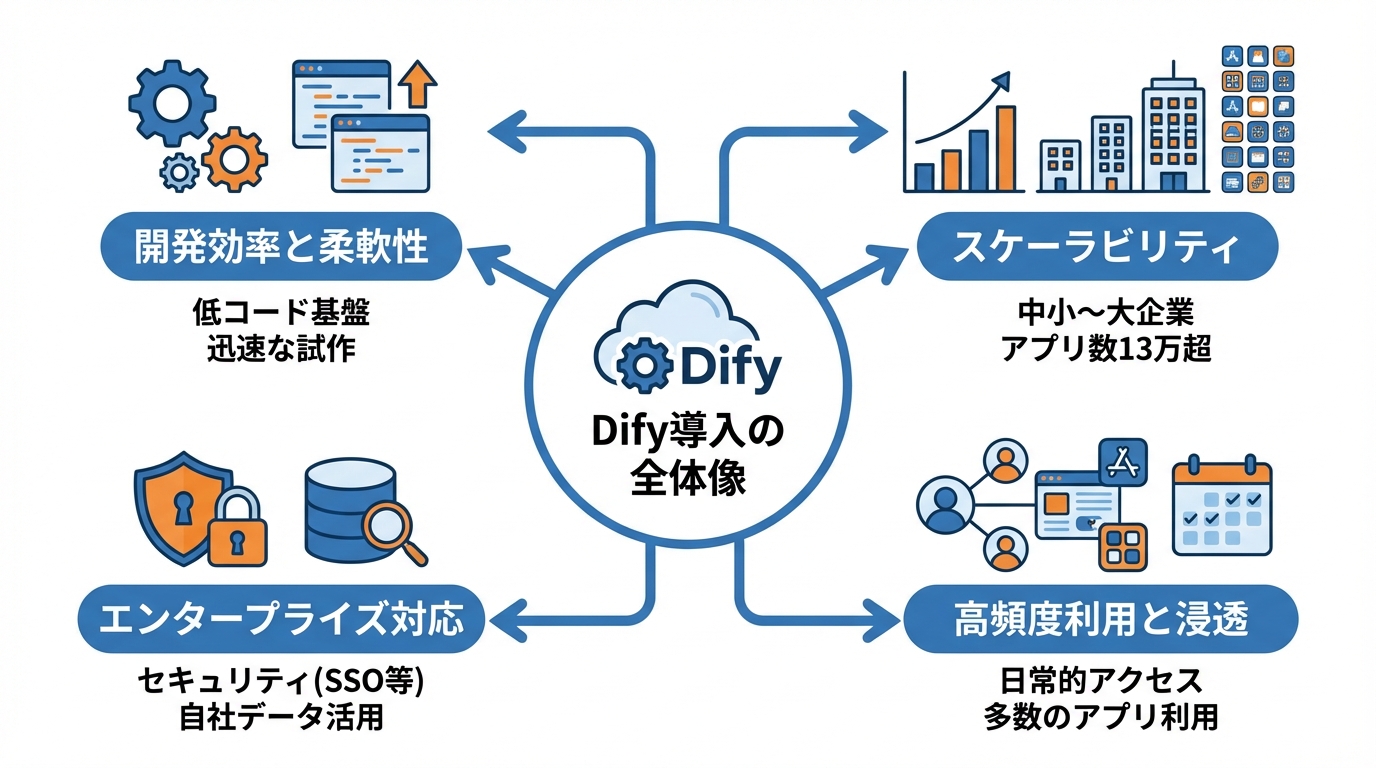

Difyは「Define」と「Modify」を組み合わせた設計思想を持ち、日常的にアプリケーションを定義・改善しながら使い続けることを重視しています(参照*1)。複数の企業事例に共通するのは、アプリケーション開発効率の向上と運用の柔軟性を両立しやすい点です。2024年中頃時点でクラウド上のアプリ作成数が13万件を超え、GitHub上のスター数も約34,800を記録しており、多方面で支持を獲得しています(参照*1)。

スケール面では、中小企業から大企業まで幅広く導入が進んでいます。Difyの「production-ready」な運用環境や、SSO(シングルサインオン)・アクセス管理・監査ログなどのセキュリティオプションが、導入の後押しとなっています(参照*2)。導入企業は自社データの活用に積極的で、エンタープライズ運用を慎重に進める傾向があります。また、社内でAI人材を育成しながら、迅速かつ安全な業務効率化を目指している点も共通しています。

アプリ数・利用頻度から見る活用度合い

Difyが提供する低コード開発基盤は、専任の開発者だけでなく幅広い部門の社員がアプリ開発に携われる可能性を広げています。例えば、ある大手家電企業では1か月のトライアル期間中に200件を超えるAIアプリが作成され、その後60件以上が積極的に利用されるなど、短期間で多くのアプリを試作し、本番運用に移すスピード感が特徴です(参照*3)(参照*4)。

さらに、同一企業内で最も利用されるアプリが1万回以上使われている事例もあり、社員が複数のAIアプリに日常的にアクセスし、継続的に業務活用していることがDifyの社内浸透率の高さを示しています(参照*3)。このような利用頻度の背景には、ユーザーが手軽に高度なLLM(大規模言語モデル)を呼び出せる仕組みや、既存業務と直結したテンプレートが多数用意されていることが大きく貢献しています。

Difyが選ばれる機能面の特徴

Difyを導入した企業が評価する機能面の特徴は大きく二つあります。1つ目は、クラウドベースでありながら、セキュリティやアクセス管理を細かく設定できる柔軟性です。SSO連携やデータ分離運用、監査ログなど企業向け機能が整備されており、運用ポリシーに適合しやすい点が挙げられます(参照*1)。

2つ目は、GPTやClaudeなど複数のLLMに対応したアプリ開発が容易な点です。ローカルデータを参照するRAG(Retrieval-Augmented Generation)機能により、AIが企業の持つドキュメントを参照して回答を生成する事例も増えています(参照*5)。ベクトル索引技術を活用したデータ取り込みや検索のしやすさも、多くの企業がDifyを選ぶ要因となっています。

業務生産性向上の事例:現場主導で広がるDify活用

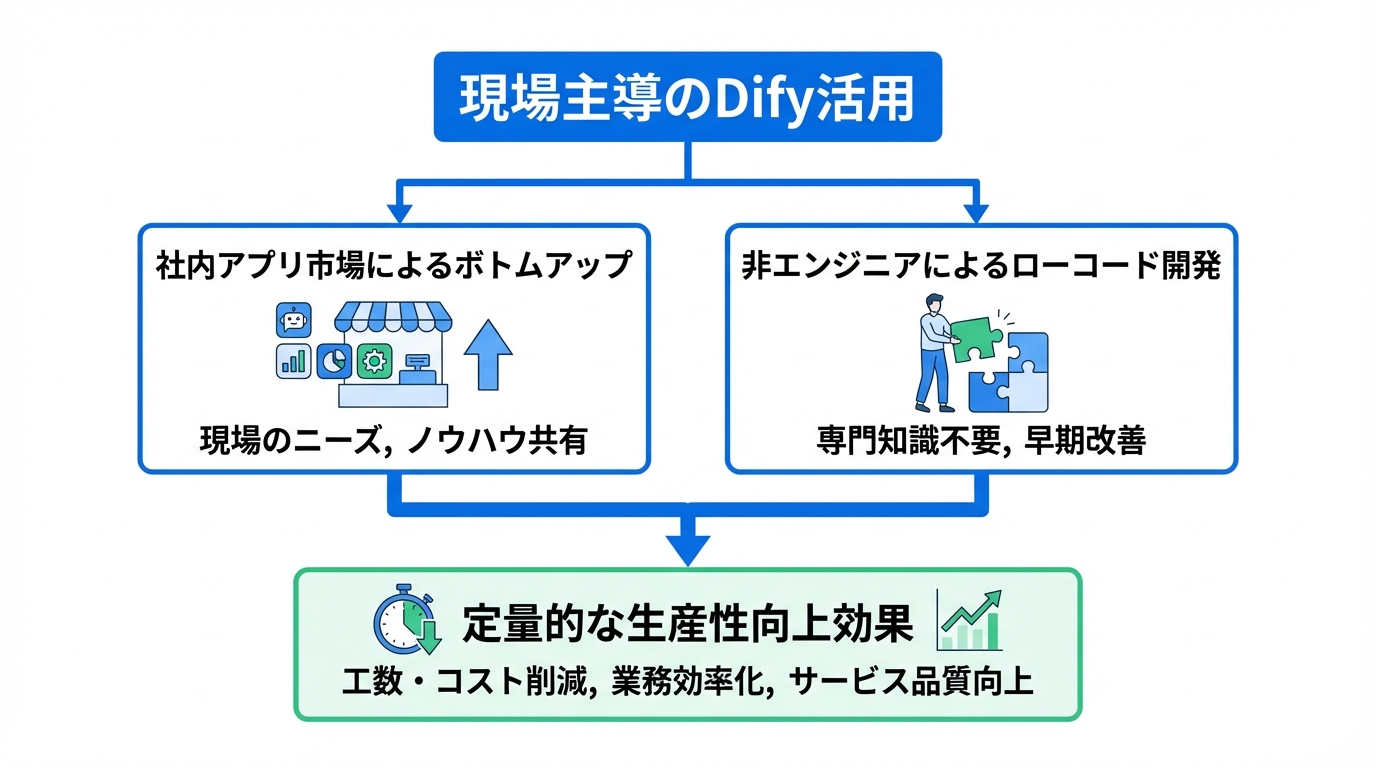

社内AIアプリ市場によるボトムアップ浸透

Dify導入が進んだ企業では、社内にミニアプリの開発文化が根付きつつあります。開発チームだけでなく支援部門や若手社員も、社内アプリマーケットに自作AIプロトタイプを登録し合い、ノウハウを共有しています(参照*3)。このような社内AIアプリ市場は、一定のガイドラインや利用ルールを設けることで秩序あるコミュニティとして機能します。

例えば、月間5万件のユーザーレビューを自動処理するケースでは、従来人手で数日かかっていた作業が大幅に効率化されました(参照*3)。属人的な業務プロセスから脱却したいという現場のニーズが、ボトムアップの推進力となっています。Difyを活用することで、部署ごとの業務課題に合わせたアプリが次々と生まれ、現場レベルの創意工夫が全社的な効果につながっています。

非エンジニアによるローコード開発の成功パターン

Difyは低コード開発環境を提供しており、プログラミング経験がほとんどない非エンジニア層もAIアプリの構築に携われるようになりました。例えば、ある開発者がプロダクトマネージャーの支援なしで2日間ほどでサポート用チャットボットを開発した事例があり、専門知識を必須としない開発プロセスが確立されています(参照*3)。

ローコード開発が成功するためには、社内にチュートリアルや事例が蓄積され、必要な時に参照しやすい環境が重要です。運用担当者やマーケティング担当者が同じUIを使ってアプリロジックを調整し、データ連携の仕組みを理解している姿も多く見られます。月間のアプリ利用データを可視化し、早期に改善を繰り返すことで、部門単位でもAI技術を十分に扱えるようになります。こうした成功パターンは、少人数からスタートし、段階的に展開する形で促進される傾向があります。

業務プロセス改善と生産性向上の定量効果

Dify導入による工数削減やコスト削減の具体的な効果は、多くの企業が注目するポイントです。ある事例では、VoC(顧客の声)分析にかかる時間が8時間から3時間に短縮され、製品のNPS(顧客推奨度)改善にも貢献しています(参照*3)。大量のレビューや問い合わせが日々蓄積される現場では、こうした時間短縮は業務効率だけでなくサービス品質にも直結する大きなメリットです。

また、従来15,000件ほどしか処理できなかった月間ワークフローを5万件まで拡大した例もあります。AIエージェントが翻訳やラベリング、ビッグデータ分析などを分担することで、人手リソースの一部を他の優先度の高い業務へ振り向けられるようになりました(参照*3)。これらのデータは、現場のイノベーションが会社全体のコスト構造に波及する可能性を示しており、Dify導入の具体的効果として注目されています。

顧客体験・チャットボットの事例:既存システムとの統合

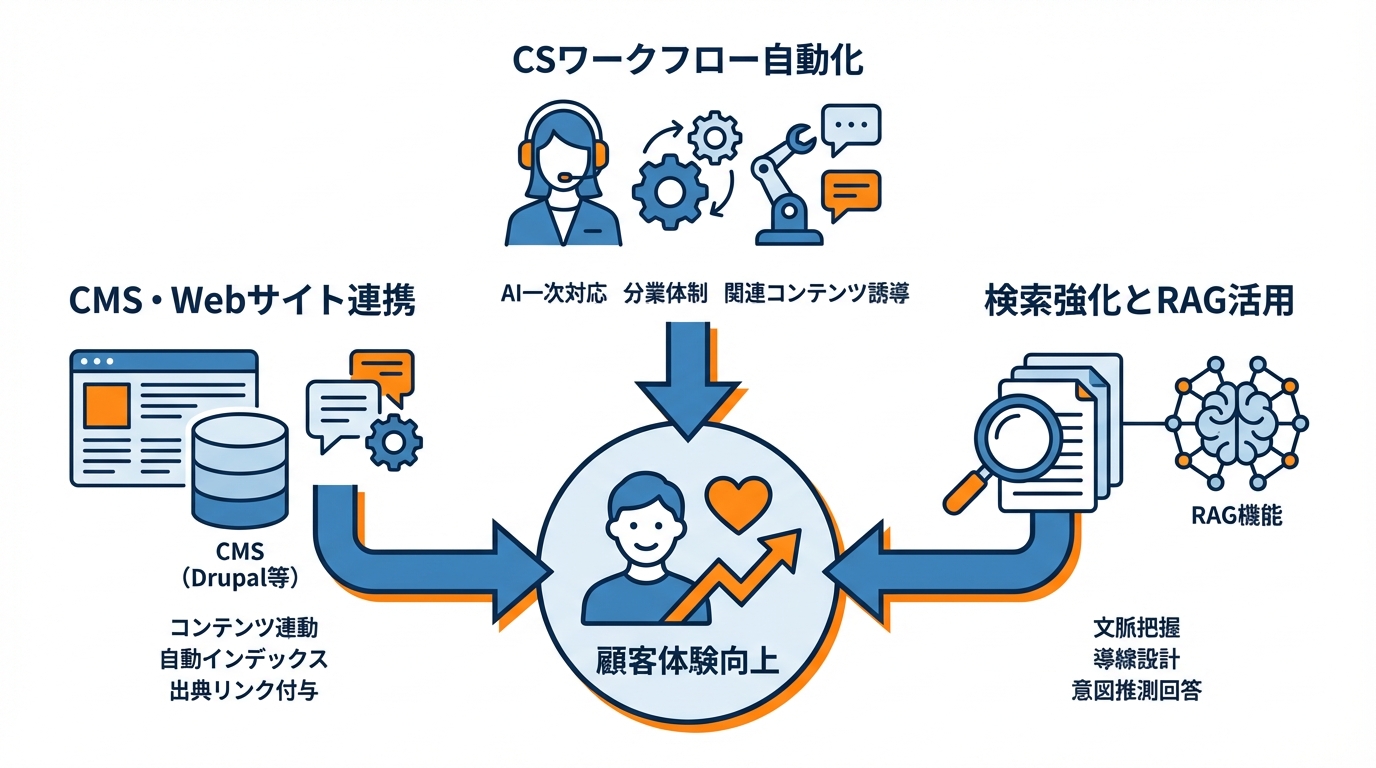

CMS・Webサイトとのチャットボット連携事例

顧客接点としてチャットボットを設置する際、既存のCMS(コンテンツ管理システム)やWebサイトとの統合が重要なテーマとなります。Difyは多様なプラグインやモジュールを提供しており、DrupalのようなCMSにも簡単に組み込むことができます(参照*6)。

この連携により、サイト上のコンテンツ更新と同時に自動でインデックスを作成し、チャットボットの回答精度を高める事例が報告されています。調整次第では、ユーザーの感情応答戦略に合わせて応答スタイルを変化させることも実装可能です。チャットボットの応答には元のDrupalコンテンツへの出典リンクが自動付与されるため、ユーザーの信頼性向上にも寄与しています(参照*6)。初回応対での解決率やユーザー満足度など、複数の指標で向上が見られた企業もあり、顧客体験全体を一貫したサービスとして提供できる点が評価されています。

カスタマーサポートワークフロー自動化事例

カスタマーサポート部門では、Difyを活用したチャットボットやFAQ自動生成などのワークフロー自動化が進んでいます。例えば、複数のシステムから問い合わせ内容と顧客データを紐づけてAIが一次対応を行う仕組みが導入され、回答作成時間が短縮されました。難度の高い問い合わせのみを人間が担当する分業体制が実現しています(参照*7)。

また、ユーザーがサイト内で見つけられなかった情報をチャットボット経由で問い合わせた際、関連コンテンツへスムーズに誘導する仕組みも導入されています。DifyのRAG機能と連携することで、問い合わせの意図に近い文書やサードパーティ情報を迅速に参照できる点がメリットです。こうしたワークフロー自動化事例は、利用者満足度を高めるだけでなく、サポートチームのリソースを戦略的業務へ振り向ける一助となっています。

検索強化とRAG活用による顧客体験向上事例

DifyのRAG機能は検索精度を高める鍵となっています。コーポレートサイトやECサイトなどで、従来の検索機能では限定的だった文脈把握を、ベクトル化したデータ参照によって実現できる点が利点です(参照*5)。また、検索結果と連携するチャットボットがユーザーの意図を推測しながら関連する商品やページを案内することで、ユーザーは回答を得るまでのステップ数を減らせます。

こうした顧客体験向上の取り組みは、海外企業でも多く導入が進んでいます。既存の検索インタフェースを置き換えるだけでなく、サイト全体の導線設計と合わせてRAGを活用することで、オンラインでのエンゲージメントが高まりやすくなるという報告も見られます。結果として、顧客の課題解決スピードやブランドへの信頼感が向上し、問い合わせの重複や返答漏れなどのミスを削減することにつながります。

インフラ・データ基盤を変革したDify導入事例

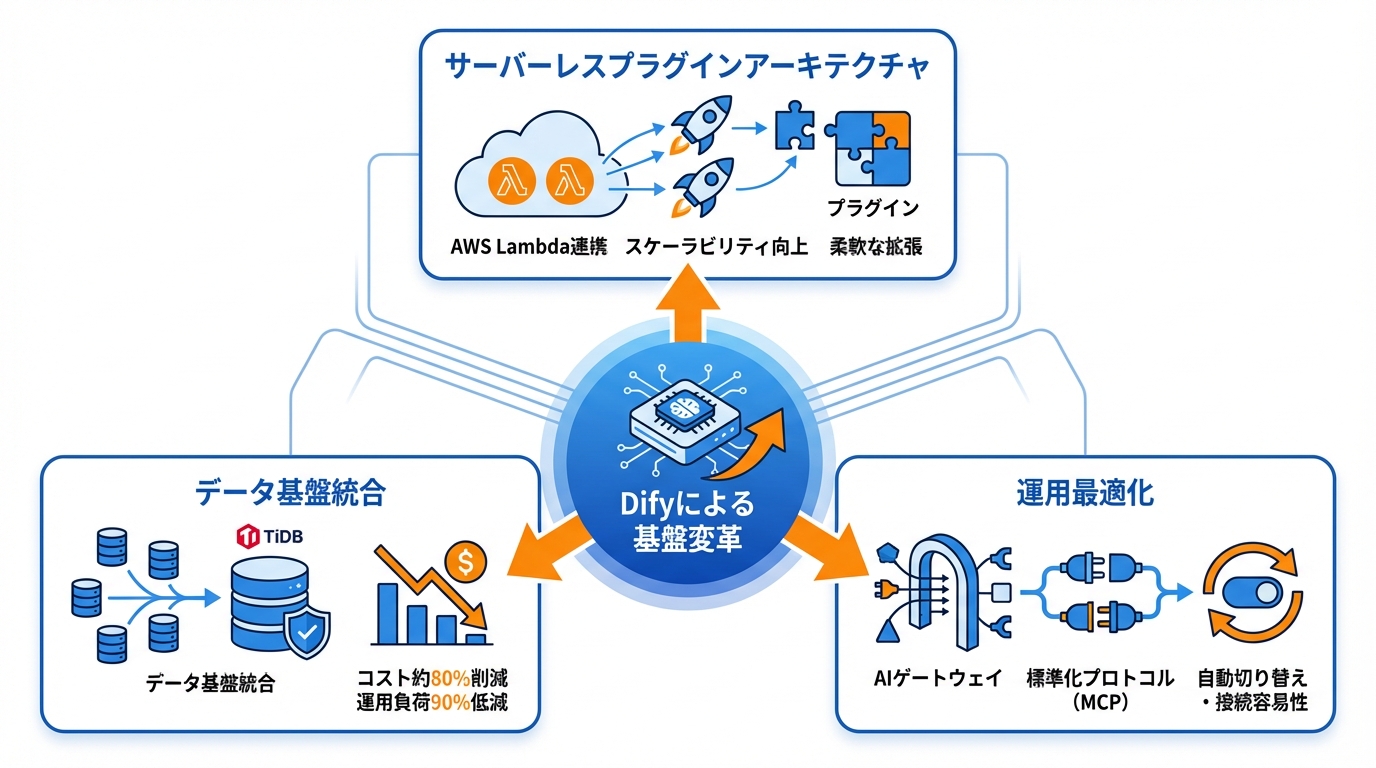

サーバーレスプラグインアーキテクチャの導入事例

Difyはバックエンドでプラグインベースのアーキテクチャを採用しており、必要な機能を柔軟に追加できます。特にAWS Lambdaと連携したサーバーレス構成の事例では、プラグインごとに独自のランタイム環境を切り分けることで、他の機能への影響を最小限に抑えつつ拡張が可能です(参照*8)。

この仕組みにより、2300以上のAWS Lambda関数を並行稼働させ、毎月数百万件のプラグイン呼び出しを処理するスケーラビリティを実現しています。ユーザー数60万超の環境や100万件を超えるアプリを公開しているSaaSプラットフォームでも、必要に応じたスケールアップ・スケールダウンが容易です。また、24時間365日稼働させる複数のサーバーを抱える必要がないため、コンピューティングリソースの利用効率も高まっています。

TiDBによるデータ基盤統合とコスト削減事例

Dify導入企業の中には、大量のデータを集計・分析するニーズが高い企業も多く存在します。そうした企業では、データベースの統合がボトルネックになることが多いですが、TiDB Cloud Starterを活用して従来のデータベースコンテナを一元化し、約80%のコスト削減に成功した事例があります(参照*9)。

このとき、ほぼ50万のコンテナに分散されていたデータをTiDBのクラスタにまとめることで、インフラ運用負荷の90%低減も達成しています。AIアプリケーションがリアルタイムなデータ分析を前提とする場合も多いため、スケールアウトが容易なTiDBの特性はDifyの運用上も大きなアドバンテージとなります。社内の大量データを扱いながらもSQLベースで統合的な管理を実現し、ベクトル分析にも対応できるのが特徴です。

AIゲートウェイと標準化プロトコルによる運用最適化事例

DifyはOpenAPI連携をサポートしており、企業が複数の外部ツールや専門機能を組み合わせて使う際も接続が容易です。新たに注目されているMCP(マルチコンポーネントプロトコル)の実装事例では、外部サービスとの通信を標準プロトコルレベルで行うことで、カスタマイズ開発の負担を軽減しています(参照*10)。

障害発生時の自動切り替えやロードバランシングなどの仕組みも整備されており、OpenAIのモデルが障害を起こした場合には別のモデルに移行するなど、運用最適化が実現しています(参照*11)。加えて、権限管理やAPIキー認証などのセキュリティ対策を組み合わせることで、運用上のリスクを抑えつつ拡張性を維持できる点も評価されています。AIゲートウェイ的なアプローチによって、Difyプラットフォームと連携するさまざまなツールが一貫性をもって統合されています。

研究・実験プラットフォームへの組み込み事例

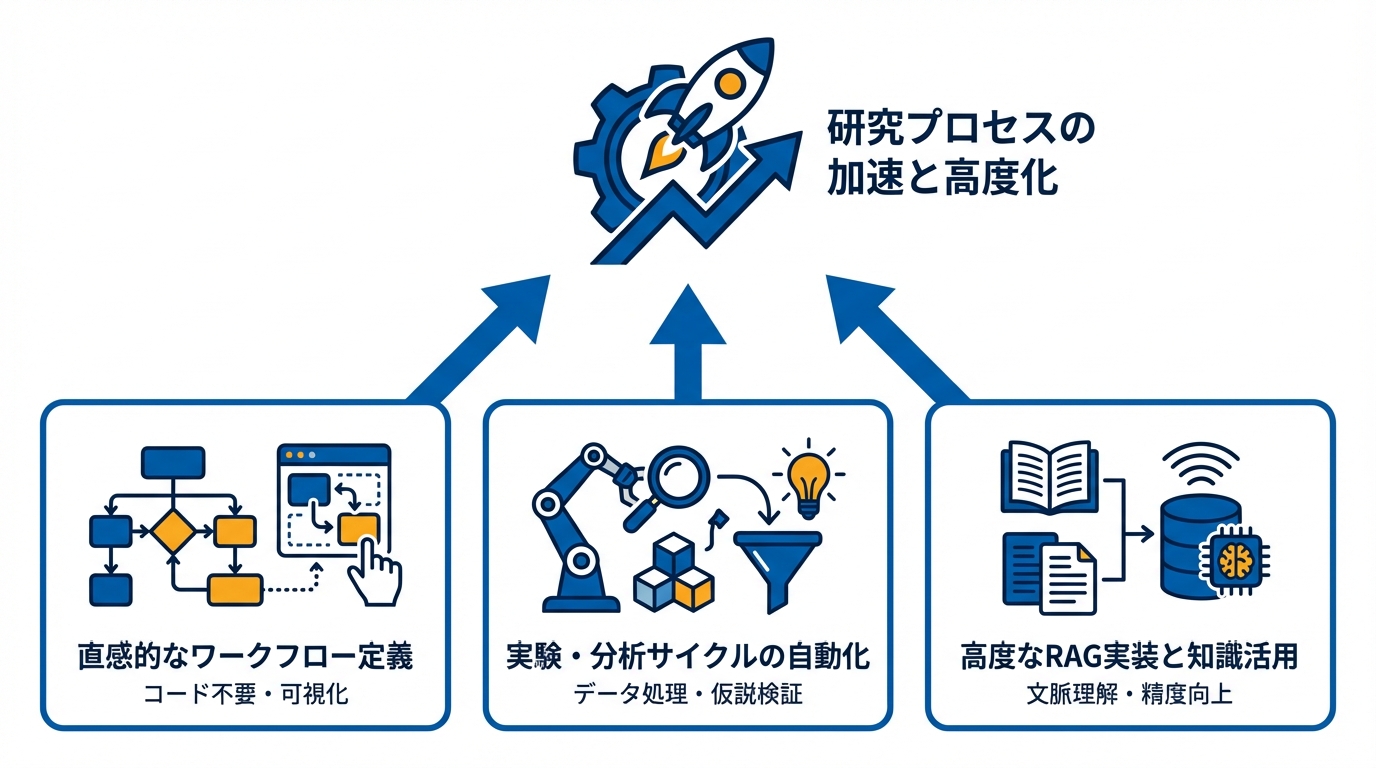

社会科学実験プラットフォームへのDify統合事例

研究現場でも高度なデータ処理や分析ニーズが増え、迅速かつ容易にLLMを活用できる環境が求められています。ある社会科学分野の実験プラットフォームでは、DifyのWorkflow機能を通じて研究者が直感的にプロンプトやデータフローを定義し、AIモデルを呼び出せるようになっています(参照*12)。

これにより、研究者がコードを書かなくても分析手順を可視化し、複数のモデルや外部APIを組み合わせた実験を実施しやすくなりました。理論面の検証から実装、実験結果のデプロイまでを一気通貫で進められるため、研究開発全体のサイクルが短縮される事例も報告されています。

Deep ResearchワークフローとしてのDify活用事例

研究目的でDifyを活用する際、ワークフロー全体を一元管理し、求める結果が得られるまで何度も繰り返し検証するケースが増えています。Tavily検索などの外部検索と組み合わせ、必要な文献や論文データを取り込みつつ、Difyが用意する開発インタフェースでAIエージェントを制御する流れがあります(参照*13)。

この仕組みによって、実験データの分析や仮説の絞り込みを自動化し、研究者が本質的な考察に集中できる体制が整いつつあります。また、権限管理や監査ログを適切に設定することで、研究プロセスの透明性や再現性を損なうことなく、高いセキュリティ基準を満たせる利点も注目されています。特に大規模研究プロジェクトでは、この種のプラットフォーム連携が研究効率の向上とリスク管理を両立するポイントとなっています。

大規模言語モデル実験におけるRAG実装事例

大規模言語モデル(LLM)の研究ではRAG機能を活用した実験が盛んに行われています。Difyフレームワークを用いて、600トークン程度の単位でコーパスを分割し、ベクトル埋め込みモデルBGE-M3でインデックス化を行う事例が一例です(参照*14)。このような仕組みを通じて、LLMがエンドユーザーに対してより正確で文脈に即した回答を提示できるようになり、研究精度の向上に寄与しています。

法域文書の分類タスクなど、特定領域に特化したモデルを組み合わせる際にもDifyは有効とされています。LLaMAのようなモデルで翻訳や取り込みを進めながら、その結果を即時にRAGで再ランク付けすることで、動きのある研究プラットフォームへ拡張が可能です。実験規模が大きくなるほど手動管理が難しくなりますが、Difyの低コードワークフローを活用することで、それぞれのステップを一元的に管理できる点が評価されています。

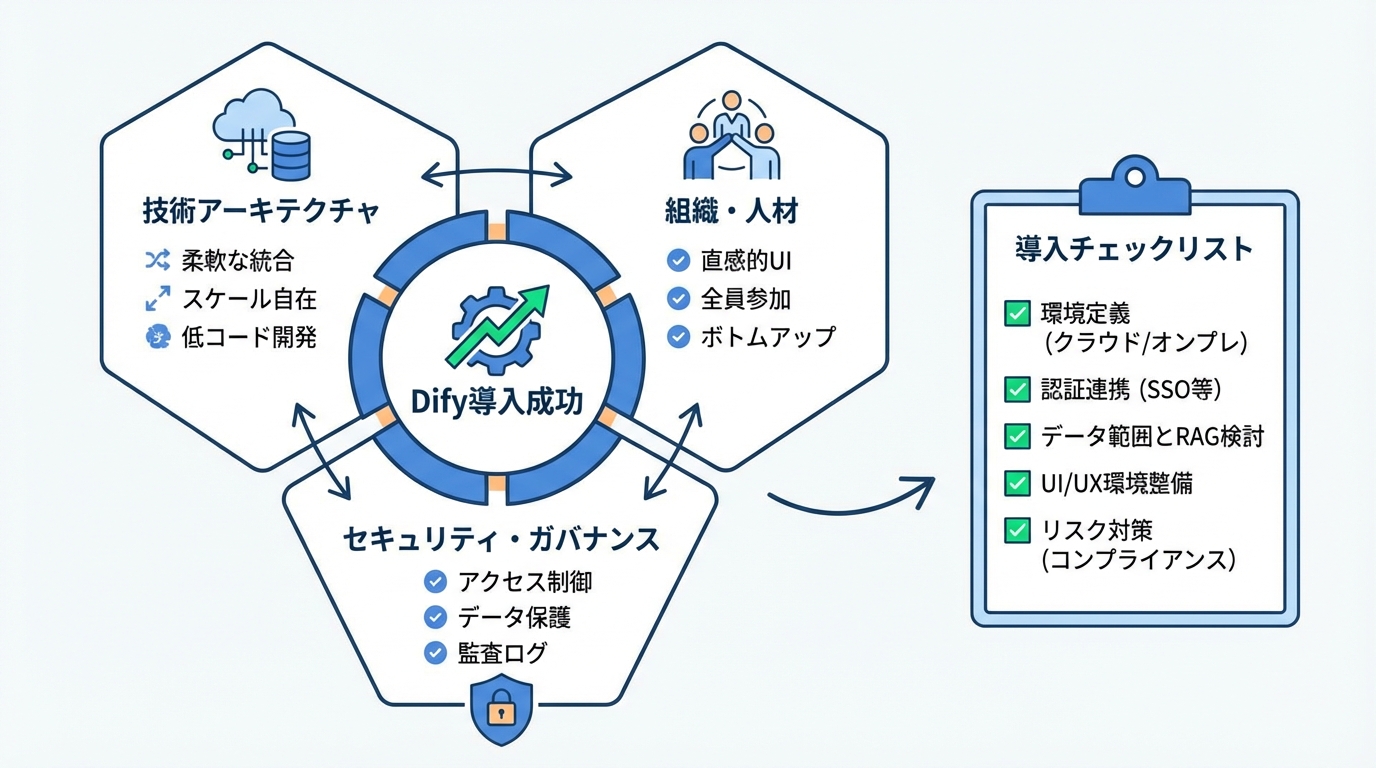

Dify導入を成功させるための共通要因とチェックリスト

技術アーキテクチャ面の成功要因

Difyは企業向けの高度なセキュリティ・ガバナンスや、ベクトルデータと従来のSQLデータを統合できる環境を提供しています。技術的に見た場合、このアーキテクチャの柔軟性が短期間での社内デプロイを可能にしています。Difyのデフォルトのデータベース構成としてWeaviateやPostgreSQLが挙げられますが、外部APIを通じたデータ取得も可能であり、用途に応じて自由度の高いスケールが可能です(参照*1)。

また、サーバーレス技術の採用例も多く、LambdaやAPIゲートウェイと組み合わせることで開発者の負担を軽減しています。これらの技術基盤が無理なく接続できる点が、機能横断的なAIアプリの開発を容易にしています。さらに、Difyプラットフォーム自体が低コード開発を前提としているため、認証やログ取得など面倒な作業を一括管理できる仕組みが確立されています。こうした面から、Dify導入の成功要因として「技術スタックとの親和性の高さ」が挙げられます。

組織・人材面の成功要因

Dify導入におけるもうひとつの核心が、組織文化や人材育成の取り組みです。特定部署だけに依存する形ではなく、新卒や若手のユーザーにもAIアプリ開発を任せる事例が増えているのは、DifyのUIが直感的かつ習得しやすいことが背景にあると考えられます。開発者のみならず、マーケティング担当や業務改善担当が自分たちの課題を解決するアプリを自力開発できる企業環境づくりは大きな強みです(参照*3)。

導入企業の多くが、AIにまつわる専門知識よりも潜在力と実践スキルを重視した採用方針をとっています。これにより、部門単位のボトムアップ活動が活発化し、想像以上のスピードで新しいアプリが生まれています。もちろん、最低限のガバナンスやコーディング規約、セキュリティ教育がセットで行われますが、それもDifyが提供するツールとドキュメントのおかげで比較的スムーズに社内展開できています。

セキュリティ・ガバナンス面の成功要因

企業規模が拡大するとともに、AIアプリが扱うデータの守秘や監査性能の確保は避けて通れない課題です。DifyではAPIキーの管理や役割ベースのアクセス制御、プロンプトから機微情報を除去する仕組みなど、エンタープライズ要件を満たすための各種機能が整備されています(参照*11)。ログ管理や監査ログの活用次第では、誰がどのプロンプトを使用してどの段階でエラーを起こしたかなどの履歴を追いやすくなります。

プラグインのセキュリティ面にも注目が集まっており、公的機関や事前審査を通過したプラグインには公開鍵暗号による認定が付与されるケースがあります(参照*15)。事前に審査されたプラグインであれば、サンドボックス化をせずに運用することが可能なため、拡張性を保ったまま安全性を確保できます。NDAや個人情報保護など、企業によっては極めて重要な要件にも対応しやすいのがDifyの強みです。

Dify導入検討企業向けチェックリスト

初期導入にあたっては、社内のどの部門が早期に効果を得られるかを見極めるとともに、必要なセキュリティ・ログ管理機能の要件を整理することがポイントです。以下に簡易的なチェックリストを示します。

- クラウド環境とオンプレ環境のどちらを中心に利用するかを明確化

- SSOや役割管理など既存認証基盤との連携方法を確認

- データ活用範囲とRAG機能の導入可否を検討

- 開発者以外にも開放できるUI/UX環境の整備

- プライバシー侵害・コンプライアンスリスクへの対策

上記項目を検討することで、導入後の運用トラブルを大幅に回避しやすくなります。特にAIゲートウェイを含むアーキテクチャを採用する場合は、接続先サービスの障害時に備えたフェイルオーバーやエラー処理の設計が欠かせません。Difyのプラグインシステムを正しく活用し、導入初期から適切にログ監視を行うことで、学習曲線を円滑に乗り越えられるでしょう。

おわりに:事例から見えるDify導入の次の一手

Dify導入の事例を総合的に見ると、少人数でのアプリ開発から大規模なデータインフラの再構築まで、幅広い活用が進んでいることが分かります。基盤技術の柔軟性と組織文化の醸成がかみ合えば、現場から継続的にイノベーションが生まれ、企業全体の競争力向上につながる可能性が高いでしょう。

今後は、さらに洗練されたAIゲートウェイやRAG機能の活用が鍵になると予想されます。機能面だけでなく、セキュリティやガバナンスを意識した運用体制を整えながら、Difyの導入戦略を一歩先へ進めることがポイントです。

監修者

安達裕哉(あだち ゆうや)

デロイト トーマツ コンサルティングにて品質マネジメント、人事などの分野でコンサルティングに従事しその後、監査法人トーマツの中小企業向けコンサルティング部門の立ち上げに参画。大阪支社長、東京支社長を歴任したのち2013年5月にwebマーケティング、コンテンツ制作を行う「ティネクト株式会社」を設立。ビジネスメディア「Books&Apps」を運営。

2023年7月に生成AIコンサルティング、およびAIメディア運営を行う「ワークワンダース株式会社」を設立。ICJ2号ファンドによる調達を実施(1.3億円)。

著書「頭のいい人が話す前に考えていること」 が、82万部(2025年3月時点)を売り上げる。

(“2023年・2024年上半期に日本で一番売れたビジネス書”(トーハン調べ/日販調べ))

参照

- (*1) Baytech Consulting – What is Dify.ai? A Strategic Overview, Competitive Analysis, Pricing Breakdown, and Tech Stack Fit for Mid-Market B2B Firms

- (*2) Skypage – Dify.AI: The Ultimate 2025 Guide to Building Production-Ready AI Applications

- (*3) How Dify.AI powers the company that's powering the world

- (*4) Miichisoft | Your Success-Our Mission | Technology Companion – Top 3 Workflow Automation Platforms: N8n, Dify AI, Make?

- (*5) How to Rag – case study from dify

- (*6) Drupal.org – Dify

- (*7) DEV Community – Breaking Limitations: Advanced Customization Guide for Dify Platform

- (*8) Amazon Web Services, Inc. – Building a Scalable and Secure Plugin Platform for Generative AI Using AWS Lambda with Dify

- (*9) TiDB – Dify.AI Consolidates Massive Database Containers into One TiDB

- (*10) PageOn AI – How to Master Dify MCP Integration (A Complete Guide)

- (*11) Dify Integration with TrueFoundry AI Gateway: A Step-by-Step Guide

- (*12) Epitome: Pioneering an Experimental Platform for AI-Social Science Integration

- (*13) Weaxs in Nokstella – A Survey of Open Source DeepResearch Implementation Solutions

- (*14) RAG+: Enhancing Retrieval-Augmented Generation with Application-Aware Reasoning

- (*15) Dify Plugin System: Design and Implementation