MEDIA

国内外の生成AI最新動向をピックアップするメディア

【 新着記事 】

【 今週のアクセスランキング 】

生成AIニュース

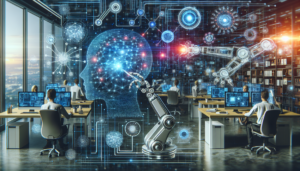

ChatGPTで変わる業務自動化 AI活用の最前線と導入ポイント

生成AIニュース

Gemini生成AIでDX推進 最新活用事例と導入ポイント

tips

生成AIで写真をジブリ風に変換しよう どのサービスがいい?いくらかかる?

tips

生成AIで稼げる副業とは 何がある?方法は?