生成AI 欧米 規制の背景と注目理由

近年、チャットGPTなどの生成AIが次々と登場し、企業活動や社会全体を変革する可能性が高まっています。しかし、その急速な普及に伴い、虚偽情報の拡散や差別の助長、著作権侵害といった懸念が表面化し始めました。特に欧米では「AIを制限なく使うと大きな社会的リスクをもたらす」という問題意識が強く、世界初の包括的なAI規制が欧州連合(EU)で成立しました(参考)。このEUのAI法は2026年から全面施行予定で、危険度によってAIを分類し、顔認証の公共利用制限や差別的表現の禁止などを盛り込んでいます。

引用元:https://iti.or.jp/flash/531

一方で、米国も2023年に初のAI規制枠組みを打ち出し、連邦政府レベルでの取り組みを強化しています(参考)。このように欧米を中心に「生成AI」や「規制」に関する議論が活発化しており、法やルール作りが急速に進んでいるのが特徴です。なかでも企業のDX推進担当者やAI導入担当者は、自社で生成AIを導入するときのコンプライアンスやセキュリティ面をどう確保するのかといった課題感を抱えることが増えています。最新の規制動向を把握しておかなければ、異なる国や地域のルールに抵触してしまうリスクもあるため、各企業にとって重大な関心事項となっています。

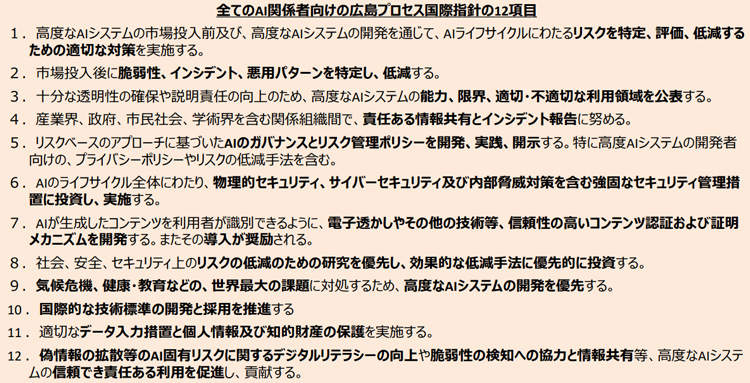

さらに2023年は、生成AIの活用事例が世界中で急増し、特にチャットボットや文章生成の分野で大きな注目を集めました(参考)。しかし同時に、誤情報やフェイク動画の作成を容易にするリスクも現実化しています。そのため、G7各国は人権尊重と安全性確保を柱とした「広島AIプロセス」の国際指針を策定し、欧米や日本を含む世界各地でさらに厳格な規制が検討されています(参考)。

引用元:https://scienceportal.jst.go.jp/explore/review/20231227_e01/index.html

欧米AI政策と最新のAI規制動向

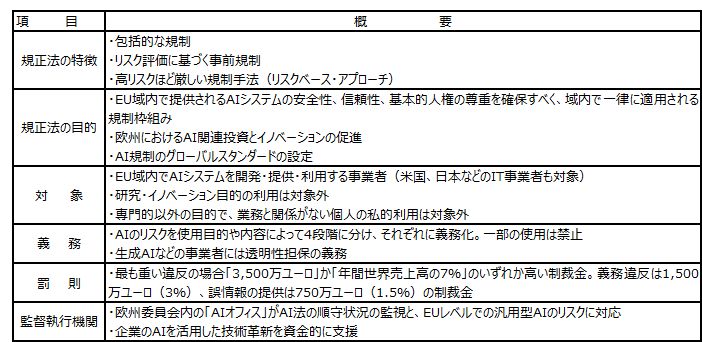

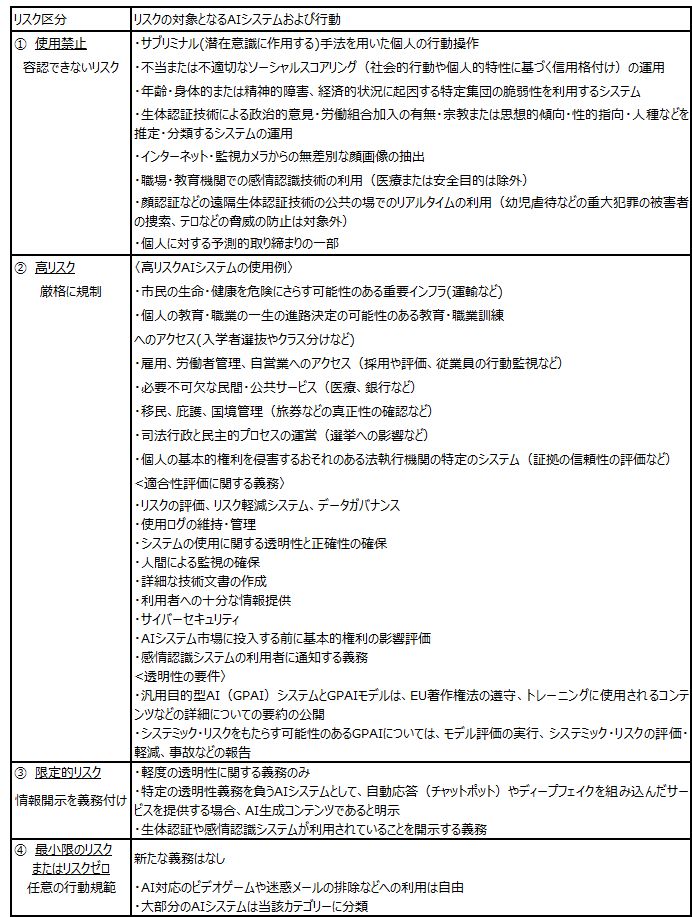

欧米では、生成AIを含むさまざまなAI技術を規制対象とする枠組みが相次いで整備されています。EUのAI法では、偏見や重大リスクへの評価義務、開発企業の透明性確保などが重要視されており、違反時には高額の制裁金が科される可能性があります(参考)。また、データに関する法律も連動して改正される見込みで、著作権を含む知的財産保護の強化やデータの越境移転ルールなどが具体的に検討されています。

米国に目を向けると、政府が直接的に規制内容を細かく定めるよりも、大手企業の自主的な取り組みを重視する傾向があります。ホワイトハウスは2022年に「AI権利章典の青写真」を公表し、差別防止やプライバシー保護など5つの原則を示しました(参考)。さらに2023年にはAIリスク管理フレームワークも公開し、企業が自主的にセキュリティ強化や差別低減の努力を行うよう促しています。一方で連邦政府の指示や大統領令、議会レベルでの法案提出などを通じ、ある程度の拘束力を持たせる仕組みも並行して進められています。

このように欧州が法的拘束力の高い規制を整えるのに対し、米国は自主規制と公的支援を組み合わせる方策を取っているのが特徴です。しかしいずれも、ディープフェイクなどの偽情報対策や個人データ保護、差別撲滅の観点から「AI規制強化」を大きく打ち出していることに変わりはありません。特にEUの厳格な法制度が事実上の国際標準となるのではないかという予測もあり、各企業は欧州の動向を注視中です(参考)。こうした規制波はすでに日本にも影響しており、AI導入を本格化する企業にとって見逃せない情勢となっています。

生成AI技術と倫理・法規制への影響

生成AI技術は、高度な言語モデルや画像生成モデルを用いて自然な文章や視覚コンテンツを自動生成できる点が革新的です。一方、これまでの機械学習よりも大規模なデータを使い、複雑なアルゴリズムで動くため、“ブラックボックス化”が進みやすい弱点も指摘されています。2023年3月には、特定の研究団体が「GPT-4を超えるAI開発を6ヶ月停止すべき」と呼びかけましたが、大手企業は開発を止めることなく進行しており、法的・倫理的なルールの整備が追いつかないまま、リスクが拡大している現状が見られます(参考)。

こうした生成AIによる深刻なリスクとして、まず挙げられるのがフェイク動画や誤情報の作成です。欧米ではこの問題に対応するため、ディープフェイク対策を特に重視し、国を挙げて技術的な防止策や法整備を進めています(参考)。また、人の顔写真や声を盗用して犯罪に巻き込む事例も海外で報告されており、プライバシー保護面での懸念が増大しています。さらに倫理的観点では、AIが人種や性別などによるバイアスを学習すると、公正な判断を阻害する可能性があるため、透明性の確保や監査体制の導入を求める声が高まっています。

こうした状況を受けてG7諸国も「広島AIプロセス」に取り組み、人権尊重や安全性確保を前面に押し出す国際指針をまとめています(参考)。企業のDX担当者やAI導入責任者にとっては、国際動向をふまえた透明性と説明責任の仕組みを整えることが必須になりつつあります。

プライバシーやデータ保護の課題

生成AIの運用では、大量のデータを取り扱うため、個人情報や企業秘密が意図せずに流出するリスクも指摘されます。これまで欧州連合ではGDPR(一般データ保護規則)が厳格に運用されてきましたが、今後のAI法導入により、プライバシー保護の要件がさらに強化される見通しです(参考)。生成AIが学習に使用するデータの範囲や目的外利用がどこまで許されるのか、著作権や個人情報の扱いをどう定義するのかといった問題は、欧米の議論をリードする争点になっています。

一方、国別のAI政策を分析すると、東アジア諸国は研究開発(R&D)に重視を置き、西洋の民主主義国はデータ管理やガバナンスの体制づくりに力を入れているという差が浮かび上がります(参考)。日常業務の効率化を目指す企業にとっては、欧米流のコンプライアンス基準に合わせたデータ管理体制の構築が重要になってきます。この整備が不十分だと、海外との取引やサービス展開の際に信頼を損なうリスクがあるだけでなく、各国の規制に違反する恐れもあるのです。当面は欧米のデータ保護ルールに対する理解と対応策の確立が欠かせないといえるでしょう。

さらに、生成AIによるデータ収集と活用をめぐっては、著作権の問題も深刻化しています。無断で大量のコンテンツを学習用データとして使う行為が触法にあたるかどうかは、各国の法律解釈にゆだねられている状況です。こうした曖昧さを解消するためにも、企業や研究機関は最新の法規制と実務動向をキャッチアップする努力が必要です。

生成AI開発を進めるためのリスク管理

企業が生成AIの導入に踏み切る場合、まず着手すべきは「リスク管理のフレームワーク整備」です。米国では、政府が「AIリスク管理フレームワーク」や「AI権利章典の青写真」を提示して、差別や偏見の除去、プライバシー保護などに自主的に取り組むよう企業に呼びかけています(参考)。この自主的なガイドラインは法的拘束力こそ限定的ですが、米国内での企業活動や連邦政府への納品には遵守が事実上求められる局面が増えてきています。

EUでは違反に対して高額の制裁金を科す姿勢を打ち出しており、リスク管理の不備が明るみに出ると企業イメージに大きなダメージを与えかねません(参考)。日本企業が欧米を市場とする場合やグローバル展開を考える場合、どちらの規制にも対応できる統合的なリスク管理が必要です。業務要件への適合やセキュリティ要件も考慮に入れたカスタマイズAIの導入プロセスを、ステークホルダー全体で共有する仕組みが重要となります。

さらに、最新の調査によると、社会の多くの人が強制力のある規制を望んでいることが明らかになりました(参考)。この「ハード・ロー」路線が進んだ場合、企業には迅速かつ厳格な脆弱性対応や行動規範の整備が求められます。具体的には、生成AIのアウトプットに対する監査体制、データの使用履歴やモデルのバージョン管理などを徹底し、問題発生時の責任所在を明確にする必要があります。

2023年春以降、急成長する生成AIが企業のレポート作成やチャットボットに導入される事例も増えてきました(参考)。この導入ラッシュの中で不備なく活用を進めるためにも、企業のAIリテラシーを高めつつ、セキュリティ対策やコンプライアンスを強固にしておくことが極めて大切です。

今後の展望と日本への影響~欧米AI競争力を踏まえて

欧州連合(EU)は2024年にAI法を公布し、2026年に全面施行する計画を掲げています(参考)。米国側も連邦政府が主導する研究開発戦略や企業の自主規制拡充を通じて、安全で責任あるAIの普及を図っています(参考)。さらに欧米ではAI研究や投資が急速に拡大しており、「AI競争力」の観点でも激しい競争が続いています。

一方、日本政府は2025年2月にAI法案の閣議決定を目指すなど、規制とイノベーション促進の両立を探っている状況です(参考)。また、経団連などによる政策提言や政府の「AI戦略会議」によって、国内企業の声を積極的に取り入れようとしています(参考)。DXをさらに進めたい企業にとっては、海外の高まる規制スタンダードを見据えつつ、日本国内のルールづくりにも早期から関与し、情報収集することが成功のカギとなるでしょう。

特にPoC(概念実証)段階で立ち止まってしまうAIプロジェクトが多い中、最終的に業務へ定着させるにはセキュリティや倫理面のリスク管理だけでなく、社内のAIリテラシー向上や人材教育にも注力が欠かせません。欧米の法制度は自社の課題を再確認するうえで有効な指針となるので、各企業は自分たちのビジネスモデルに合わせてリスクを洗い出し、十分な対策を検討する必要があります。

生成AIの未来は大きな可能性を秘めており、業務効率化や新規事業開発、人材育成など幅広い分野での応用が見込まれます。ただし、その恩恵を最大化するためには「欧米テクノロジー規制」や「欧米データ規制」などの動向を的確に把握し、戦略的に活用することが重要です。規制が強化される流れにあるからこそ、逆に安心・安全なシステムとして整備できる企業は、社会から大きな信頼と評価を得られる可能性があります。今後も各国の法整備とイノベーションが加速するなかで、日本企業においては「確実なコンプライアンス」と「継続的な技術革新」の両輪によって競争力を保ち、AI導入を成功へと導くことが期待されます。

監修者

安達裕哉(あだち ゆうや)

デロイト トーマツ コンサルティングにて品質マネジメント、人事などの分野でコンサルティングに従事しその後、監査法人トーマツの中小企業向けコンサルティング部門の立ち上げに参画。大阪支社長、東京支社長を歴任したのち2013年5月にwebマーケティング、コンテンツ制作を行う「ティネクト株式会社」を設立。ビジネスメディア「Books&Apps」を運営。

2023年7月に生成AIコンサルティング、およびAIメディア運営を行う「ワークワンダース株式会社」を設立。ICJ2号ファンドによる調達を実施(1.3億円)。

著書「頭のいい人が話す前に考えていること」 が、82万部(2025年3月時点)を売り上げる。

(“2023年・2024年上半期に日本で一番売れたビジネス書”(トーハン調べ/日販調べ))

出典

- https://iti.or.jp/flash/531

- https://scienceportal.jst.go.jp/explore/review/20231227_e01/index.html

- https://www.jipdec.or.jp/library/report/20240722-r01.html

- https://www.jst.go.jp/crds/column/choryu/289.html

- https://www.jipdec.or.jp/library/report/20230925.html

- https://www.brookings.edu/articles/weird-ai-understanding-what-nations-include-in-their-artificial-intelligence-plans/

- https://www.keidanren.or.jp/journal/times/2024/0926_08.html

- https://www.chuo-u.ac.jp/academics/faculties/itl/news/2024/05/71171/

- https://hdsr.mitpress.mit.edu/pub/yixt9mqu/release/3

- https://scienceportal.jst.go.jp/explore/review/20230427_e01/

Photo:Tingey Injury Law Firm