MEDIA

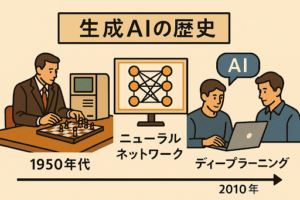

国内外の生成AI最新動向をピックアップするメディア

【 新着記事 】

【 今週のアクセスランキング 】

生成AIニュース

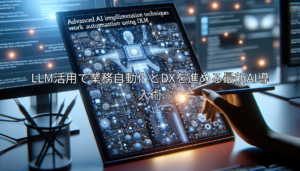

Microsoft AIで業務自動化はどう進化する?導入と成功のポイント

tips

【簡単!】生成AIでテキストや画像を動画にしよう どんなサービスがあるの?

生成AIニュース

Stable Diffusionで業務自動化を実現 導入手順と最新活用事例

生成AIニュース

生成AI導入の効果と最新事例 業務効率化の進め方とポイント